La IA ha creado simultáneamente escasez y excedente de memoria

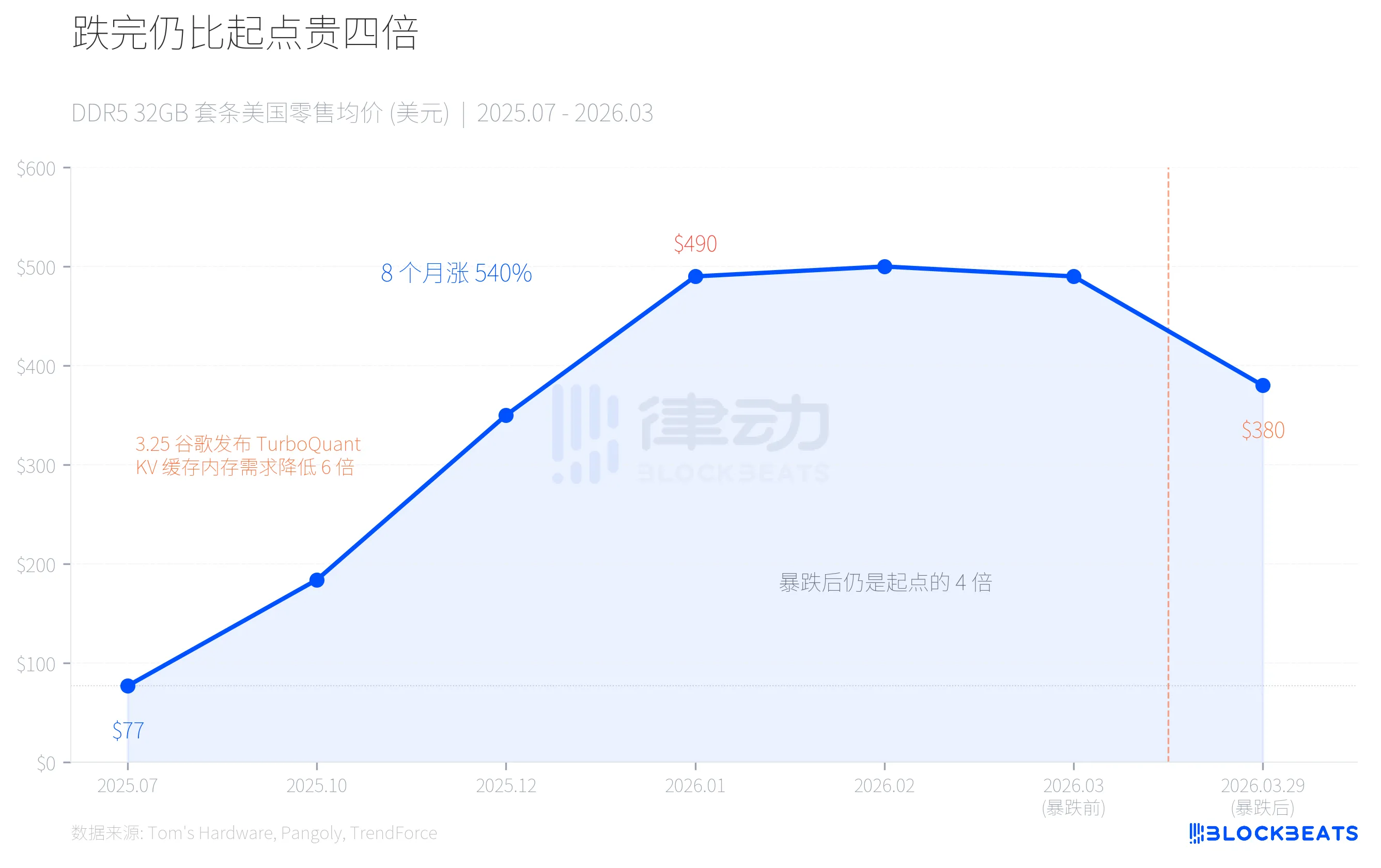

El 29 de marzo, tanto Huaqiangbei como el mercado minorista estadounidense experimentaron simultáneamente una caída en los precios de la memoria similar a un acantilado. El kit Corsair DDR5-6400 de 32 GB se desplomó de $490 a $380, una caída de un solo día del 22%. A nivel nacional, el precio de un kit de alta velocidad DDR5 de 32 GB cayó en 800 yuanes en una semana, lo que provocó ventas de pánico entre los distribuidores de canales, y algunos afirmaron que "bajó más de 100 dólares en un día".

Sin embargo, cuando este número se coloca en una línea de tiempo más larga, el panorama es completamente diferente: incluso después de la caída, el precio actual de DDR5 sigue siendo cuatro veces mayor que el de julio de 2025. Fue un desajuste preciso entre la oferta y la demanda en la cadena de la industria de la IA, donde la misma fuerza primero creó escasez y luego generó pánico excedente.

Montaña rusa: Aumento del 540% en ocho meses, caída del 22% en un mes

En julio de 2025, un kit convencional DDR5-6000 de 32 GB en el mercado minorista de Estados Unidos costaba solo 77 dólares. Para enero de 2026, el precio del mismo kit aumentó a 490 dólares. Un aumento del 540% en ocho meses.

El aumento de precio no se debió a que los consumidores de repente se volvieran locos por actualizar sus computadoras. Según los datos de TrendForce, en el primer trimestre de 2026, los precios de los contratos DRAM aumentaron entre un 90% y un 95% en términos intertrimestrales, con un aumento de los precios de la DRAM de PC superior al 100%, lo que marcó el mayor aumento trimestral registrado. Todo esto fue impulsado por la demanda sedienta de la infraestructura de IA para un tipo particular de memoria.

Luego, el 25 de marzo, Google lanzó un algoritmo de compresión llamado TurboQuant. Cuatro días después, los precios de la memoria colapsaron.

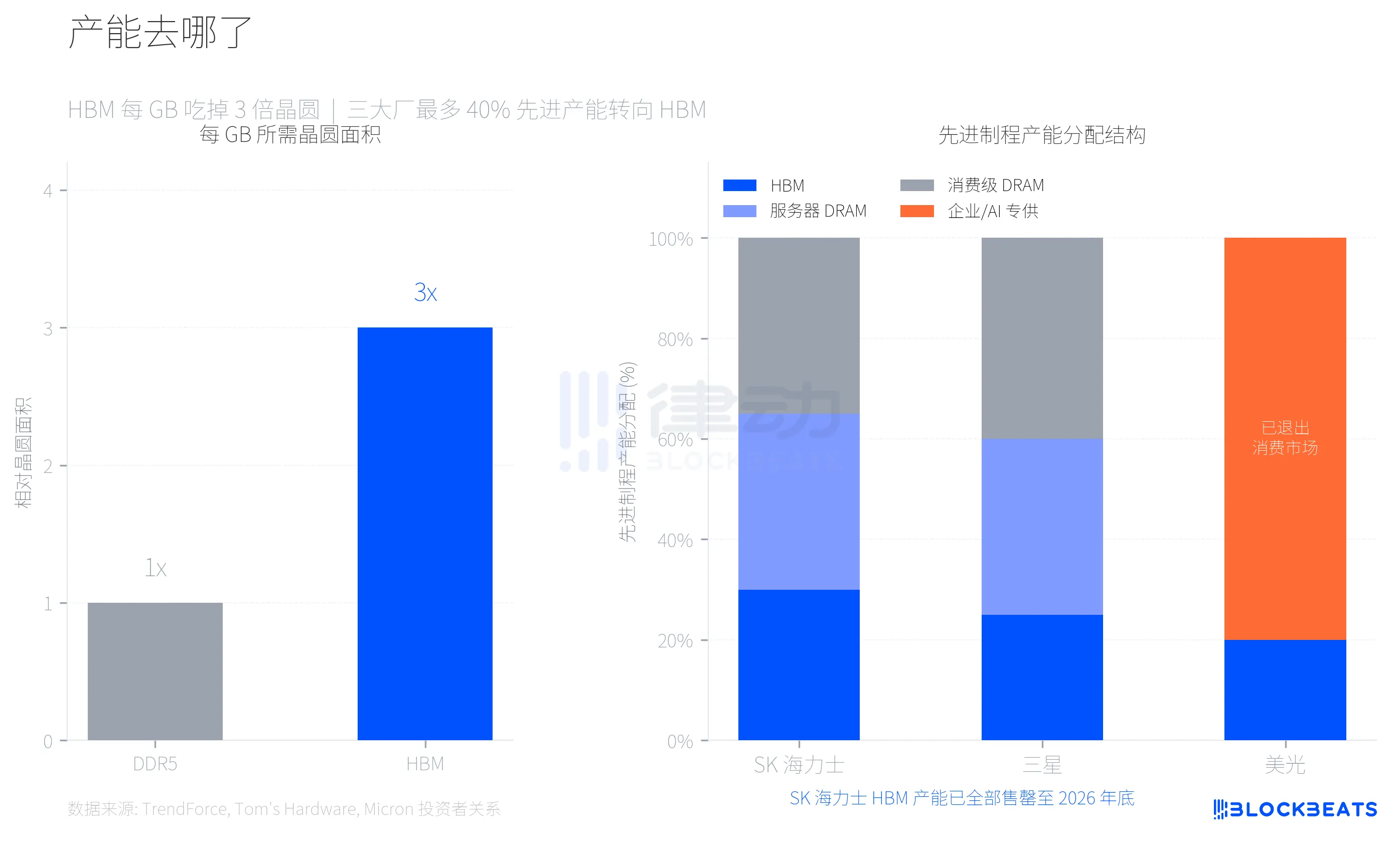

¿Adónde fue la capacidad? HBM se comió su lápiz de memoria

Para entender este aumento de precios, primero debe comprender un parámetro técnico clave. HBM (High Bandwidth Memory, memoria dedicada para chips IA de NVIDIA) consume tres veces el área de la oblea por GB en comparación con la DDR5 normal. Según Tom's Hardware, esto significa que, a partir de la misma oblea, la producción de HBM solo produce un tercio de la capacidad de DDR5.

Samsung, SK Hynix y Micron, los tres principales fabricantes de memorias, hicieron una elección racional frente a los altos márgenes de beneficio de HBM, desplazando hasta el 40% de su capacidad avanzada de obleas de proceso a la producción de HBM. Según los datos de TrendForce, en el primer trimestre de 2026, se espera que el margen de beneficio de DDR5 supere por primera vez al de HBM3e, lo que indica hasta qué punto se ha exprimido el suministro de memoria de calidad para el consumidor.

La elección de Micron es la más radical. En diciembre de 2025, la compañía anunció el cierre de su marca de consumo Crucial, de 29 años, abandonando completamente el mercado de memoria y almacenamiento a nivel de consumidor, y recurriendo completamente a clientes empresariales y de IA. Según el anuncio de Micron Investor Relations, sus ingresos totales para el año fiscal 2025 fueron de 37.380 millones de dólares, con las aplicaciones de centro de datos e IA representando el 56% de los ingresos totales. No vale la pena perseguir el mercado de consumo.

La capacidad HBM de SK Hynix se ha agotado por completo hasta finales de 2026. Samsung planea aumentar su capacidad mensual de HBM de 170.000 obleas a 250.000 obleas para finales de 2026. Las nuevas fabs de obleas (Samsung P4L y SK Hynix M15X) no se espera que comiencen la producción en masa hasta 2027-2028 como muy pronto. En otras palabras, la brecha de oferta de DRAM para el consumidor es estructural y no puede aliviarse en solo una o dos cuartas partes.

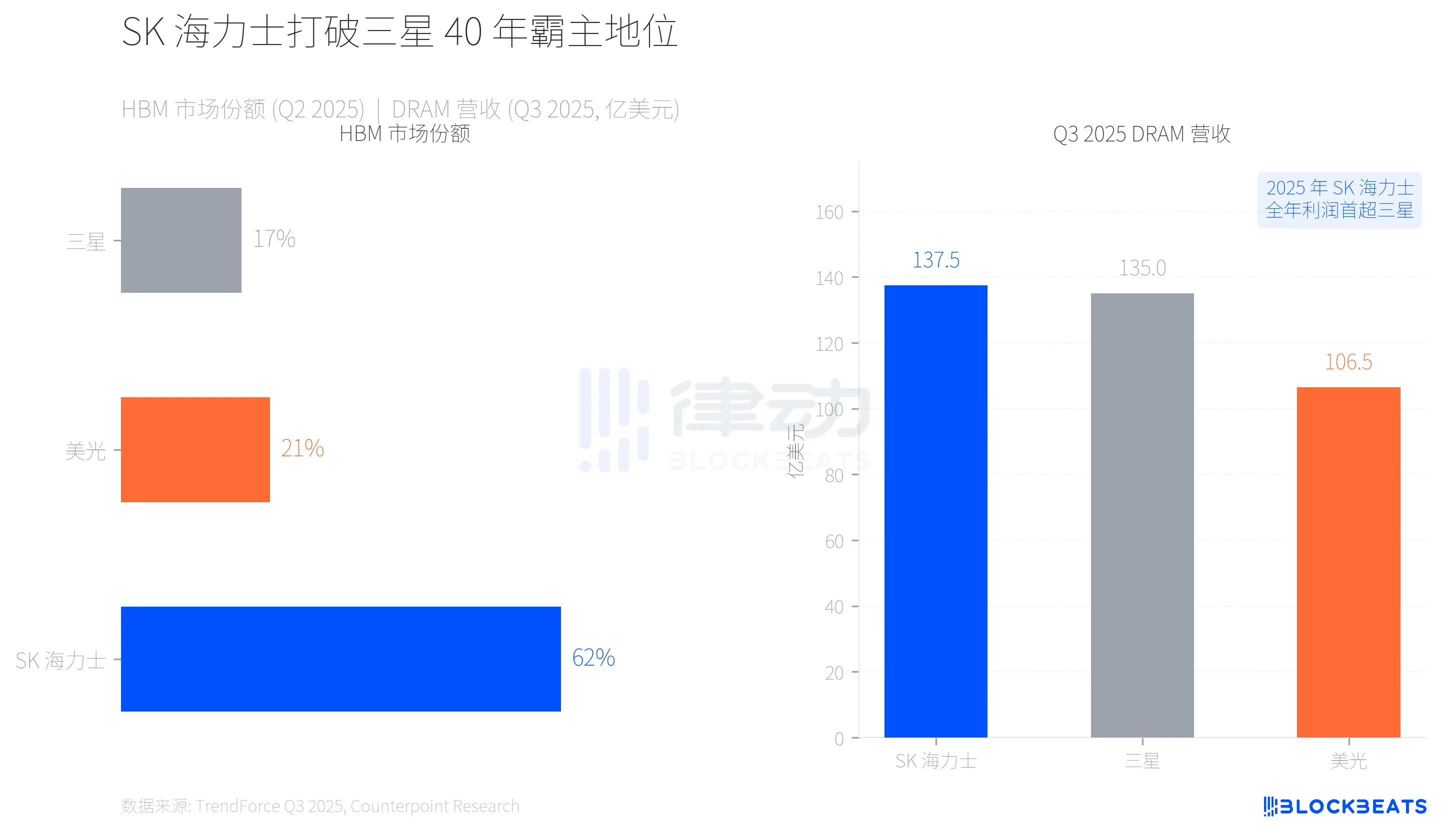

Transformación del paisaje: SK Hynix rompe el dominio de 40 años de Samsung

Este cambio de capacidad también ha remodelado la estructura de poder de la industria de la memoria. Según datos de TrendForce, en el segundo trimestre de 2025, SK Hynix, con profundos lazos con NVIDIA, acaparó el 62% del mercado de HBM, mientras que Samsung solo tenía el 17% y Micron el 21%.

Lo que es aún más significativo, se ha producido un cambio en el nivel de ingresos. Según el informe de TrendForce del tercer trimestre de 2025, SK Hynix encabezó por primera vez los ingresos de DRAM en un solo trimestre con 13.750 millones de dólares, seguido de cerca por Samsung con 13.500 millones de dólares. La brecha entre ambos fue de solo 250 millones de dólares, pero esto marca la primera vez en casi 40 años que Samsung pierde su primera posición en ingresos por memoria. CNBC informó que el beneficio operativo de SK Hynix durante todo el año en 2025 también superó por primera vez al de Samsung.

La ventaja de HBM en el primer movimiento le ha dado a SK Hynix suficiente ventaja, pero esta carrera está lejos de terminar. Samsung está trabajando duro para ponerse al día en el progreso de la producción en masa de HBM4, y aunque Micron ha abandonado el mercado de consumo, su crecimiento de ingresos en los campos empresarial y de IA (Q3 QoQ + 53,2%) es el más rápido entre los tres grandes.

¿Cómo sacudió un algoritmo la lógica de los aumentos de precios?

El 25 de marzo, Google presentó el algoritmo TurboQuant en ICLR 2026. Este algoritmo hizo una cosa: comprimió la caché de KV (Key-Value cache, la parte más intensiva en memoria durante la inferencia del modelo de lenguaje) de precisión FP16 a 3 bits, reduciendo el uso de memoria en al menos 6 veces, mientras lograba hasta 8 veces la aceleración del cálculo de atención en la GPU H100. Según el Google Research Blog, en cinco benchmarks de contexto largo como Needle-in-a-Haystack, la pérdida de precisión fue cero.

El mercado hizo las cuentas rápidamente. Si TurboQuant o un algoritmo similar es ampliamente adoptado por las empresas de IA convencionales, entonces la demanda incremental de DRAM de la inferencia de IA se reducirá significativamente. La narrativa central que ha apoyado el aumento en los precios de la memoria en el último año y medio es precisamente que "la infraestructura de IA ha consumido demasiada capacidad de memoria".

Cuatro días después, la confianza del canal colapsó.

Cabe señalar que TurboQuant se dirige a la caché de KV en el lado de la inferencia de IA, no a la demanda de HBM en el lado de la capacitación. La relación oferta-demanda para HBM no cambiará a corto plazo debido a un algoritmo de optimización de inferencia. Sin embargo, el mercado no siempre distingue entre ambos. Según Sina Finance, antes de la caída, un gran número de acaparadores fuera de canal se precipitaron en el canal nacional debido a los aumentos de precios, con precios altos que causaron una caída de las ventas minoristas de más del 60%. Las ventas en cadena bajo una cadena de financiamiento ajustada magnificaron la caída.

Una cadena de la industria de la IA ha creado simultáneamente escasez y pánico excedente para la memoria. La restricción de la capacidad física de HBM ha hecho que la memoria de calidad para el consumidor sea escasa, mientras que el avance de eficiencia algorítmica de TurboQuant ha causado una fuerte caída en las expectativas de demanda de memoria de IA. La misma fuerza está detrás de la subida de precios y el colapso del mercado.

Te puede gustar

CEO de Sharplink: El futuro de Ethereum se está revelando

De herramientas de casino a máquinas de fijación de precios globales: la perspectiva del líder de la NYSE sobre Hyperliquid

¿Han sido los hackers y la regulación los que han arruinado las DeFi?

Chris Lee: De OG de las criptomonedas a grandes inversiones en los tres gigantes del almacenamiento, predicciones sobre correcciones en el mercado alcista de la IA, Web4 y oportunidades para las nuevas generaciones

He Yi: Ya que estás aquí, más vale intentarlo

Seis quejas principales de un desarrollador de Ethereum

WEEX GOGOGO EP3|LALIGA Camino al Oro – 6 momentos explosivos, 1 entrada para la Copa del Mundo y una noche inolvidable

¿2 años, 225 veces la rentabilidad? Revelando la misteriosa técnica de inversión de "cuello de botella" en IA del investigador Serenity

B.AI se asocia con BNB Chain para lanzar la celebración "Subsidio de Tokens de IA de Mil Millones", impulsando el ecosistema de agentes inteligentes on-chain

El frenesí del billón de dólares por vender memoria: los beneficios de comprarla se reducen a la mitad

Informe matutino | Binance lanza la herramienta de investigación DYOR; YZi Labs lanza la plataforma de contratación YZi Talent; Vitalik afirma que la Fundación Ethereum se "reducirá" y disminuirá la cantidad de ETH vendida

El sueño de exploración de Marte de SuperEx: la moneda digital es la clave para desbloquear los intercambios económicos en la era interestelar

Noticias de la mañana | Michael Saylor declaró que esta semana compró bonos en lugar de Bitcoin; StablR fue atacado y perdió cerca de 2,8 millones de dólares; el Congreso de EE. UU. vuelve a impulsar la Ley de Reserva de Bitcoin

Puntos clave: Texto completo del discurso del científico jefe de Google, Shanahan

Patrones de diseño de agentes: Un libro que me hizo replantearme "¿Qué es exactamente un agente?"

Ha llegado el presidente de la Reserva Federal más rico en 112 años: Kevin Warsh está reescribiendo las reglas

Vitalik habla sobre el futuro de la Ethereum Foundation: una nave más pequeña, más distintiva y más duradera