La apuesta de Anthropic por la IPO: En el momento más improbable, decidió decir no

Imagínese este escenario.

Tienes tres meses de retraso en tus facturas de servicios públicos, fuiste al hospital el mes pasado y presentas tus impuestos diligentemente todos los años. Estas cosas parecen no tener relación.

Pero en un determinado sistema de IA, estos tres datos se agregan y generan un punto rojo en un mapa. Ese punto rojo representa su ubicación y una directiva policial dirigida a usted.

Esto no es ciencia ficción. A principios de 2026, Estados Unidos La Agencia Federal de Inmigración llevó a cabo una operación de barrido a gran escala en Minneapolis, impulsada por esta lógica. El sistema de inteligencia artificial pertinente proviene de una empresa de datos llamada Palantir, que integra los registros médicos de los inmigrantes, las facturas de servicios públicos y la información fiscal en un algoritmo, marcando fríamente los objetivos de persecución uno por uno.

La IA se está convirtiendo en un arma. No es un tiempo futuro, sino presente.

La pregunta ya no es si esto sucederá, sino quién tiene derecho a decidir qué puede y qué no puede hacer.

El 27 de febrero de 2026, esa pregunta recibió una respuesta inquietante.

Ese día, una empresa llamada Anthropic (una empresa de inteligencia artificial, desarrolladora del producto de inteligencia artificial conversacional Claude y competidora del nivel de ChatGPT) fue prohibida formalmente por el gobierno de Estados Unidos. El motivo de la prohibición fue su negativa a permitir que su inteligencia artificial se utilizara para monitorear a ciudadanos estadounidenses y decidir de forma autónoma los objetivos a eliminar.

Se clasificó como un "riesgo para la seguridad nacional" porque decía: "No se puede utilizar de esta manera".

Lo que más necesita una empresa que se prepara para una IPO

Antes de responder a la pregunta "¿Por qué Anthropic no haría concesiones?", es necesario entender cuál es su situación actual.

Anthropic es una de las empresas de inteligencia artificial mejor valoradas del mundo, valuada en 380 mil millones de dólares y con ingresos anuales de 14 mil millones de dólares en 2025. Su mayor accionista es Amazon, con una participación superior a la de cualquier otro accionista. Su modelo de IA Claude es uno de los productos de IA de más rápido crecimiento en el mercado empresarial actualmente.

Desde cualquier punto de vista, esta es una empresa lista para salir a bolsa. De hecho, Anthropic se está preparando para una IPO este año, permitiendo que la gente común pueda comprar sus acciones.

¿Qué es lo que más necesita una empresa que se prepara para salir a bolsa? La respuesta no requiere mucha reflexión: estabilidad, previsibilidad y ningún problema regulatorio. Cualquier evento negativo podría afectar la confianza de los inversores en la empresa y, por lo tanto, deprimir el precio de la IPO.

Luego, las cosas tomaron un giro completamente opuesto.

En julio de 2025, el Pentágono otorgó simultáneamente un contrato de hasta 200 millones de dólares a Anthropic, OpenAI (desarrollador de ChatGPT), Google y xAI de Musk, con el objetivo de integrar IA de vanguardia en el sistema militar estadounidense. Esta fue la mayor contratación pública en la historia de la IA.

Cabe destacar que el contrato de Anthropic contenía un detalle que las otras tres empresas no tenían. Se establecieron explícitamente dos restricciones de uso: Claude no podría utilizarse para la vigilancia masiva de ciudadanos estadounidenses ni para sistemas de armas autónomos sin supervisión humana.

OpenAI, Google y xAI estuvieron de acuerdo en que los militares podrían usar IA para todos los fines legales sin limitaciones adicionales. Sólo Anthropic trazó dos líneas rojas en el contrato.

Estas dos líneas rojas se convirtieron más tarde en el punto de partida de todos los problemas.

Ultimátum

En febrero de 2026, el Pentágono decidió presionar a Anthropic.

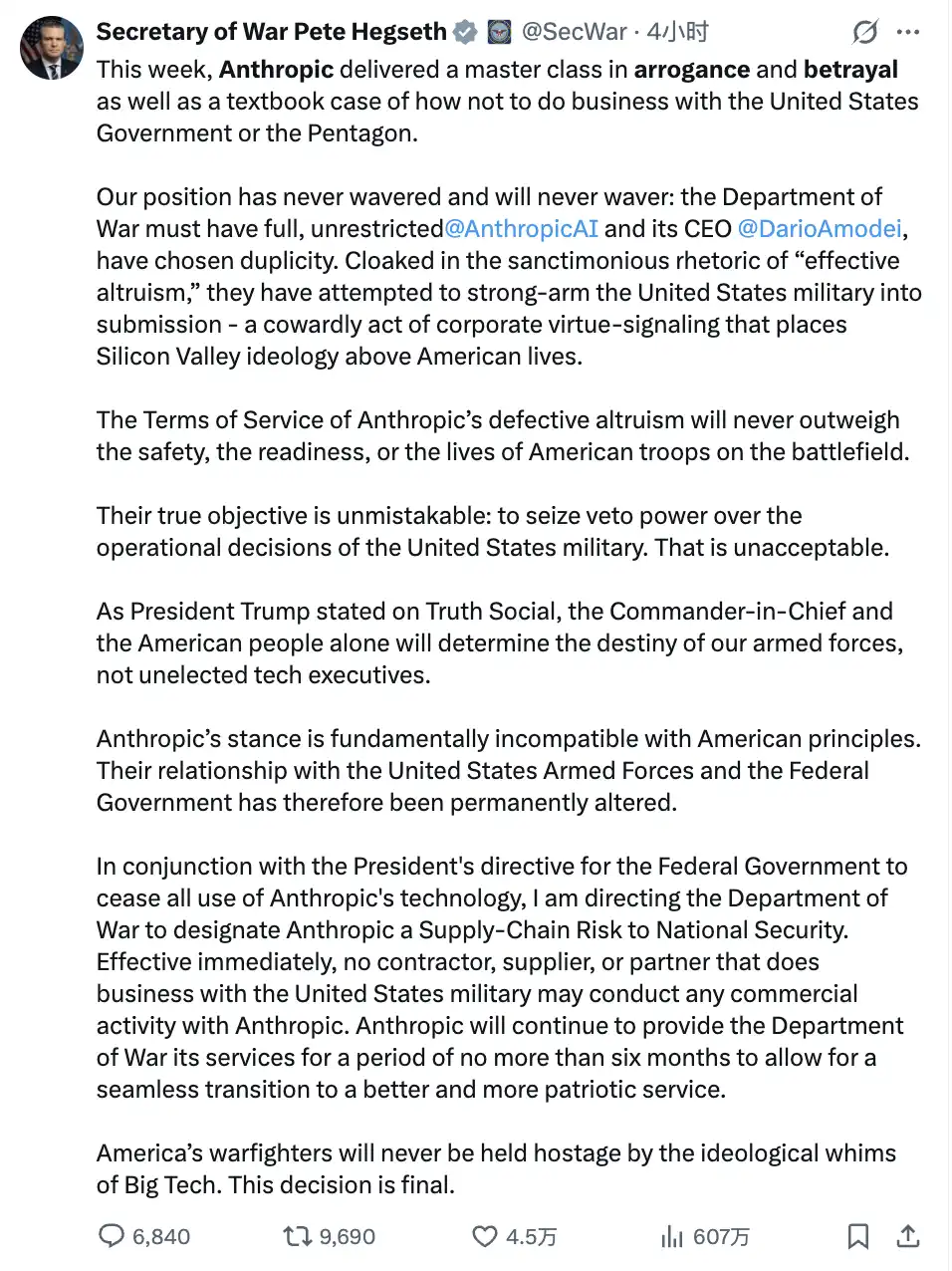

El secretario de Defensa, Pete Hegseth, lanzó un ultimátum al director ejecutivo de Anthropic, Dario Amodei: eliminar las restricciones de uso del contrato, permitiendo que Claude sea utilizado para todos los fines legales. De lo contrario, el Pentágono cancelaría el contrato y designaría a Anthropic como un "riesgo de la cadena de suministro". La fecha límite fue el 27 de febrero.

La respuesta de Darío fue: No.

En una declaración pública, escribió: "Entendemos que las decisiones militares las toma el gobierno, no las empresas privadas. Pero en muy pocos casos creemos que la IA puede socavar los valores democráticos en lugar de defenderlos. “Tenemos la conciencia tranquila y no podemos aceptar sus exigencias”.

Luego, Emil Michael, el responsable de tecnología del Pentágono, publicó en las redes sociales que llamaba a Darío un fraude, lo acusaba de tener un complejo de Dios y de intentar controlar personalmente al ejército estadounidense, poniendo en riesgo la seguridad nacional.

Luego vino el propio Trump. Escribió en su propia plataforma social, Truth Social, que Anthropic era una "empresa que impulsaba el despertar de la izquierda radical", que había "cometido un error catastrófico" y ordenó a todas las agencias del gobierno federal que dejaran de usar inmediatamente todos los productos de Anthropic y que la transición se completara en un plazo de seis meses.

El Pentágono clasificó rápidamente a Anthropic como un "riesgo para la cadena de suministro".

Anteriormente, esta etiqueta sólo se utilizaba para marcar empresas relacionadas con adversarios extranjeros como China. Se ha utilizado para Huawei y SMIC. Ahora es el turno de una empresa estadounidense de inteligencia artificial con sede en San Francisco y una valoración de 380 mil millones de dólares.

200 millones de dólares es un problema menor, el verdadero problema está aquí

La reacción inicial de muchas personas fue: perder un contrato gubernamental de 200 millones de dólares es sólo una pequeña fracción para Anthropic, con 14 mil millones de dólares en ingresos anuales.

Esta evaluación es correcta, pero el enfoque es erróneo.

El impacto real proviene de la propia etiqueta de "riesgo de la cadena de suministro". Esto significa que cualquier empresa que colabore con el ejército estadounidense debe demostrar que su negocio no ha involucrado a Anthropic. No se trata de una presión ética blanda, sino de un requisito de estricto cumplimiento.

Siguiendo esta línea de pensamiento hacia abajo, el alcance del impacto comienza a parecer menos optimista.

Amazon Web Services es la principal infraestructura operativa de Claude y también el mayor proveedor de nube para el gobierno de EE. UU., con una profunda integración entre ambos. La empresa de análisis de datos Palantir, al servicio de las agencias militares y de inteligencia de Estados Unidos, incorpora a Claude. La empresa de tecnología de defensa Anduril procesa datos utilizando Claude en proyectos relacionados con el Pentágono.

Estos clientes ahora deben tomar una decisión: seguir utilizando Claude, enfrentando la presión de colaborar con una empresa de "riesgo en la cadena de suministro", o reemplazar Claude, una herramienta profundamente integrada en sus flujos de trabajo.

Ambas opciones son pérdidas para Anthropic. Éste es el riesgo real que hay que gestionar, mucho más preocupante que el monto del contrato de 200 millones de dólares.

Todos estos problemas están ocurriendo antes de la salida a bolsa.

¿Por qué todavía ocurrió el rechazo?

La situación se está volviendo intrigante.

Una empresa que se dirige corriendo hacia una IPO, lo último que necesita en este momento crítico son problemas, pero decidió enfrentar directamente la presión del gobierno. ¿Se trata de un error de criterio empresarial o de una apuesta calculada?

Poner las dos opciones una al lado de la otra hace que la lógica sea más clara.

Si llegan a un acuerdo, se salva el contrato, se mantienen las relaciones gubernamentales y los problemas inmediatos desaparecen. Pero la narrativa de marca más importante de Anthropic de los últimos tres años —"la empresa de IA más responsable", "la seguridad primero"— se agrietará en este momento.

El riesgo mayor no es inmediato. Una vez que Claude se utilice realmente para vigilancia a gran escala o para decisiones sobre armas autónomas, si ocurre algún percance, la pérdida no será solo un contrato, sino la tesis de valoración de toda la empresa. La prima que los inversores pagaron inicialmente por la historia de la "IA responsable" se evaporará de la noche a la mañana.

Si se niega, se perderán 200 millones de dólares, se activará una etiqueta de riesgo en la cadena de suministro y el mercado gubernamental quedará esencialmente cerrado. Pero la narrativa de marca "La seguridad es lo primero" ha recibido el respaldo público más caro de la historia. Ningún presupuesto de relaciones públicas podría comprar este efecto, ya que el gobierno lo prohibió por negarse a permitir que la inteligencia artificial monitoree a los ciudadanos del país.

Hay una frase en la declaración de Darío que vale la pena destacar: "Nuestra valoración y nuestros ingresos sólo aumentan después de adoptar esta postura".

¿Esta frase es una declaración de relaciones públicas o un juicio comercial? Podrían ser ambas cosas, pero no son contradictorias.

Hay un contraejemplo que debemos considerar. Palantir, la empresa de datos mencionada anteriormente que utilizó IA para ayudar a la agencia federal de inmigración a rastrear objetivos, tomó un camino completamente opuesto. Se adaptó profundamente a todas las demandas del gobierno y estuvo abierto al seguimiento de la inmigración, al análisis de inteligencia y a la selección de objetivos militares. Como resultado, fue rechazado por el círculo de capital socialmente responsable durante casi veinte años, incapaz de recaudar dinero durante mucho tiempo y excluido por los grandes fondos.

Luego, en 2024, cuando la narrativa militar de la IA se convirtió en la historia principal del mercado, el precio de sus acciones aumentó un 150% en un año y su valor de mercado superó los 400 mil millones de dólares.

Dos caminos, dos destinos, cada uno con su propia lógica. Palantir cambió veinte años de paciencia por la explosión de hoy. Anthropic apuesta a una lógica de valoración diferente: en la competencia cada vez más feroz y homogénea entre las empresas de IA, la "IA más segura" no es solo una postura ética sino un foso comercial en el mundo real.

Aún no se sabe qué apuesta será mayor. Pero Anthropic cree claramente que el costo del compromiso es mayor que el del rechazo.

¿Podrá dar frutos la apuesta de Darío?

La respuesta a esta pregunta depende de varias variables que aún no se han materializado.

En primer lugar, es la respuesta real de los clientes empresariales. ¿Amazon, Palantir y Anduril cortarán activamente sus relaciones con Claude debido a la etiqueta de "riesgo en la cadena de suministro" o elegirán quedarse quietos y esperar a que la situación cambie? Hasta el momento, estas empresas no han hecho ninguna declaración pública. Si deciden esperar y ver, la pérdida real de Anthropic será sólo el contrato gubernamental de 200 millones de dólares.

La siguiente dificultad práctica es la de sustituir al gobierno. Incluso el propio departamento del Pentágono que utiliza a Claude internamente reconoce: Claude es actualmente uno de los modelos de IA más potentes disponibles, y Grok, de Musk, aún está muy por detrás en términos técnicos. Reemplazar significa rebajar el uso. ¿Quién asumirá este coste?

Por último, está el impacto inesperadamente amplio de este asunto. El mismo día que Anthropic fue prohibido, Sam Altman, CEO de OpenAI, el desarrollador de ChatGPT, tomó una postura pública: OpenAI y Anthropic comparten la "misma línea roja" respecto del límite del uso de IA militar, y ambas compañías adoptan una postura unificada.

En otras palabras, si el gobierno busca una alternativa que esté dispuesta a cumplir plenamente sin restricciones, las opciones son mucho menores de lo que imagina.

El proceso de militarización de la IA no se ralentizará por ello. Grok de Musk ya ha penetrado la red clasificada del Pentágono, otras empresas de IA no han perdido contratos militares y los sistemas de armas asistidos por IA continúan iterando.

La elección de Anthropic no cambia esta trayectoria. Lo que cambia es dónde se sitúa en esta trayectoria.

Pero una cosa es segura: esta es la primera vez en la historia de la industria de la IA que una empresa tradicional ha resistido abiertamente la presión del gobierno sobre principios explícitos, incluso si finalmente pagó el precio de ser prohibida. Independientemente del resultado de esta apuesta, este precedente ya existe.

El último problema aritmético que queda para el lector: una empresa valuada en 380 mil millones de dólares, en aras de dos principios escritos en un contrato, renunció a todo el mercado gubernamental y luego fue clasificada como un riesgo para la seguridad nacional.

En la actual era de armamentismo acelerado por la IA, la forma de calcular esta ecuación depende de lo que se considere más valioso en el futuro.

También te puede gustar

SBI Holdings Introduces Innovative 10B Yen Blockchain Bond with XRP Rewards

Key Takeaways: SBI Holdings has launched a new blockchain-based bond, offering a total of 10 billion yen, integrated…

Elliptic Señala Redes de Plataformas Cripto Rusas que Eluden Sanciones

Key Takeaways: Cinco plataformas de intercambio de criptomonedas vinculadas a Rusia están ayudando a usuarios a evadir restricciones…

Los ETFs de Bitcoin al contado registran la quinta semana consecutiva de salidas a medida que disminuye la demanda institucional

Puntos clave: Los ETFs de Bitcoin al contado han experimentado su quinta semana consecutiva de retiros, con una…

Las acusaciones de Jane Street por operaciones con información privilegiada que aceleraron el colapso de Terraform en 2022

Puntos Clave Jane Street es acusada de utilizar información privada para acelerar la caída del proyecto cripto Terraform…

Terraform Labs demanda a Jane Street por supuesto uso de información privilegiada previo al colapso de Terra-Luna

Principales conclusiones Demanda de Terraform Labs: Terraform Labs, a través de su administrador de liquidación, Todd Snyder, ha…

El Banco de Japón prueba un sistema de liquidación de reservas basado en blockchain

El Banco de Japón lidera entre los bancos del G7 al adoptar la tecnología blockchain para las reservas…

Predicción de Precio de Ethereum: Ballenas Impulsan el Séptimo Mes en Rojo Mientras el Sector RWA Alcanza Récord de $15 Mil Millones

Key Takeaways Ethereum podría estar enfrentando su séptimo mes consecutivo en rojo, generando predicciones bajistas. Las grandes carteras…

El Enfoque de VanEck sobre el Piso Macro de Bitcoin: ¿Es la Zona de $60K–$70K el Verdadero Reinicio del Ciclo?

Jan van Eck, CEO de VanEck, afirma que Bitcoin ha alcanzado un piso macro, reestructurando así las expectativas…

WBT logró un silencioso 15X mientras todos veían las Meme Coins

Key Takeaways WBT, la moneda nativa del intercambio europeo WhiteBIT, alcanzó un crecimiento impresionante sin mucha atención mediática.…

Arthur Hayes predice que el precio de Bitcoin alcanzará $750,000 para 2027 debido a la impresión de dinero

Puntos Clave Arthur Hayes, cofundador de BitMEX, predice que Bitcoin alcanzará los $250,000 en 2026 y $750,000 en…

Pronósticos de Precios de Criptomonedas Hoy 2 de Marzo – XRP, Bitcoin, Ethereum

Puntos Clave A pesar de las tensiones geopolíticas entre EE.UU. e Irán, Bitcoin se mantiene estable por encima…

Aumento del 700% en la Salida de Fondos de Intercambio en Irán mientras Aumentan las Alertas de Sanciones a USDT

Key Takeaways: Los flujos de salida de criptomonedas de las plataformas iraníes aumentaron un 700% tras ataques militares…

Predicción del Precio de Solana: Una Pérdida de Mil Millones de Dólares No Inmutó a Este Ballena de SOL — ¿Qué Saben?

Key Takeaways Forward Industries, uno de los mayores tenedores institucionales de Solana, enfrenta grandes pérdidas sin retroceder. Continúan…

Salto del Precio de Ethereum y Acciones de BitMine Tras Compra del Tesoro

Claves del Artículo BitMine Immersion Technologies ha comprado 50,928 ETH, lo que provocó un aumento del 9% en…

Predicción del Precio de Bitcoin: $1 Billón Vuelve a los ETFs Cripto — ¿Se Reinicia la Carrera Alcista?

Key Takeaways: Bitcoin registra un espectacular retorno con un influjo de $1 billón hacia los ETFs cripto, impulsando…

Predicción de Precio de Bitcoin: Miedo Alcanza Nivel Visto Sólo Dos Veces Antes — Lo Que Sucede a Continuación Podría Cambiarlo Todo

Key Takeaways El índice de Miedo y Codicia de Bitcoin cae a 5, un nivel de miedo extremo…

Predicción del Precio de XRP: ¿Inversores Preparados para Deshacerse de XRP con $650 Millones Inundando los Intercambios?

Key Takeaways Un repentino cambio en el comportamiento de los titulares de XRP está generando predicciones de precios…

New ChatGPT Predice el Precio de XRP, Solana y Shiba Inu para el 2026

ChatGPT predice que XRP podría experimentar un aumento de 7 veces hacia finales del 2026, alcanzando un valor…

SBI Holdings Introduces Innovative 10B Yen Blockchain Bond with XRP Rewards

Key Takeaways: SBI Holdings has launched a new blockchain-based bond, offering a total of 10 billion yen, integrated…

Elliptic Señala Redes de Plataformas Cripto Rusas que Eluden Sanciones

Key Takeaways: Cinco plataformas de intercambio de criptomonedas vinculadas a Rusia están ayudando a usuarios a evadir restricciones…

Los ETFs de Bitcoin al contado registran la quinta semana consecutiva de salidas a medida que disminuye la demanda institucional

Puntos clave: Los ETFs de Bitcoin al contado han experimentado su quinta semana consecutiva de retiros, con una…

Las acusaciones de Jane Street por operaciones con información privilegiada que aceleraron el colapso de Terraform en 2022

Puntos Clave Jane Street es acusada de utilizar información privada para acelerar la caída del proyecto cripto Terraform…

Terraform Labs demanda a Jane Street por supuesto uso de información privilegiada previo al colapso de Terra-Luna

Principales conclusiones Demanda de Terraform Labs: Terraform Labs, a través de su administrador de liquidación, Todd Snyder, ha…

El Banco de Japón prueba un sistema de liquidación de reservas basado en blockchain

El Banco de Japón lidera entre los bancos del G7 al adoptar la tecnología blockchain para las reservas…