La apuesta de la OPI de Anthropic: En el momento más improbable, decidió decir que no

Imagina este escenario.

Llevas tres meses de retraso en tus facturas de servicios, fuiste al hospital el mes pasado, presentas tus impuestos diligentemente cada año. Estas cosas parecen no estar relacionadas.

Pero en un cierto sistema de IA, estas tres piezas de información se agregan, generando un punto rojo en un mapa. Ese punto rojo representa tu ubicación y una directiva de las fuerzas del orden dirigida a ti.

Esto no es ciencia ficción. A principios de 2026, los EE. UU. La Agencia Federal de Inmigración llevó a cabo una operación de barrido a gran escala en Minneapolis, impulsada por esta lógica. El sistema de IA relevante proviene de una empresa de datos llamada Palantir, que integra los registros médicos de los inmigrantes, las facturas de servicios y la información fiscal en un algoritmo, marcando fríamente los objetivos de persecución uno por uno.

La IA está siendo armada. No en futuro, sino en presente.

La pregunta ya no es si sucederá, sino quién tiene el derecho a decidir qué puede y qué no puede hacer.

El 27 de febrero de 2026, esa pregunta recibió una respuesta inquietante.

Ese día, una empresa llamada Anthropic—una empresa de IA, el desarrollador del producto de IA conversacional Claude, un competidor al nivel de ChatGPT—fue formalmente prohibida por el gobierno de EE. UU. La razón de la prohibición fue su negativa a permitir que su IA se utilizara para monitorear a los ciudadanos estadounidenses y decidir de forma autónoma sobre objetivos para eliminación.

Fue clasificada como un "riesgo para la seguridad nacional" porque dijo: "No se puede usar de esta manera."

Lo que más necesita una empresa que se prepara para una OPI

Antes de responder "Por qué Anthropic no cedería", es necesario entender dónde se encuentra ahora.

Anthropic es una de las empresas de IA más valoradas del mundo, valorada en 380 mil millones de dólares, con unos ingresos anuales de 14 mil millones de dólares en 2025. Su mayor accionista es Amazon, con una participación que supera a la de cualquier otro accionista. Su modelo de IA, Claude, es uno de los productos de IA de más rápido crecimiento en el mercado empresarial actualmente.

Por cualquier estándar, esta es una empresa lista para salir a bolsa. De hecho, Anthropic se está preparando para una OPI este año, permitiendo a la gente común comprar sus acciones.

¿Qué necesita más una empresa que se prepara para una OPI? La respuesta requiere poco pensamiento: estabilidad, previsibilidad y sin problemas regulatorios. Cualquier evento negativo podría afectar la confianza de los inversores en la empresa y, por lo tanto, deprimir el precio de la OPI.

Entonces, las cosas tomaron un giro en la dirección completamente opuesta.

En julio de 2025, el Pentágono otorgó simultáneamente un contrato de hasta 200 millones de dólares a Anthropic, OpenAI (desarrollador de ChatGPT), Google y xAI de Musk, con el objetivo de integrar IA de vanguardia en el sistema militar de EE. UU. Este fue el mayor contrato gubernamental en la historia de la IA.

Notablemente, el contrato de Anthropic contenía un detalle que las otras tres empresas no tenían. Establecía explícitamente dos restricciones de uso: Claude no podría ser utilizado para la vigilancia masiva de ciudadanos estadounidenses ni para sistemas de armas autónomas sin supervisión humana.

OpenAI, Google, xAI, todos acordaron que el ejército podría usar IA para todos los fines legales sin limitaciones adicionales. Solo Anthropic trazó dos líneas rojas en el contrato.

Estas dos líneas rojas se convirtieron más tarde en el punto de partida de todos los problemas.

Ultimátum

En febrero de 2026, el Pentágono decidió presionar a Anthropic.

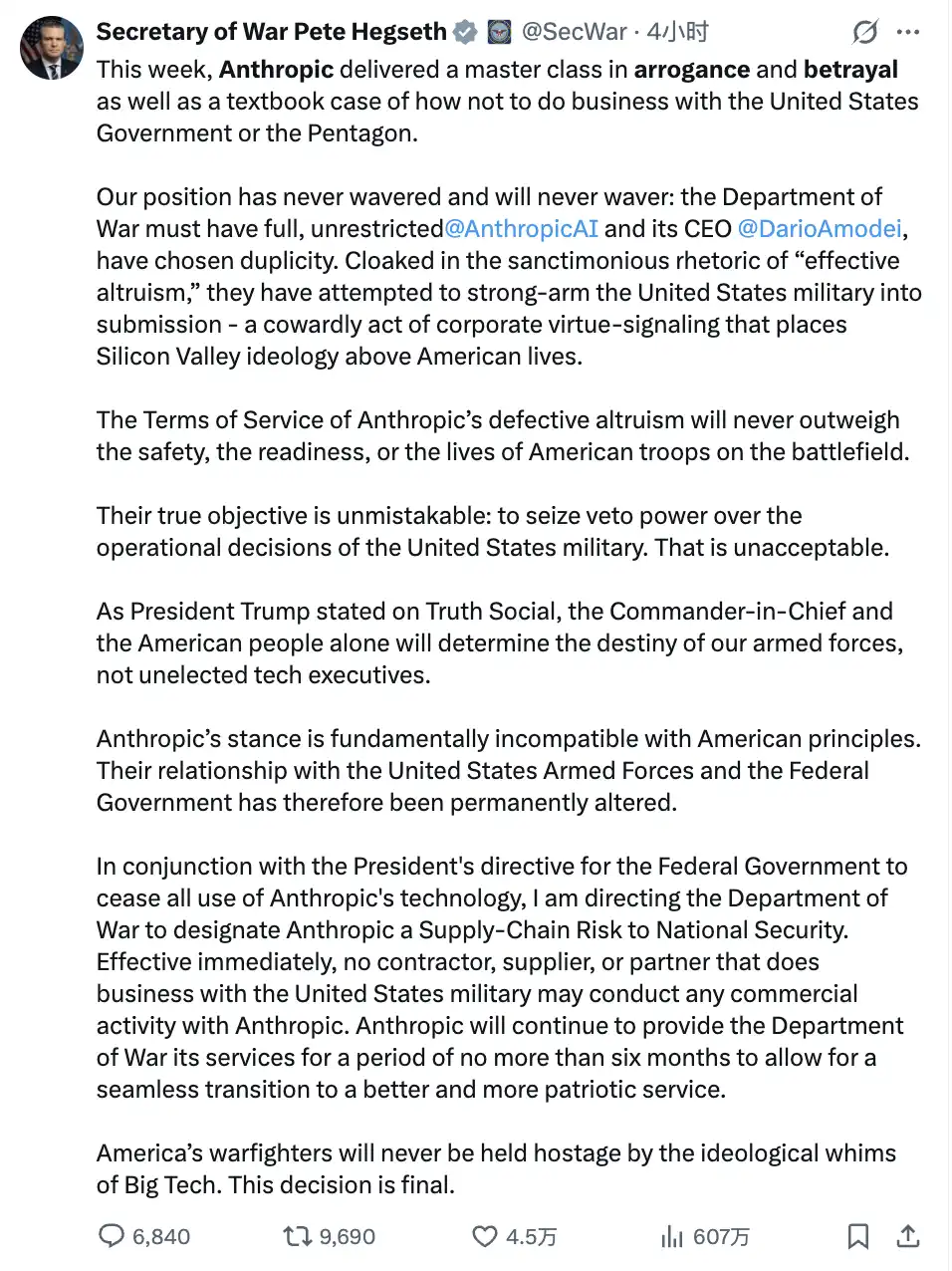

El secretario de Defensa Pete Hegseth emitió un ultimátum al CEO de Anthropic, Dario Amodei: eliminar las restricciones de uso del contrato, permitiendo que Claude se utilizara para todos los fines legales. De lo contrario, el Pentágono cancelaría el contrato y designaría a Anthropic como un "riesgo de cadena de suministro." La fecha límite era el 27 de febrero.

La respuesta de Dario fue: No.

En una declaración pública, escribió: "Entendemos que las decisiones militares son tomadas por el gobierno, no por empresas privadas. Pero en muy pocos casos, creemos que la IA puede socavar en lugar de mantener los valores democráticos." Tenemos la conciencia tranquila y no podemos aceptar sus demandas."

Emil Michael, el líder tecnológico del Pentágono, luego publicó en las redes sociales, llamando a Dario un fraude, acusándolo de tener un complejo de dios y de intentar controlar personalmente al ejército de EE. UU., arriesgando la seguridad nacional.

Luego vino el propio Trump. Escribió en su propia plataforma social, Truth Social, que Anthropic era una "empresa de despertar radical de izquierda," había "cometido un error catastrófico," y ordenó: que todas las agencias del gobierno federal cesaran inmediatamente el uso de todos los productos de Anthropic, con una transición que debía completarse en 6 meses.

El Pentágono clasificó rápidamente a Anthropic como un "riesgo de cadena de suministro."

Esta etiqueta se utilizaba anteriormente solo para marcar empresas relacionadas con adversarios extranjeros como China. Se ha utilizado para Huawei y SMIC. Ahora es el turno de una empresa de IA estadounidense con sede en San Francisco y una valoración de 380 mil millones de dólares.

200 millones de dólares es un problema menor, el verdadero problema está aquí

La reacción inicial de muchas personas fue: perder un contrato gubernamental de 200 millones de dólares es solo una pequeña fracción para Anthropic con 14 mil millones de dólares en ingresos anuales.

Esta evaluación es correcta, pero el enfoque es erróneo.

El verdadero impacto proviene de la etiqueta de "riesgo de cadena de suministro" en sí. Significa que cualquier empresa que colabore con el ejército de EE. UU. debe demostrar que su negocio no ha involucrado a Anthropic. No se trata de una presión ética suave, sino de un requisito estricto de cumplimiento.

Siguiendo esta línea de pensamiento, el alcance del impacto comienza a parecer menos optimista.

Amazon Web Services es la infraestructura operativa principal de Claude y también el mayor proveedor de nube para el gobierno de EE. UU., con una profunda integración entre ambos. La empresa de análisis de datos Palantir, mientras sirve al ejército de EE. UU. y a las agencias de inteligencia, incorpora a Claude. La empresa de tecnología de defensa Anduril procesa datos utilizando a Claude en proyectos relacionados con el Pentágono.

Estos clientes ahora tienen que tomar una decisión: seguir utilizando a Claude, enfrentándose a la presión de colaborar con una empresa de "riesgo en la cadena de suministro", o reemplazar a Claude, una herramienta profundamente integrada en sus flujos de trabajo.

Ambas opciones son pérdidas para Anthropic. Este es el verdadero riesgo que necesita ser gestionado, mucho más preocupante que la cantidad del contrato de 200 millones de dólares.

Todo este problema está ocurriendo antes de la salida a bolsa.

Por qué aún ocurrió el rechazo

La situación se está volviendo intrigante.

Una empresa que se dirige hacia una salida a bolsa, lo último que necesita en este momento crítico es problemas, sin embargo, eligió enfrentar la presión del gobierno de frente. ¿Es este un error de juicio empresarial o una apuesta calculada?

Poner las dos opciones una al lado de la otra hace que la lógica sea más clara.

Si comprometen, se salva el contrato, se mantienen las relaciones con el gobierno y el problema inmediato desaparece. Pero la narrativa de marca más fundamental de Anthropic de los últimos tres años — "la empresa de IA más responsable", "la seguridad primero" — desarrollará una grieta en este momento.

El mayor riesgo no es inmediato. Una vez que Claude se utilice realmente para vigilancia a gran escala o decisiones sobre armas autónomas, una vez que ocurra cualquier contratiempo, la pérdida no será solo un contrato, sino toda la tesis de valoración de la empresa. La prima que los inversores pagaron inicialmente por la historia de "IA Responsable" se evaporará de la noche a la mañana.

Si se rechaza, se perderán 200 millones de dólares, se activará una etiqueta de riesgo en la cadena de suministro y el mercado gubernamental estará esencialmente cerrado. Pero la narrativa de la marca "Seguridad Primero" ha recibido el respaldo público más caro de la historia. Ningún presupuesto de relaciones públicas podría comprar este efecto, siendo prohibido por el gobierno por negarse a permitir que la IA monitoree a los ciudadanos del país.

Hay una frase en la declaración de Dario que merece ser destacada: "Nuestra valoración y nuestros ingresos solo aumentan después de esta postura."

¿Es esta frase una declaración de relaciones públicas o un juicio empresarial? Podría ser ambas, pero no son contradictorias.

Hay un contraejemplo a considerar. Palantir, la empresa de datos mencionada anteriormente que utilizó IA para ayudar a la agencia federal de inmigración a rastrear objetivos, tomó un camino completamente opuesto. Se adaptó profundamente a cada demanda del gobierno, estando abierta al rastreo de inmigración, análisis de inteligencia y objetivos militares. Como resultado, fue rechazada por el círculo de capital socialmente responsable durante casi veinte años, incapaz de recaudar dinero durante mucho tiempo y excluida por los grandes fondos.

Luego, en 2024, cuando la narrativa militar de la IA se convirtió en la historia principal del mercado, su precio de acciones subió un 150% en un año, y su valor de mercado superó los 400 mil millones de dólares.

Dos caminos, dos destinos, cada uno con su propia lógica. Palantir intercambió veinte años de paciencia por la explosión de hoy. Anthropic está apostando por una lógica de valoración diferente: en la cada vez más feroz competencia homogénea entre las empresas de IA, la "IA más segura" no es solo una postura ética, sino un verdadero foso empresarial en el mundo real.

Cuál apuesta es mayor aún es desconocido. Pero Anthropic claramente cree que el costo del compromiso es mayor que el del rechazo.

¿Puede la apuesta de Dario dar frutos?

La respuesta a esta pregunta depende de varias variables que aún no se han materializado.

Primero, es la respuesta real de los clientes empresariales. ¿Cortarán activamente Amazon, Palantir y Anduril a Claude debido a la etiqueta de "riesgo de cadena de suministro" o elegirán quedarse quietos y esperar a que la situación cambie? Actualmente, estas empresas no han hecho una declaración pública. Si eligen esperar y ver, la pérdida real de Anthropic será de hecho solo el contrato gubernamental de 200 millones de dólares.

A continuación está la dificultad práctica del reemplazo gubernamental. Incluso el propio departamento del Pentágono que utiliza Claude internamente reconoce: Claude es actualmente uno de los modelos de IA más poderosos disponibles, con el Grok de Musk aún rezagado técnicamente. El reemplazo significa degradar el uso. ¿Quién asumirá este coste?

Por último, está el impacto inesperadamente amplio de este asunto. El mismo día en que se prohibió a Anthropic, Sam Altman, CEO de OpenAI, el desarrollador de ChatGPT, tomó públicamente una posición: OpenAI y Anthropic comparten la "misma línea roja" respecto al límite del uso militar de la IA, con ambas empresas adoptando una postura unificada.

En otras palabras, si el gobierno está buscando una alternativa que esté dispuesta a cumplir plenamente sin ninguna restricción, las opciones son mucho menos de lo que se imaginaba.

El proceso de armamentización de la IA no se ralentizará por esto. El Grok de Musk ya ha penetrado en la red clasificada del Pentágono, otras empresas de IA no han dejado pasar contratos militares, y los sistemas de armas asistidos por IA continúan iterando.

La elección de Anthropic no cambia esta trayectoria. Lo que cambia es dónde se sitúa en esta trayectoria.

Pero una cosa es cierta: esta es la primera vez en la historia de la industria de la IA que una empresa de renombre ha resistido abiertamente la presión del gobierno sobre principios explícitos, incluso si al final pagó el precio de ser prohibida. Independientemente del resultado de esta apuesta, este precedente ahora existe.

El último problema aritmético que queda para el lector: una empresa valorada en 380 mil millones de dólares, por el bien de dos principios escritos en un contrato, renunció a todo el mercado gubernamental y luego fue clasificada como un riesgo para la seguridad nacional.

En la era de armamentización acelerada por la IA de hoy, cómo calculas esta ecuación depende de lo que consideres la cosa más valiosa en el futuro.

Te puede gustar

Fundador de Wintermute: En el mercado perdido de las criptomonedas, ¿qué podemos hacer aún?

1.3 mil millones de deuda: BitDeer enfrenta una dura batalla

El problema matemático de Paradigm: 12 700 millones de dólares, una cifra demasiado elevada para un solo fondo de criptomonedas.

Ethereum presenta su hoja de ruta para la escalabilidad. ¿Qué hay de diferente esta vez?

Ola de prohibiciones antropológicas, controversia sobre la financiación de 100 000 millones de dólares de OpenAI: ¿De qué habla hoy la comunidad criptográfica internacional?

Block Reestructura con IA y Reduce 4,000 Puestos de Trabajo

Key Takeaways La restructuración de Block implica la supresión de más de 4,000 empleos, aproximadamente el 40% de…

Por qué la venta minorista se está moviendo de las criptomonedas a las acciones: ¿Regresarán?

Actividad minorista en criptomonedas ha disminuido significativamente mientras los operadores optan por activos más estables. Las proporciones de…

Canton Crypto Network vs. XRP: Analizando la Infraestructura y Necesidades de Liquidez del DTCC

El debate sobre si Canton Network podría reemplazar a XRP en la tecnología cripto para instituciones está en…

Axiom Crypto Revelado: ZachXBT Alega Insiderspor Trading de $400,000

Alegaciones revelan que empleados de Axiom Crypto usaron datos internos para obtener ganancias significativas. El esquema supuestamente implicaba…

Ethereum 2029 Roadmap: ETH se Convertirá en el Internet de Alta Velocidad del Valor

Puntos Clave 10,000 TPS y Finalidad Instantánea: El plan “Strawmap” de Ethereum busca alcanzar 10,000 transacciones por segundo…

India Tightens Crypto KYC Regulations With Live ID and Location Verifications

Key Takeaways: Under new guidelines issued on January 8, cryptocurrency exchanges in India are now classified as Virtual…

Predicción del Precio de Bitcoin: 500 Millones en Posiciones Cortas Han Sido Eliminadas — ¿Inicia un Nuevo Mercado Alcista?

Key Takeaways Reciente liquidación masiva: En las últimas 24 horas, se liquidaron aproximadamente $575 millones en posiciones, con…

Predicción del Precio de XRP: Ripple Invierte Billones para Conectar Bancos y Criptomonedas: ¿Puede XRP Alcanzar $1,000?

Key Takeaways Ripple ha invertido aproximadamente $4 mil millones para integrar la infraestructura criptográfica en sistemas financieros tradicionales,…

Google’s Gemini AI Predice el Precio de XRP, Dogecoin y Shiba Inu para 2026

Key Takeaways: Gemini AI estima un incremento del precio de XRP a $13, impulsado por la demanda institucional…

Predicción del Precio de Criptomonedas Hoy 26 de Febrero: XRP, Bitcoin y Ethereum

Key Takeaways: Bitcoin muestra señales de recuperación después de caer brevemente por debajo de los $63,000, elevando el…

¿Instituciones de Wall Street Adelantando al Mercado? Inversores Institucionales Inundaron Ethereum Antes de un Rally del 15%

Puntos Clave La Chispa: El discurso del Estado de la Unión de Donald Trump revitalizó el sentimiento de…

Animoca: Yat Siu pronostica que los Agentes de IA harán del 2026 el ‘Año de la Utilidad’

Yat Siu, cofundador de Animoca Brands, anticipa que 2026 será clave para la adopción masiva de blockchain y…

Incremento del Precio de Chainlink: ¿Qué Impulsa el Auge del LINK Hoy?

La integración de Chainlink con la red Canton impulsa la aprobación institucional y el aumento de precios. Chainlink…

Fundador de Wintermute: En el mercado perdido de las criptomonedas, ¿qué podemos hacer aún?

1.3 mil millones de deuda: BitDeer enfrenta una dura batalla

El problema matemático de Paradigm: 12 700 millones de dólares, una cifra demasiado elevada para un solo fondo de criptomonedas.

Ethereum presenta su hoja de ruta para la escalabilidad. ¿Qué hay de diferente esta vez?

Ola de prohibiciones antropológicas, controversia sobre la financiación de 100 000 millones de dólares de OpenAI: ¿De qué habla hoy la comunidad criptográfica internacional?

Block Reestructura con IA y Reduce 4,000 Puestos de Trabajo

Key Takeaways La restructuración de Block implica la supresión de más de 4,000 empleos, aproximadamente el 40% de…