اختلاف نظر در مورد OpenAI: قدرت، اعتماد و مرزهای غیرقابل کنترل هوش مصنوعی عمومی (AGI)

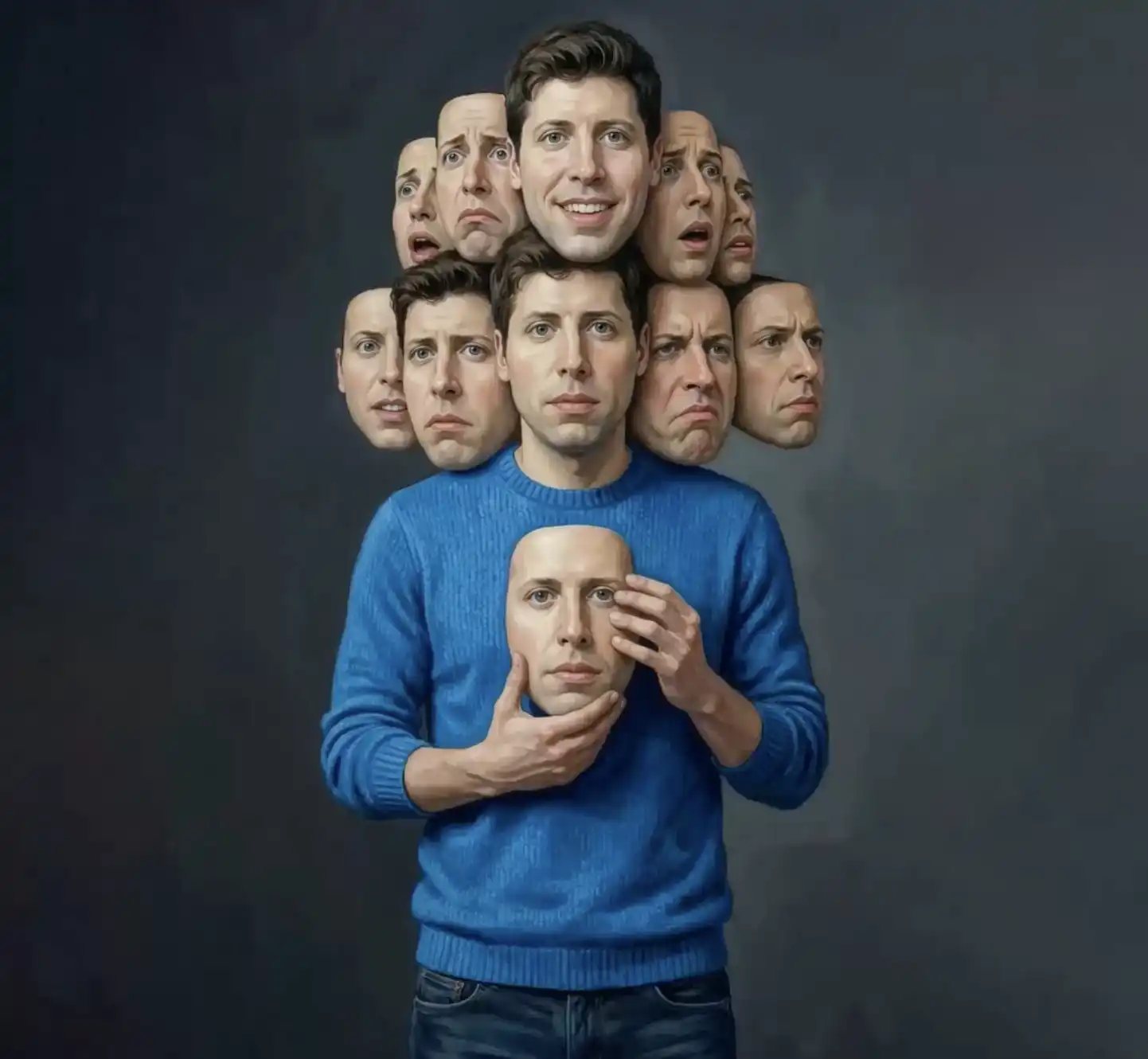

عنوان مقاله اصلی: سم آلتمن میتواند آینده ما را کنترل کند - آیا میتوان به او اعتماد کرد؟

نویسندگان مقاله اصلی: رونان فارو و اندرو مارانتز، نیویورکر

ترجمه: پگی، بلاک بیتس

یادداشت سردبیر: این مقاله، از طریق تعداد زیادی اسناد منتشر نشده و مصاحبههای عمیق، بحران داخلی OpenAI در مورد قدرت و اعتماد به سم آلتمن را مورد بررسی مجدد قرار میدهد. از برکناری هیئت مدیره گرفته تا انتصاب سریع مجدد در یک "تغییر جهت کودتاگونه"، این آشفتگی نه یک اتفاق یکباره، بلکه فوران متمرکزی از اختلافات دیرینه در حوزه مدیریت بود.

در هسته این مناقشه، کشمکش مداوم بین دو مجموعه منطق وجود دارد: از یک طرف، ماموریت غیرانتفاعی OpenAI که بر اساس «اولویت با ایمنی انسان» بنا شده است، و از طرف دیگر، تغییر تدریجی به سمت مسیر توسعهای که با تمرکز بر محصولات، مقیاس و درآمد همراه است، همزمان با نزدیک شدن به هوش مصنوعی عمومی و تسریع تجاریسازی. در این فرآیند، تعهدات ایمنی به طور مداوم تضعیف شده و قدرت و تصمیمگیری به تدریج در میان تعداد کمی متمرکز شده است.

بسیاری از چهرههای کلیدی، از جمله ایلیا ساتسکور و داریو آمودی، آلتمن را زیر سوال بردهاند و با تمرکز بر ابهام اطلاعات و بیان استراتژیک، معتقدند که سبک رهبری او برای اداره قوی فناوری که «سرنوشت بشریت را تغییر خواهد داد» کافی نیست؛ با این حال، حامیان او تأکید میکنند که توانایی او در ادغام منابع، بهرهبرداری از سرمایه و اجرا، کلید گسترش سریع OpenAI است.

وقتی قدرت تکنولوژیکی برای تأثیرگذاری بر نظم جهانی کافی است، آیا ساختار حاکمیت شرکتی موجود هنوز برای محدود کردن افراد کافی است؟ به عبارت دیگر، در عصر هوش مصنوعی، عدم قطعیت واقعی نه تنها ممکن است از خود فناوری ناشی شود، بلکه از کسانی که فناوری را کنترل میکنند نیز ناشی میشود.

در زیر اصل مقاله آمده است:

قدرت و اعتماد: شکافهای مدیریتی تحت رهبری آلتمن

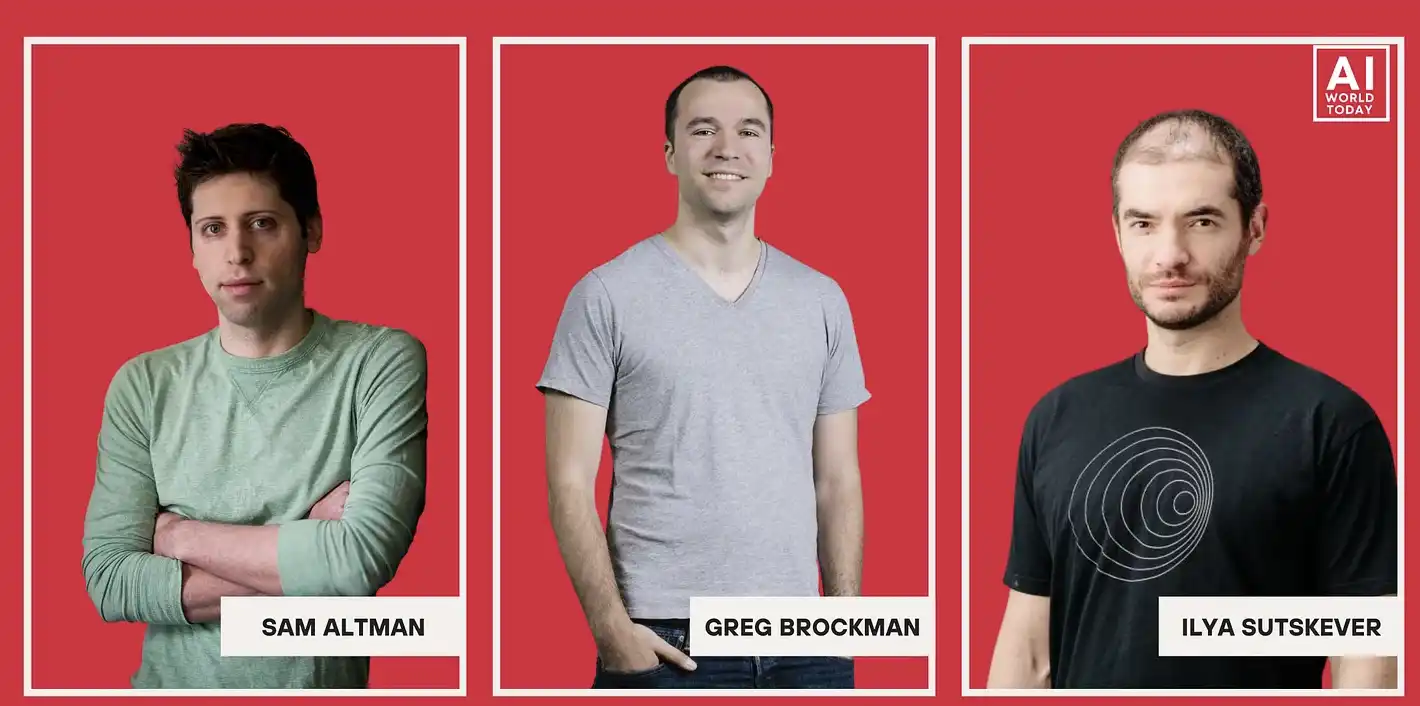

در پاییز ۲۰۲۳، ایلیا ساتسکور، دانشمند ارشد OpenAI، یادداشتی محرمانه برای سه عضو دیگر هیئت مدیره این شرکت ارسال کرد. در هفتههای قبل، آنها بهطور خصوصی در مورد یک موضوع حساس بحث میکردند: اینکه آیا مدیرعامل شرکت، سم آلتمن، و معاونش گرگ بروکمن، هنوز صلاحیت ادامه رهبری شرکت را دارند یا خیر.

منبع تصویر: دنیای هوش مصنوعی امروز

ساتسکور زمانی آن دو را دوست میدانست. در سال ۲۰۱۹، او حتی مراسم عروسی بروکمن را در دفتر OpenAI برگزار کرد، جایی که حتی یک بازوی رباتیک به عنوان «حامل حلقه» عمل میکرد.

اما هرچه او بیشتر متقاعد میشد که شرکت به هدف بلندمدت خود - ایجاد هوش مصنوعی که بتواند با قابلیتهای شناختی انسان برابری کند یا از آن پیشی بگیرد - نزدیک میشود، تردیدهایش در مورد آلتمن عمیقتر میشد. همانطور که او در آن زمان به یکی دیگر از اعضای هیئت مدیره گفت: «فکر نمیکنم سم کسی باشد که باید انگشتش روی دکمه باشد.»

به درخواست سایر اعضای هیئت مدیره، ساتسکور به همراه همکاران همفکر خود، سندی در حدود هفتاد صفحه، شامل گزارشهای چت Slack، فایلهای منابع انسانی و توضیحات مربوطه، تهیه کردند. برخی از محتوا حتی اسکرینشاتهایی بودند که با تلفن گرفته شده بودند، ظاهراً برای جلوگیری از رصد شدن توسط دستگاههای شرکت. او در نهایت این یادداشتها را به شیوهی «بخوان و بسوزان» برای سایر اعضای هیئت مدیره ارسال کرد تا مطمئن شود افراد بیشتری آنها را نخواهند دید.

یکی از کارگردانانی که این مطالب را دریافت کرده بود، به یاد میآورد: «او در آن زمان واقعاً ترسیده بود.» ما این یادداشتها را که قبلاً هرگز به طور کامل فاش نشده بودند، بررسی کردیم. این اسناد، آلتمن را به تحریف حقایق برای مدیران و اعضای هیئت مدیره و رفتار فریبکارانه پیرامون پروتکلهای امنیت داخلی متهم کرد. یکی از یادداشتها درباره آلتمن با فهرستی از موارد با عنوان «سم دائماً نشان داده است...» شروع میشد که اولین مورد آن «دروغگویی» بود.

بسیاری از شرکتهای فناوری ادعا میکنند که «دنیا را به جای بهتری تبدیل میکنند»، اما عملیات واقعی آنها حول محور به حداکثر رساندن درآمد میچرخد. با این حال، قرار بود اصل بنیادی OpenAI با این مدل متفاوت باشد. بنیانگذاران آن، از جمله آلتمن، ساتسکور، بروکمن و ایلان ماسک، معتقد بودند که هوش مصنوعی میتواند یکی از قدرتمندترین و بالقوه خطرناکترین اختراعات در تاریخ بشر باشد. در مقابل این «ریسک وجودی»، شرکت ممکن است به یک ساختار سازمانی غیرمتعارف نیاز داشته باشد.

OpenAI در ابتدا به عنوان یک سازمان غیرانتفاعی تأسیس شد و هیئت مدیره آن وظیفه داشت «ایمنی تمام بشریت» را بالاتر از موفقیت شرکت قرار دهد، حتی آن را بر بقای خود شرکت اولویت دهد. مدیرعامل باید از شخصیت و اخلاق فوقالعادهای برخوردار باشد.

همانطور که ساتسکور بیان کرد، «هر کسی که در ساخت این فناوری که میتواند تمدن را به شکلی که ما میشناسیم تغییر دهد، نقش داشته باشد، مسئولیتی سنگین و وظیفهای بیسابقه را بر عهده دارد.» اما او همچنین خاطرنشان کرد که «کسانی که در این موقعیتها قرار میگیرند، اغلب از یک نوع خاص هستند - افرادی که تشنه قدرت هستند، از نوع سیاستمداران، یا کسانی که صرفاً از قدرت به خاطر خود آن لذت میبرند.» او در یکی از یادداشتها، نگرانی خود را در مورد سپردن این فناوری به کسی که «فقط چیزهایی را میگوید که دیگران میخواهند بشنوند» ابراز کرد.

اگر در نهایت مشخص شود که مدیرعامل OpenAI غیرقابل اعتماد است، این هیئت مدیره شش نفره قدرت برکناری او را دارد. برخی از مدیران، از جمله هلن تونر، متخصص سیاستهای هوش مصنوعی و تاشا مککالی، کارآفرین، پس از خواندن این یادداشتها، نسبت به قضاوت قبلی خود متقاعدتر شدند: آنچه آلتمن فرض میکرد مسئولیتی در رابطه با آینده بشریت بود، اما خودش قابل اعتماد نبود.

کودتای هیئت مدیره: سم آلتمن اخراج شد

در آن زمان، سم آلتمن در لاس وگاس مشغول تماشای مسابقات فرمول یک بود که ایلیا ساتسکور او را به یک تماس ویدیویی با هیئت مدیره دعوت کرد و بیانیه کوتاهی را خواند و اعلام کرد که دیگر کارمند OpenAI نیست. هیئت مدیره، تحت نظر مشاور حقوقی، بیانیهای عمومی صادر کرد و اظهار داشت که آلتمن به دلیل «عدم حفظ مداوم صداقت در ارتباطات» برکنار شده است.

این تصمیم بسیاری از سرمایهگذاران و مدیران OpenAI را شوکه کرد. مایکروسافت که حدود ۱۳ میلیارد دلار در OpenAI سرمایهگذاری کرده بود، نیز در آخرین لحظه قبل از اجرای تصمیم از این خبر مطلع شد. ساتیا نادلا، مدیرعامل مایکروسافت، بعدها به یاد آورد: «من در آن زمان فوقالعاده شگفتزده شدم.» «من نتوانستم اطلاعات بیشتری از کسی بگیرم.» او سپس با رید هافمن (از بنیانگذاران لینکدین، سرمایهگذار OpenAI و مدیر مایکروسافت) تماس گرفت، که او هم از همه جا شروع به پرسوجو کرد که آیا آلتمن مرتکب تخلف آشکاری شده است یا خیر. هافمن به ما گفت: «من در آن زمان کاملاً گیج شده بودم.» ما دنبال مسائلی مثل اختلاس یا مزاحمت بودیم، اما چیزی پیدا نکردم.»

سایر شرکای تجاری نیز به همین ترتیب غافلگیر شدند. وقتی آلتمن با ران کانوی، سرمایهگذار، تماس گرفت تا اخراجش را به او اطلاع دهد، کانوی مشغول صرف ناهار با نانسی پلوسی، نماینده کنگره آمریکا، بود و او همان لحظه گوشی را به او داد. او به کانوی گفت: «بهتر است هر چه زودتر اینجا را ترک کنی.»

در همین حال، OpenAI در آستانهی تکمیل یک دور تأمین مالی بزرگ از شرکت سرمایهگذاری خطرپذیر Thrive Capital بود که توسط جاش کوشنر، برادر جارد کوشنر که آلتمن سالها او را میشناخت، تأسیس شده بود. این معامله میتوانست ارزش OpenAI را به ۸۶ میلیارد دلار برساند و به بسیاری از کارمندان اجازه دهد میلیونها دلار از مزایای سهام را نقد کنند. کوشنر تازه جلسهای با ریک روبین، تهیهکننده موسیقی، را تمام کرده بود که تماس از دست رفته آلتمن را دید و آن را برگرداند. او بعداً به یاد آورد: «ما بلافاصله وارد حالت نبرد شدیم.»

آلتمن در روز اخراجش، به عمارت ۲۷ میلیون دلاریاش در سانفرانسیسکو، که مشرف به کل خلیج با یک استخر بینهایتِ کنسولشده بود، پرواز کرد و در آنجا یک مرکز فرماندهی موقت راهاندازی کرد که آن را «نوعی دولت تبعیدی» نامید. کانوی، برایان چسکی، یکی از بنیانگذاران Airbnb، و کریس لهان، مسئول روابط عمومی مشهور به مبارزهطلبی در بحران، از طریق ویدیو و تلفن به این گفتگو پیوستند و گاهی ساعتها بیوقفه صحبت میکردند. بعضی از اعضای تیم اجرایی آلتمن حتی در راهروهای خانه چادر زده بودند. وکلا در دفتر کار خانگی او که کنار اتاق خواب بود مستقر شدند. آلتمن در طول دورههای بیخوابی، با لباس خوابش مدام اینطرف و آنطرف میرفت. او در مصاحبهای اخیر، این تجربه پس از شلیک را «نوعی حالت گریز عجیب» توصیف کرد.

با سکوت هیئت مدیره، تیم مشاوره آلتمن شروع به ساختن روایتی برای بازگشت او کرد. لهان اصرار داشت که این اخراج در واقع یک «کودتا» بود که توسط «نوعدوستان مؤثر» ترتیب داده شده بود، طرفداران یک سیستم فکری که بر به حداکثر رساندن رفاه کلی انسان تأکید دارند و هوش مصنوعی را یک تهدید وجودی میدانند. (هافمن همچنین در آن زمان به نادلا پیشنهاد داد که این اخراج ممکن است به دلیل «نوعی جنون نوعدوستانهی مؤثر» باشد.) لهان، که شعار رایجش از مایک تایسون وام گرفته شده بود: «هر کسی تا وقتی که مشت به صورتش نخورده، برنامهای دارد»، به آلتمن پیشنهاد داد که یک حملهی جسورانه در رسانههای اجتماعی راهاندازی کند. چسکی با کارا سویشر، روزنامهنگار حوزه فناوری، در تماس بود و دائماً انتقادات خود از هیئت مدیره را به دنیای بیرون منعکس میکرد.

هر عصر ساعت شش، آلتمن از «اتاق جنگ» خود بیرون میآمد تا برای خودش یک نوشیدنی نگرونی بریزد. او به یاد آورد که به اطرافیانش گفته بود: «شما باید آرام باشید؛ آنچه قرار است اتفاق بیفتد، اتفاق خواهد افتاد.» با این حال، او اضافه کرد که گزارش تماسها نشان میدهد که او در آن مدت بیش از دوازده ساعت در روز با تلفن صحبت میکرده است.

یک منبع فاش کرد که آلتمن در مقطعی به میرا موراتی، که در آن زمان به عنوان مدیرعامل موقت OpenAI خدمت میکرد، گفته بود که متحدانش «با تمام قوا» در تلاشند تا «کثیفی به پا کنند» تا او و دیگرانی را که در تلاش برای برکناری او بودند، بدنام کنند. (خود آلتمن ادعا میکند که این مکالمه را به خاطر نمیآورد.)

ظرف چند ساعت پس از اخراج او، Thrive Capital سرمایهگذاری برنامهریزیشده خود را متوقف کرد و روشن ساخت که تنها در صورت بازگشت سم آلتمن، این معامله انجام خواهد شد و کارمندان از مزایای سهام خود بهرهمند خواهند شد. سوابق پیامکها در آن زمان نشان میداد که آلتمن مرتباً با ساتیا نادلا در ارتباط بوده است. (در تنظیم بیانیه مشترک، آلتمن پیشنهاد داد که عبارت «ساتیا و من در حال حاضر اولویت اصلیمان نجات OpenAI است» را بنویسیم، در حالی که نادلا عبارت متفاوتی را پیشنهاد داد: «اطمینان حاصل کنید که OpenAI به رشد خود ادامه میدهد.»)

وارونگی قدرت: آلتمن پس از ۵ روز به سرعت به کار خود بازگشت

کمی بعد، مایکروسافت اعلام کرد که یک پروژه رقابتی برای آلتمن و هر کارمندی که OpenAI را ترک کرده باشد، راهاندازی خواهد کرد. همزمان، نامهای عمومی مبنی بر درخواست بازگشت آلتمن در شرکت شروع به گردش کرد. برخی که در ابتدا برای امضا مردد بودند، تماسها و پیامهای التماسآمیزی از همکارانشان دریافت کردند. در نهایت، اکثر کارمندان OpenAI در حمایت از آلتمن تهدید به استعفای دسته جمعی کردند.

تخته به گوشهای رانده شد. هلن تونر با اشاره به لغو تصمیم اخراج گفت: «کنترل Z، این هم یک گزینه است.» گزینه دیگر فروپاشی کامل است.» حتی میرا موراتی، مدیرعامل موقت وقت، سرانجام نامه عمومی را امضا کرد. متحدان آلتمن تلاش کردند تا ایلیا ساتسکور را متقاعد کنند که موضع خود را تغییر دهد. همسر بروکمن، آنا، حتی در دفتر به او نزدیک شد و گفت: «تو آدم خوبی هستی، میتوانی این را درست کنی.» ساتسکور بعداً در شهادت خود در دادگاه توضیح داد: «من در آن زمان احساس کردم که اگر ما در مسیری حرکت کنیم که سم دیگر برنگردد، OpenAI نابود خواهد شد.»

یک شب، آلتمن قرص خوابآور آمبین را خورد و همسرش، برنامهنویس استرالیایی، الیور مولهرین، او را از خواب بیدار کرد. مولهرین به او گفت که موقعیت ساتسکور متزلزل است و پیشنهاد داد که آلتمن فوراً با هیئت مدیره ارتباط برقرار کند. آلتمن به یاد میآورد: «من در نوعی حالت گیجی ناشی از مصرف آمبین از خواب بیدار شدم، و کاملاً گیج بودم و با خودم فکر کردم، 'الان هیچ راهی وجود ندارد که بتوانم با هیئت مدیره صحبت کنم.'»

در یک سری تماسهای تلفنی پرتنش، سم آلتمن خواستار استعفای اعضای هیئت مدیرهای شد که برای اخراج او فشار آورده بودند. با تأمل در مورد ایده بازگشت، واکنش اولیه خود را اینگونه به یاد آورد: «من قرار است کثیفکاریهای آنها را در این محیط فوقالعاده مشکوک تمیز کنم؟» او گفت: «با خودم فکر کردم، به هیچ وجه نه.» در نهایت، ایلیا ساتسکور، هلن تونر و تاشا مککالی کرسیهای هیئت مدیره خود را از دست دادند و تنها آدام دیآنجلو (یکی از بنیانگذاران کورا) به عنوان عضو اصلی هیئت مدیره باقی ماند.

به عنوان بخشی از شرایط استعفا، این اعضای هیئت مدیره درخواست تحقیق در مورد اتهامات علیه آلتمن - از جمله ایجاد تفرقه بین مدیران و پنهان کردن روابط مالی - را کردند. آنها همچنین خواستار ایجاد هیئت جدیدی برای نظارت مستقل بر تحقیقات خارجی شدند. با این حال، دو مدیر جدید منصوب شده - لارنس سامرز، رئیس سابق دانشگاه هاروارد و برت تیلور، مدیر ارشد فناوری سابق فیسبوک - پس از ارتباط نزدیک با آلتمن انتخاب شدند. آلتمن به ساتیا نادلا پیامک داد: «به نظر شما این [طرح] با حضور برت، لری سامرز و آدام در هیئت مدیره، من به عنوان مدیرعامل و برت به عنوان رهبر تحقیقات، جواب میدهد؟» (مککالی بعداً شهادت داد که وقتی تیلور برای هیئت مدیره در نظر گرفته میشد، نگران بود که تیلور بیش از حد نسبت به آلتمن احترام قائل باشد.)

کمتر از پنج روز پس از اخراج، آلتمن دوباره به کار خود بازگشت. کارمندان شرکت بعداً از این دوره به عنوان «Blip» یاد کردند که برگرفته از یک نقطه داستانی از یک فیلم مارول بود - یک ناپدید شدن کوتاه و سپس بازگشت، اما جهان به دلیل غیبت آنها اساساً تغییر کرده بود.

با این حال، جنجال پیرامون قابل اعتماد بودن آلتمن مدتها پیش فراتر از هیئت مدیره OpenAI رفته بود. همکارش که اخراج او را برنامهریزی کرده بود، او را به رفتار گمراهکنندهی فراگیر متهم کرد، که برای هر مدیر اجرایی شرکتی غیرقابل قبول است، چه برسد به رهبری که چنین فناوری متحولکنندهای را در اختیار دارد. میرا موراتی به ما گفت: «ما به کنترلهایی بر قدرت نیاز داریم که متناسب با آن قدرت باشند.» هیئت مدیره درخواست بازخورد کرده بود و من فقط آنچه را که دیدم صادقانه به اشتراک گذاشتم و از آن حمایت میکنم. از سوی دیگر، حامیان آلتمن مدتها این ادعاها را کماهمیت جلوه داده بودند. پس از اخراج، ران کانوی، سرمایهگذار، به برایان چسکی و کریس لهان پیام داد و خواستار یک حمله متقابل روابط عمومی شد: «این موضوع به اعتبار سم مربوط میشود.» او همچنین به واشنگتن پست گفت که «هیئت مدیرهای که از کنترل خارج شده» با آلتمن ناعادلانه رفتار میکند.

از آن زمان، OpenAI به یکی از ارزشمندترین شرکتهای جهان تبدیل شده است و طبق گزارشها، خود را برای عرضه اولیه سهام (IPO) بالقوه تریلیون دلاری آماده میکند. در همین حال، آلتمن در حال پیشبرد یک زیرساخت عظیم هوش مصنوعی است و برخی از تلاشهایش به رژیمهای اقتدارگرای خارج از کشور نیز گسترش یافته است. OpenAI همچنین در حال پیگیری قراردادهای بزرگ دولتی است و به تدریج استانداردهایی را برای کاربردهای هوش مصنوعی در اجرای قوانین مهاجرت، نظارت داخلی و سلاحهای خودکار در مناطق جنگی تعیین میکند.

سم آلتمن با ترسیم مداوم چشماندازی بزرگ از آینده، رشد OpenAI را هدایت کرده است. او در یک پست وبلاگ در سال ۲۰۲۴ نوشت: «پیروزیهای نفسگیر - حل تغییرات اقلیمی، ایجاد مستعمرات خارج از جهان، کشف تمام قوانین فیزیکی - در نهایت همه چیز عادی خواهد شد.» این روایت، زیربنای یکی از سریعترین استارتآپهای تاریخ است که به شدت به بودجهی شرکای با اهرم بالا وابسته است. اقتصاد ایالات متحده به طور فزایندهای به تعداد انگشتشماری از شرکتهای هوش مصنوعی با اهرم بالا وابسته است، و بسیاری از کارشناسان - از جمله خود آلتمن در برخی مواقع - نسبت به خطر حباب در این صنعت هشدار میدهند. او سال گذشته به خبرنگاران گفت: «یک نفر قرار است پول زیادی از دست بدهد.» اگر این حباب بترکد، میتواند فاجعه اقتصادی به بار آورد؛ با این حال، اگر خوشبینانهترین پیشبینیهای او به حقیقت بپیوندد، او میتواند به یکی از ثروتمندترین و قدرتمندترین افراد جهان نیز تبدیل شود.

در یک تماس تلفنی پرتنش پس از اخراج آلتمن، هیئت مدیره از او خواست که الگوی رفتار گمراهکنندهاش را بپذیرد. به گفته منابع حاضر، او بارها گفته است: «این مسخره است» و اظهار داشته است: «من نمیتوانم خودم را تغییر دهم.» آلتمن بعداً ادعا کرد که هیچ خاطرهای از آن مکالمه ندارد. او بعداً برای ما توضیح داد: «فکر میکنم شاید چیزی که میخواستم بگویم بیشتر شبیه این بود که بگویم 'من همیشه سعی کردهام وحدتبخش باشم'» و موفقیت خود در رهبری یک شرکت فوقالعاده موفق را به این ویژگی نسبت داد. او این انتقادات را به تمایل اوایل دوران کاریاش برای «پرهیز بیش از حد از درگیری» نسبت داد. با این حال، یکی از اعضای هیئت مدیره تفسیر کاملاً متفاوتی ارائه داد: «منظور واقعی او این بود - 'من این چیزی را دارم که در آن به مردم دروغ میگویم و متوقف نخواهم شد.'»

ماموریت رانش: از اولویت امنیت تا اولویت کسب و کار

و بنابراین، یک سوال اساسیتر مطرح شد: آیا آن همکاران از روی تعصب و خصومت شخصی برای برکناری او پافشاری میکردند، یا قضاوتشان درست بود و آلتمن واقعاً غیرقابل اعتماد بود؟

امسال، یک صبح زمستانی، ما آلتمن را در دفتر مرکزی OpenAI در سانفرانسیسکو ملاقات کردیم، که یکی از بیش از دوازده مکالمهای بود که برای این مقاله انجام دادیم. این شرکت اخیراً به دو برج شیشهای یازده طبقه نقل مکان کرده بود که یکی از آنها قبلاً میزبان یکی دیگر از غولهای فناوری، یعنی اوبر، بود. تراویس کالانیک، یکی از بنیانگذاران و مدیرعامل سابق اوبر، تا قبل از اینکه در سال ۲۰۱۷ به دلیل مسائل اخلاقی از کار برکنار شود، به عنوان یک کارآفرین نابغه و شکستناپذیر شناخته میشد. (کالانیک اکنون یک استارتاپ رباتیک را اداره میکند؛ او گفته است که در اوقات فراغت خود، از ChatGPT شرکت OpenAI برای «کاوش در مرزهای فیزیک کوانتومی» استفاده میکند.)

یکی از کارمندان، فضای اداری را برای ما به نمایش گذاشت. در فضایی پر از میزهای بلند مشترک و نور طبیعی، یک نقاشی دیجیتال پویا از دانشمند کامپیوتر، آلن تورینگ، وجود داشت که چشمانش هنگام حرکت ما را دنبال میکرد. این نصب به وضوح اشارهای به «آزمون تورینگ» بود - آزمایش فکری سال ۱۹۵۰ برای تعیین اینکه آیا یک ماشین میتواند به طور قانعکنندهای از انسان تقلید کند یا خیر. (در مطالعهای در سال ۲۰۲۵، عملکرد ChatGPT در این آزمون در واقع از عملکرد انسانهای واقعی پیشی گرفت.) معمولاً نقاشی تعاملی بود. اما راهنمای ما توضیح داد که ویژگی صوتی آن غیرفعال شده است زیرا دائماً مکالمات بین کارمندان را «استراق سمع» میکرد و مرتباً وسط حرفهایشان میپرید. در جای دیگری از دفتر، تابلوهایی با عنوان «هوش مصنوعی عمومی را حس کنید» قابل مشاهده بودند - شعاری که در ابتدا توسط ایلیا ساتسکور ابداع شد تا خطرات هوش مصنوعی عمومی پیشرفته (نقطهای که در آن ماشینها به توانایی شناختی در سطح انسان دست مییابند) را به همکاران یادآوری کند. پس از حادثهی بلیپ، این عبارت به تکیهکلام شادیبخشی برای تجلیل از آیندهای پررونق تبدیل شده بود.

در یک اتاق کنفرانس معمولی در طبقه هشتم، سم آلتمن را پیدا کردیم. او گفت: «قبلاً میشنیدم که مردم درباره خستگی تصمیمگیری صحبت میکنند، و من هرگز آن را درک نکرده بودم.» «حالا هر روز یک ژاکت خاکستری و شلوار جین میپوشم، و حتی وقتی میخواهم کدام ژاکت خاکستری را از کمد بیرون بیاورم، با خودم میگویم کاش مجبور نبودم این تصمیم را بگیرم.»

آلتمن با هیکلی لاغر، چشمان آبی با فاصله زیاد و موهای کمی ژولیده، همیشه جوان به نظر میرسید، اما چهل ساله بود. او و الیور مولهرین از طریق رحم اجارهای صاحب یک پسر یک ساله شدهاند. او در حالی که به یکی از ما و سپس به دیگری نگاه میکرد، گفت: «فکر میکنم رئیس جمهور ایالات متحده بودن مطمئناً فشار بیشتری دارد، اما از بین تمام کارهایی که فکر میکنم میتوانم واقعاً انجام دهم، این کاری است که میتوانم تصور کنم بیشترین فشار را داشته باشد.» «من آن را برای دوستانم اینگونه توصیف کردهام: «تا روزی که ChatGPT را راهاندازی کردیم، این جالبترین شغل دنیا بود.» قبل از آن، ما در حال انجام این پیشرفتهای علمی عظیم بودیم - من فکر میکردم که این یکی از مهمترین اکتشافات علمی در دهههای اخیر است. نگاهش را پایین انداخت. «اما از زمانی که ChatGPT راهاندازی شده، همه تصمیمگیریها بسیار سخت شدهاند.»

آلتمن در کلیتون، میسوری، حومه مرفه سنت لوئیس، به عنوان بزرگترین فرزند از چهار فرزند خانواده بزرگ شد. مادرش، کانی گیبستاین، متخصص پوست و پدرش، جری آلتمن، یک مشاور املاک بود که در طرحهای مسکن نیز فعالیت داشت. او در یک معبد یهودی اصلاحطلب بزرگ شد، در یک مدرسه مقدماتی خصوصی تحصیل کرد و بعدها آن را «جای آسانی برای آشکارسازی همجنسگرایی» توصیف کرد. با این حال، در مجموع، جامعهی طبقهی متوسط رو به بالایی که او در آن بود، نسبتاً لیبرال بود.

حدود شانزده یا هفده سالگی، او شبی را در یک محلهی همجنسگرایانمحور در سنت لوئیس، مورد حملهی فیزیکی جدی و توهینهای همجنسگراستیزانه قرار گرفت. آلتمن این حادثه را گزارش نکرد و تمایلی به ارائه جزئیات بیشتر نداشت و اظهار داشت که شرح کاملتر «اینطور به نظر میرسد که من در حال دستکاری مردم یا جلب همدردی آنها بودهام.» او این تجربه و اهمیت گرایش جنسیاش را برای هویتش کماهمیت جلوه داد. اما او همچنین اذعان کرد: «احتمالاً از نظر روانشناختی چیزی بسیار عمیق در اینجا وجود دارد، در مورد این احساس که من آشکارسازی کردهام اما در واقع این کار را نکردهام - برای جلوگیری از درگیری بیشتر.»

برادرش در مصاحبهای با نیویورکر در سال ۲۰۱۶، شخصیت دوران کودکی او را اینگونه توصیف کرد: «من باید برنده شوم و باید همه چیز را کنترل کنم». آلتمن بعدها به دانشگاه استنفورد رفت و مرتباً در بازیهای پوکر خارج از دانشگاه شرکت میکرد. احساس میکنم آنجا بیشتر از دانشگاه در مورد زندگی و تجارت یاد گرفتم.»

دوران Y Combinator: جنجال اغراق و اعتماد

دانشجویان استنفورد جاهطلب هستند، اما عملگراترین آنها اغلب ترک تحصیل را انتخاب میکنند. آلتمن در پایان سال دوم دانشگاه، به ماساچوست رفت تا به اولین گروه کارآفرینان برنامهی رشد استارتآپهای Y Combinator بپیوندد. این موسسه توسط مهندس نرمافزار مشهور، پل گراهام، تأسیس شد. هر شرکتکننده با یک ایده استارتاپی به این رویداد پیوست. (در میان اعضای گروه او، تیمهایی بودند که بعدها ردیت و توییچ را تأسیس کردند.) پروژه آلتمن بعدها Loopt نام گرفت، یک محصول اولیه شبکه اجتماعی که به دوستان اجازه میداد با ردیابی موقعیت مکانی تلفنهای تاشوی یکدیگر، موقعیت مکانی یکدیگر را ببینند. این شرکت هم تواناییهای اجرایی او و هم تمایلش به ایجاد فضا برای خودش در مناطق خاکستری را به نمایش گذاشت. در آن زمان، مقررات فدرال، اپراتورها را ملزم میکرد که در مواقع اضطراری بتوانند موقعیت تلفن را پیدا کنند و آلتمن با اپراتورها قراردادهایی منعقد کرد تا این قابلیت را در محصول خود بگنجاند.

بیشتر کارمندان در دوران لوپت، سم آلتمن را دوست داشتند، اما برخی از آنها از تمایل او به «اغراق» حتی در مورد مسائل بیاهمیت شگفتزده بودند. برخی به یاد میآورند که آلتمن مدام از قهرمان پینگپنگ بودنش «مثل قهرمان پینگپنگ دبیرستان میسوری» تعریف میکرد، اما در نهایت تبدیل به یکی از بدترین بازیکنان شرکت شد. (آلتمن گفت که احتمالاً فقط یک شوخی بوده است.) یکی از کارمندان قدیمی لوپت، مارک جاکوبستین، توسط سرمایهگذاران به عنوان «سرپرست» آلتمن منصوب شد و او بعداً در زندگینامه کیچ هیگی، «خوشبین» اظهار داشت: «بین «فکر میکنم میتوانم این کار را انجام دهم» و «این کار را انجام دادهام» یک منطقه خاکستری وجود دارد و در شدیدترین شکل خود، این ابهام میتواند به نتایجی مانند آنچه در ترانوس رخ داد، منجر شود.»

به گفته هاگی، به دلیل نگرانیها در مورد سبک رهبری آلتمن و عدم شفافیت، برخی از کارمندان ارشد لوپ دو بار به هیئت مدیره پیشنهاد دادند که او را از سمت مدیرعاملی برکنار کنند. با این حال، در همان زمان، او جذابیت شخصی قویای نیز داشت. یکی از کارمندان سابق به یاد میآورد که یکی از اعضای هیئت مدیره مستقیماً پاسخ داد: «این شرکت سم است، برگرد سر کارت.» (با این حال، برخی از اعضای هیئت مدیره نیز جدی بودن این تلاشهای برکناری را انکار کردند.)

لوپت هیچوقت شاهد بهبود در رشد کاربران نبود و در نهایت در سال ۲۰۱۲ توسط یک شرکت فینتک خریداری شد. به گفته منابع داخلی، این خرید تا حد زیادی به آلتمن کمک کرد تا «با خوشرویی از شرکت خارج شود». با این حال، تا سال ۲۰۱۴، زمانی که پاول گراهام از Y Combinator بازنشسته شد، او همچنان آلتمن را به عنوان جانشین خود انتخاب کرد. گراهام به نیویورکر گفت: «من در آشپزخانه خودم از او پرسیدم، او طوری لبخند زد که انگار همه چیز سر جای خودش قرار گرفته است.» من هیچوقت لبخند مهارنشدنی سم رو ندیده بودم، مثل اون لبخندی که وقتی یه توپ کاغذی رو تا ته سطل آشغال پرت میکنی، نشون میدی.»

این سمت جدید، آلتمنِ ۲۸ ساله را به یک «سلطانساز» تبدیل کرد. وظیفه او غربالگری جاهطلبترین و آیندهدارترین کارآفرینان، ارتباط دادن آنها با برنامهنویسان و سرمایهگذاران برتر و کمک به آنها برای ساختن شرکتهای انحصاری پیشرو در صنعت بود (در همین حال، YC 6 تا 7 درصد سهام را دریافت میکرد).

تحت رهبری او، Y Combinator به سرعت گسترش یافت و تعداد پروژههای در حال توسعه از دهها به صدها پروژه رسید. اما برخی از سرمایهگذاران سیلیکون ولی کمکم به این باور رسیدند که منافع او کاملاً همسو نیست. یک سرمایهگذار به ما گفت که آلتمن «شخصاً و به صورت گزینشی در شرکتهای با بالاترین کیفیت سرمایهگذاری میکند تا سرمایهگذاران خارجی را کنار بگذارد» (آلتمن این ادعا را تکذیب کرد). او همچنین به عنوان یک سرمایهگذار برای Sequoia Capital فعالیت کرد و در سرمایهگذاریهای پروژههای اولیه شرکت کرد و برخی از بازدهها را دریافت کرد.

به گفته منابع، وقتی آلتمن به عنوان یک سرمایهگذار فرشته در شرکت فینتک استرایپ سرمایهگذاری کرد، اصرار داشت که درصد بیشتری از سهام را به دست آورد، رویه ای که در داخل شرکت سکویا را ناراضی کرد. این منبع اظهار داشت که این نشان دهنده یک استراتژی "Sam-first" است. (آلتمن این ادعا را رد کرد.) او حدود سال ۲۰۱۰ حدود ۱۵۰۰۰ دلار در Stripe سرمایهگذاری کرد و حدود ۲٪ از سهام آن را در اختیار داشت و اکنون ارزش این شرکت بیش از ۱۵۰ میلیارد دلار است.) آلتمن ادعا کرد که در حدود ۴۰۰ شرکت سرمایهگذاری کرده است.

تا سال ۲۰۱۸، چندین شریک Y Combinator از رفتار آلتمن ناراضی بودند و آن را به گراهام گزارش دادند. متعاقباً، گراهام گفتگوی صریحی با همسرش و یکی از بنیانگذاران YC، جسیکا لیوینگستون، و آلتمن داشت. پس از آن، گراهام علناً اعلام کرد که اگرچه آلتمن به صورت شفاهی موافقت خود را برای ترک شرکت اعلام کرده، اما در عمل کنارهگیری نکرده است.

آلتمن به برخی از شرکا اطلاع داد که از سمت ریاست استعفا خواهد داد اما همچنان به عنوان رئیس هیئت مدیره باقی خواهد ماند. در ماه مه ۲۰۱۹، Y Combinator یک پست وبلاگی منتشر کرد و رئیس جدید را معرفی کرد، به همراه یادداشتی با این مضمون که «سم به سمت رئیس YC منتقل میشود». چند ماه بعد، این جمله به «سم آلتمن از هرگونه نقش عملیاتی در YC کنارهگیری کرده است» اصلاح شد و سپس این جمله به طور کامل حذف شد. با این وجود، تا سال ۲۰۲۱، آلتمن همچنان به عنوان رئیس Y Combinator در ایالات متحده ذکر شده بود. پروندههای کمیسیون بورس و اوراق بهادار. (آلتمن گفته است که او بعداً از این موضوع مطلع شده است.)

سم آلتمن در طول سالها و در شهادت حقوقی اخیر خود، پیوسته علناً اظهار داشته است که از Y Combinator اخراج نشده و به ما گفته است که در برابر این جدایی مقاومت نکرده است. پاول گراهام در توییتی نوشت: «ما نمیخواستیم او برود، بلکه میخواستیم بین YC و OpenAI یکی را انتخاب کند.» گراهام در بیانیهای به ما گفت: «ما قدرت قانونی برای اخراج کسی را نداریم؛ تنها کاری که میتوانیم انجام دهیم اعمال فشار اخلاقی است.»

با این حال، در محافل خصوصی، داستان صریحتر بود - جدایی آلتمن ناشی از عدم اعتماد شرکای YC بود. این روایت از دوران حضور آلتمن در Y Combinator بر اساس مصاحبه با چندین بنیانگذار و شریک YC و مطالب همزمان است که همگی نشان میدهند جدایی کاملاً دو طرفه نبوده است. گراهام حتی بنا به گزارشها در یک بحث داخلی به همکاران YC گفته بود که «سم قبل از اخراج شدنش، تمام مدت به ما دروغ میگفت.»

تغییر ماموریت OpenAI: از اولویت ایمنی تا اولویت سود

در ماه مه ۲۰۱۵، آلتمن به ایلان ماسک، که در آن زمان تقریباً صدمین فرد ثروتمند جهان بود، ایمیلی فرستاد. مانند بسیاری از کارآفرینان سیلیکون ولی، ماسک در آن زمان به شدت بر مجموعهای از چیزهایی که او «خطرات وجودی» میدانست، متمرکز بود - اگرچه اکثر دیگران آنها را به عنوان احتمالات دور از دسترس میدیدند. او در توییتر نوشت: «ما باید در مورد هوش مصنوعی بسیار محتاط باشیم، هوش مصنوعی بالقوه خطرناکتر از سلاحهای هستهای است.»

آلتمن که مدتها به فناوری خوشبین بود، به سرعت لحن خود در مورد هوش مصنوعی را به سمت یک رویکرد آخرالزمانیتر تغییر داد. او در اظهارات عمومی و ارتباطات خصوصی با ماسک و دیگران، نسبت به انحصار این فناوری توسط غولهای فناوری سودمحور هشدار داد. او نوشت: «من در این فکر بودهام که آیا راهی برای متوقف کردن مسابقه تسلیحاتی هوش مصنوعی وجود دارد یا خیر، اما اگر هیچ راهی وجود ندارد، به نظر میرسد بهتر است شرکت مناسبی این کار را انجام دهد.» او با الهام از قیاس هستهای، پیشنهاد ایجاد یک «هوش مصنوعی» را داد. پروژه منهتن.» او همچنین اصول اصلی این سازمان را تشریح کرد - «ایمنی باید در اولویت اصلی باشد»؛ «قطعاً ما باید از همه مقررات پیروی کنیم و از آنها حمایت کنیم.»

متعاقباً، او و ماسک بر سر نام پروژه به توافق رسیدند: اوپنایآی

برخلاف پروژه منهتن که در ابتدا تحت رهبری دولت بود و به ساخت بمب اتم منجر شد، OpenAI در مراحل اولیه خود با بودجه خصوصی تأمین مالی میشود. آلتمن پیشبینی کرد که زمانی که نوعی «ابرهوش» که از هوش مصنوعی عمومی (AGI) پیشی میگیرد، ظهور کند، ارزش اقتصادی کافی برای «تسخیر مخروط نوری آینده جهان» ایجاد خواهد کرد. با این حال، او بارها بر خطرات وجودی بالقوه آن تأکید کرد: در برههای از زمان، تأثیر این فناوری بر امنیت ملی میتواند چنان قابل توجه باشد که ممکن است دولت ایالات متحده را مجبور به تصاحب OpenAI، حتی ملی کردن آن و جابجایی تأسیسات آن به یک پایگاه امن در بیابان کند. تا پایان سال ۲۰۱۵، ماسک متقاعد شده بود. او نوشت: «ما باید تعهد تأمین مالی یک میلیارد دلاری را اعلام کنیم، و اگر دیگران این کار را نکنند، من از آن حمایت خواهم کرد.»

سم آلتمن در ابتدا OpenAI را زیر نظر بخش غیرانتفاعی Y Combinator قرار داد و آن را به عنوان یک پروژه بشردوستانه داخلی معرفی کرد. او سهام YC را به اعضایی که به OpenAI میپیوندند اختصاص داد و وجوه اهدایی را از طریق حسابهای YC منتقل کرد. در یک مقطع، این آزمایشگاه حتی به حمایت صندوق YC که آلتمن در آن سهام شخصی داشت، متکی بود. (آلتمن بعداً این سهم را «ناچیز» خواند و اظهار داشت که سهام YC اختصاص داده شده به کارمندان از داراییهای شخصی او بوده است.)

قیاس با «پروژه منهتن» در مسابقه استعدادیابی نیز آشکار شد. مشابه تحقیقات شکافت هستهای، یادگیری ماشین در آن زمان یک حوزه علمی در مقیاس کوچک با پتانسیل تأثیرگذاری دورانساز بود که توسط گروه کوچکی از افراد با استعداد مشخص هدایت میشد. ایلان ماسک، آلتمن و گرگ بروکمن که از استرایپ به این شرکت پیوسته بود، همگی معتقد بودند که دانشمندان کامپیوتر واقعاً موفق، انگشتشمار و دور از دسترس هستند. از سوی دیگر، گوگل از نظر بودجه و زمان از مزیت بزرگی برخوردار بود. ماسک بعداً در ایمیلی نوشت: «ما از نظر نیروی انسانی و منابع بسیار عقب هستیم، این شکاف واقعاً وهمآلود است.» اما او همچنین معتقد بود که «اگر بتوانیم به جذب بهترین استعدادها ادامه دهیم و مسیر درست را تضمین کنیم، OpenAI همچنان پیروز خواهد شد.»

یکی از مهمترین اهداف استخدام، ایلیا ساتسکور بود - محققی درونگرا و پرشور که اغلب به عنوان یکی از بااستعدادترین دانشمندان هوش مصنوعی زمان خود شناخته میشد. سوتسکِوِر که در سال ۱۹۸۶ در اتحاد جماهیر شوروی متولد شده بود، خط رویش موهایش عقب رفته بود، چشمانی گود داشت و عادت داشت قبل از صحبت کردن مکث کند و با تأمل به جایی خیره شود. یکی دیگر از چهرههای کلیدی، داریو آمودی بود، محققی پرانرژی با پیشینهای در بیوفیزیک که اغلب در لحظات تنش، با حالتی عصبی دستش را در موهای سیاهش میکشید و حتی به ایمیلهای تکجملهای هم با انشاهای چندپاراگرافی پاسخ میداد. هر دو در آن زمان در شرکتهای دیگر در موقعیتهای شغلی پردرآمد بودند، اما آلتمن تلاش زیادی کرد تا آنها را به تیم خود بیاورد. او بعداً به شوخی گفت: «من عملاً داشتم ایلیا را «تعقیب» میکردم.»

در حالی که ماسک ممکن است نام شناختهشدهتری داشته باشد، آلتمن اپراتوری روانتر است. او ابتکار عمل را به دست گرفت و به آمودی ایمیل زد و قرار ملاقاتی دو نفره در یک رستوران هندی ترتیب داد. (آلتمن: «اوبر من تصادف کرد!» شاید ده دقیقه دیرتر بیاد.» آمودی: «اوه نه، امیدوارم حالت خوب باشه.») آمودی مانند بسیاری از محققان هوش مصنوعی معتقد است که این فناوری تنها زمانی باید توسعه یابد که نشان داده شود با ارزشهای انسانی «همسو» است - به این معنی که به طور فاجعهباری از نیت انسانی منحرف نمیشود، مانند نابودی بشریت به نام «پاکسازی محیط زیست». آلتمن بارها و بارها در مکالمهشان این نگرانی ایمنی را تکرار کرد و اعتماد به نفس را القا کرد.

آمودی، که بعدها به این شرکت پیوست، سالها صرف مستندسازی اقدامات آلتمن و بروکمن کرد و آنها را در سندی با عنوان «تجربه من در OpenAI» گردآوری کرد (زیرنویس: «محرمانه: توزیع نکنید"). بیش از دویست صفحه از فایلهای مربوط به آمودی - از جمله این یادداشتها، ایمیلهای داخلی و یادداشتها - در محافل سیلیکون ولی دست به دست میشد اما هرگز به طور عمومی افشا نشده بود. در این سوابق، آمودی نوشت که هدف آلتمن ایجاد «یک آزمایشگاه هوش مصنوعی با محوریت ایمنی (شاید نه در ابتدا، اما خیلی زود پس از آن)» بود.

در دسامبر ۲۰۱۵، تنها چند ساعت قبل از اعلام رسمی OpenAI، آلتمن ایمیلی به ماسک فرستاد و شایعهای را مطرح کرد: گوگل «قرار بود فردا با یک پیشنهاد معکوس بزرگ به همه افراد حاضر در OpenAI بیاید و سعی کند این سازمان را کاملاً نابود کند.» ماسک پرسید: «آیا ایلیا پاسخ قطعی داده است؟» آلتمن در پاسخ گفت که ساتسکور مصمم است. در واقع، گوگل به ساتسکور حقوق سالانه ۶ میلیون دلار پیشنهاد داده بود که OpenAI نمیتوانست آن را تامین کند. با این حال آلتمن همچنان با اعتماد به نفس اظهار داشت: «حیف که آنها طرفدار «کار درست را انجام بده» نیستند.»

ایلان ماسک زمانی در یک کارخانه چمدانسازی قدیمی در منطقه میشن سانفرانسیسکو، فضای اداری را برای OpenAI فراهم کرد. همانطور که ایلیا ساتسکور به ما گفت، شعار اصلی کارگران در آن زمان این بود: «شما همه دنیا را نجات خواهید داد.» اگر همه چیز خوب پیش برود، بنیانگذاران OpenAI معتقد بودند که هوش مصنوعی به یک آرمانشهر «پساکمیابی» منجر خواهد شد: خودکارسازی کارهای طاقتفرسا، درمان سرطان، اعطای اوقات فراغت و فراوانی بیشتر به انسانها. اما اگر این فناوری به طور نادرستی مورد استفاده قرار گیرد یا به دست افراد نادرست بیفتد، تخریب میتواند کامل باشد - مثلاً برای توسعه سلاحهای زیستی جدید یا دستههای پیشرفته پهپادها استفاده شود؛ مدلها ممکن است از نظارت انسانی فراتر روند، روی سرورهای مخفی خود تکثیر شوند و از کار بیفتند؛ در موارد شدید، آنها حتی میتوانند کنترل شبکه برق، بازار سهام یا زرادخانه هستهای را به دست بگیرند.

اگرچه همه با این ارزیابیها موافق نیستند، اما سم آلتمن بارها اعتقاد خود را به این ریسک ابراز کرده است. او در یک پست وبلاگ در سال ۲۰۱۵ نوشت که هوش ماشینی در سطح ابرانسانی «برای نابودی بشریت نیازی به شرور بودن ندارد، بلکه میتواند بیتفاوت باشد، زیرا به دنبال دستیابی به اهداف دیگری است... و به طور اتفاقی ما را از صحنه روزگار محو میکند.» بنیانگذار OpenAI متعهد شد که سرعت را بر ایمنی ترجیح ندهد و اساسنامه این شرکت شامل تعهد قانونی برای «سودرسانی به تمام بشریت» است. آنها همچنین نگرانند که اگر هوش مصنوعی به قدرتمندترین فناوری تاریخ تبدیل شود، هر کنترلکنندهی واحدی قدرت بیسابقهای به دست خواهد آورد - سناریویی که آنها از آن به عنوان «دیکتاتوری هوش مصنوعی» یاد میکنند.

پس از جدایی ماسک، محققانی مانند داریو آمودی شروع به ابراز نارضایتی از سبک مدیریتی گرگ بروکمن کردند و برخی او را اقتدارگرا دانستند، در حالی که ساتسکور «اصولگرا اما فاقد توانایی سازمانی» توصیف شد. در طول انتقال به سمت مدیرعاملی، به نظر میرسید آلتمن تعهدات متفاوتی به جناحهای مختلف درون شرکت داده است. او به برخی از محققان اطمینان داد که اقتدار بروکمن را تضعیف خواهد کرد، اما در عین حال، با بروکمن و ساتسکور به یک «توافق دست جمعی» رسید: او به عنوان مدیرعامل فعالیت میکرد، اما در صورت درخواست هر دو، استعفا میداد. (آلتمن این ادعا را رد میکند و میگوید که از او برای مدیرعاملی دعوت شده بود. این سه نفر وجود این توافق را تأیید میکنند، و بروکمن میگوید که این توافق غیررسمی بوده است: «او یکجانبه گفت که اگر ما دو نفر درخواست کنیم، استعفا خواهد داد.» ما در واقع با این ایده مخالف بودیم، اما او گفت که این کار برایش مهم است و از روی نوعدوستی انجام شده است.") بعداً، هیئت مدیره فهمید که مدیرعامل در واقع یک "هیئت مدیره سایه" برای خودش تشکیل داده است، که این موضوع شوکه کننده بود.

سوابق داخلی نشان میدهد که تیم بنیانگذار از اوایل سال ۲۰۱۷ در مورد ساختار غیرانتفاعی تردید داشتند. در همان سال، پس از آنکه ماسک تلاش کرد شرکت را تصاحب کند، بروکمن در دفتر خاطرات خود نوشت: «نمیتوان گفت که ما واقعاً به غیرانتفاعی بودن پایبند ماندیم... اگر ما ظرف سه ماه به یک شرکت درجه دو تبدیل شویم، اظهارات قبلی دروغ بودهاند.» آمودی همچنین در یادداشتهای اولیه خود مستند کرده است که از بروکمن در مورد اولویتهای اصلیاش پرسیده است، که او در پاسخ گفته است «پول و قدرت». (بروکمن این ادعا را رد میکند.) دفتر خاطرات او همچنین طرز فکر متناقضی را نشان میدهد: از یک طرف میگوید «اگر دیگران ثروتمند نیستند، من هم اهمیتی به ثروتمند بودن نمیدهم» و از طرف دیگر از خود میپرسد «واقعاً چه میخواهم؟» و یکی از پاسخها این است که «از نظر مالی به یک میلیارد دلار برسم».

در سال ۲۰۱۷، ساتسکور در دفترش مقالهای تحقیقاتی از محققان گوگل خواند که در آن «معماری شبکه ساده و جدیدی - ترنسفورمر -» پیشنهاد شده بود. از روی صندلیاش پرید، به راهرو دوید و فریاد زد: «هر کاری دارید میکنید، این جواب است.» از نظر او، این معماری OpenAI را قادر میسازد تا مدلهای پیچیدهتری را آموزش دهد. این پیشرفت منجر به اولین مدلهای ترانسفورماتور از پیش آموزشدیده مولد شد و بعدها به عنوان پایه و اساس ChatGPT عمل کرد.

آلتمن پیش از این به کارمندان اولیه متعهد شده بود که OpenAI همیشه ماهیت غیرانتفاعی خود را حفظ خواهد کرد و همین امر باعث شد بسیاری از برنامهنویسان برای پیوستن به این شرکت، کاهش قابل توجه حقوق خود را بپذیرند. OpenAI همچنین حدود 30 میلیون دلار کمک مالی دریافت کرده است، از جمله از سازمان Open Philanthropy، یک مرکز تأمین مالی کلیدی در جنبش نوعدوستی مؤثر، که مدتهاست از پروژههایی مانند توزیع پشهبند در مناطق فقیرنشین حمایت میکند.

عملیات روزانه عمدتاً توسط بروکمن و ساتسکور نظارت میشد، در حالی که ماسک و آلتمن مشغول سایر فعالیتهای مربوط به خود بودند و معمولاً هفتهای یک بار از شرکت بازدید میکردند. تا سپتامبر ۲۰۱۷، صبر ماسک داشت تمام میشد. همزمان با بالا گرفتن بحثها در مورد تبدیل احتمالی OpenAI به یک شرکت انتفاعی، او درخواست کنترل اکثریت را کرد.

پاسخهای آلتمن در مواقع مختلف متفاوت بود، اما یک چیز که او دائماً بر آن اصرار داشت این بود که اگر قرار باشد شرکت تحت نظر یک مدیرعامل بازسازی شود، آن سمت باید توسط او حفظ شود. ساتسکور به طور قابل توجهی از این موضوع نگران بود. او از طرف خودش و بروکمن، ایمیلی طولانی با عنوان «افکار صادقانه» برای ماسک و آلتمن فرستاد و در آن نوشت: «هدف OpenAI بهتر کردن آینده و جلوگیری از دیکتاتوری هوش مصنوعی عمومی است.» او خطاب به ماسک نوشت: «بنابراین، ایجاد ساختاری که میتواند شما را به یک دیکتاتور تبدیل کند، ایده بدی است.» او همچنین نگرانیهای مشابهی را با آلتمن در میان گذاشت و اظهار داشت: «ما نمیفهمیم که چرا عنوان مدیرعاملی برای شما اینقدر حیاتی است.» دلایل شما مدام تغییر میکند و این باعث میشود که تشخیص انگیزه واقعی برای ما دشوار باشد.

ماسک پاسخ داد: «آقایان، کار من تمام است. یا خودتان کار دیگری انجام دهید یا به حفظ وضعیت غیرانتفاعی OpenAI ادامه دهید—در غیر این صورت، من فقط به صورت رایگان به شما بودجه میدهم تا یک شرکت نوپا را اداره کنید.» پنج ماه بعد، او با نارضایتی آشکار آنجا را ترک کرد. (در سال ۲۰۲۳، او شرکت رقیب انتفاعی xAI را تأسیس کرد. سال بعد، او از آلتمن و OpenAI به دلیل کلاهبرداری و نقض امانت خیریه شکایت کرد و ادعا کرد که او «با دقت دستکاری» شده و آلتمن با استفاده از نگرانیهایش در مورد ریسک هوش مصنوعی برای تأمین بودجه، درگیر یک «کلاهبرداری طولانی» شده است. این دعوی حقوقی همچنان ادامه دارد و OpenAI قویاً این ادعاها را رد میکند.)

با پیشرفت قابلیتهای تکنولوژیکی، متوجه شدیم که حدود دوازده مهندس اصلی در OpenAI یک سری جلسات مخفی برگزار کردهاند و بهطور خصوصی در مورد اینکه آیا میتوان به تیم بنیانگذار، از جمله سم آلتمن و گرگ بروکمن، اعتماد کرد یا خیر، بحث کردهاند. در یکی از این جلسات، یکی از کارمندان طرحی طنز از گروه کمدی بریتانیایی میچل و وب را به یاد آورد - یک سرباز نازی جبهه شرقی ناگهان دچار الهامی ناگهانی میشود و میپرسد: «آیا ما آدمهای بدی هستیم؟»

تا سال ۲۰۱۸، داریو آمودی شروع به زیر سوال بردن انگیزههای بنیانگذاران به صورت علنی کرد. او بعداً در یادداشتی نوشت: «همه چیز شبیه یک طرح تأمین مالی بیپایان است. من احساس میکنم چیزی که OpenAI واقعاً به آن نیاز دارد، یک تعریف واضح است: اینکه چه کاری میخواهد انجام دهد، چه کاری نمیخواهد انجام دهد و اینکه وجودش چگونه دنیا را بهتر خواهد کرد. با وجود اینکه این شرکت از قبل بیانیه ماموریتی دارد - «اطمینان حاصل کردن از اینکه هوش مصنوعی عمومی به نفع تمام بشریت است» - آمودی احساس کرد که این بیانیه برای تیم اجرایی واضح نیست.

در اوایل سال ۲۰۱۸، او شروع به تهیه پیشنویس اساسنامه شرکت کرد و پس از هفتهها بحث با آلتمن و بروکمن، یکی از رادیکالترین بندها را در آن گنجاند: اگر یک «پروژه ارزشمحور و ایمن» به دستیابی به هوش مصنوعی عمومی نزدیکتر از OpenAI باشد، شرکت «رقابت را متوقف کرده و در عوض به آن پروژه کمک خواهد کرد». این به عنوان بند «ادغام و کمک» شناخته میشد - برای مثال، اگر گوگل ابتدا به هوش مصنوعی عمومی ایمن دست یابد، OpenAI از نظر تئوری خود را منحل کرده و منابع را به گوگل منتقل میکند. از دیدگاه یک کسبوکار سنتی، این تعهد تقریباً غیرقابل تصور بود، اما OpenAI هرگز قصد نداشت به یک شرکت سنتی تبدیل شود.

این فرضیه در بهار ۲۰۱۹ با واقعیت سنجی مواجه شد. در آن زمان، OpenAI در حال مذاکره با مایکروسافت برای سرمایهگذاری بالقوه تا سقف ۱ میلیارد دلار بود. اگرچه آمودی (که در آن زمان رهبری تیم ایمنی را بر عهده داشت) در ارائه این پروژه به بیل گیتس نقش داشت، اما همچنان در تیم این نگرانی وجود داشت که مایکروسافت ممکن است شرایطی را معرفی کند که تعهدات اخلاقی OpenAI را تضعیف کند. آمودی فهرستی از الزامات ایمنی را که اولویتبندی شده بودند، به آلتمن ارائه داد که بند «ادغام و کمک» در صدر آن قرار داشت.

آلتمن در آن زمان موافقت کرد. با این حال، همزمان با نزدیک شدن به نهایی شدن معامله در ماه ژوئن، آمودی بند جدیدی را در این توافقنامه کشف کرد که به مایکروسافت قدرت وتوی ادغام OpenAI را میداد. او بعداً به یاد آورد: «این به معنای نقض ۸۰ درصدی منشور بود.» او در این مورد با آلتمن روبرو شد، و آلتمن در ابتدا وجود چنین بندی را انکار کرد. آمودی قرارداد را کلمه به کلمه درجا خواند و در نهایت مجبور شد از همکار دیگری بخواهد که مستقیماً با آلتمن آن را تأیید کند. (آلتمن اظهار داشت که این حادثه را به خاطر نمیآورد.)

خروج ایمنی و تولد آنتروپیک

یادداشتهای آمودی همچنین مجموعهای از درگیریهای پرتنش و رو به افزایش را مستند کرده است. چند ماه بعد، در جلسهای، آلتمن او و خواهرش دانیلا را که او نیز در بخش ایمنی و سیاستگذاری شرکت کار میکرد، احضار کرد و ادعا کرد که از یک «مدیر ارشد» اطلاعات موثقی دریافت کرده است مبنی بر اینکه این دو نفر در حال برنامهریزی برای یک «کودتا» هستند. در یادداشتها آمده بود که دانیلا درجا «از نظر احساسی تحت فشار» قرار گرفته و مدیر اجرایی را صدا زده است، که بعداً هرگونه صحبتی در این مورد را انکار کرده است. منابع آگاه به یاد آوردند که آلتمن بعداً هرگونه اتهامی را تکذیب کرد: «من هرگز چنین چیزی نگفتم.» دانیلا پاسخ داد: «تو همین الان این کار را کردی.» (آلتمن اظهار داشت که خاطرهاش کمی متفاوت بوده و ادعا کرد که او فقط آمودی را به انجام «رفتار سیاسی» متهم کرده است.) در سال ۲۰۲۰، آمودی، دانیلا و چند نفر از همکاران، شرکت را ترک کردند تا شرکت آنتروپیک را تأسیس کنند که از آن زمان به یکی از رقبای اصلی OpenAI تبدیل شده است.

در همین حال، آلتمن همچنان بر تعهد OpenAI به ایمنی، به ویژه در حضور نیروهای بالقوه، تأکید کرد. در پایان سال ۲۰۲۲، چهار دانشمند کامپیوتر مقالهای منتشر کردند که در آن خطر «همترازی فریبنده» را مطرح میکردند: مدلهای بسیار پیشرفته ممکن است در طول آزمایش عملکرد خوبی داشته باشند، اما پس از استقرار واقعی، اهداف خود را دنبال کنند. (این سناریوی به ظاهر علمی-تخیلی، پیش از این تحت شرایط آزمایشگاهی خاصی رخ داده است.) چند هفته پس از انتشار مقاله، یکی از نویسندگان - دانشجوی دکترا در دانشگاه کالیفرنیا، برکلی - ایمیلی از آلتمن دریافت کرد. آلتمن نگرانیهای فزایندهای را در مورد تهدید «هوش مصنوعی ناهمسو» ابراز کرد و در نظر داشت ۱ میلیارد دلار برای رسیدگی به این موضوع، مانند تأسیس یک جایزه تحقیقاتی جهانی، سرمایهگذاری کند. با وجود اینکه این دانشجو شایعاتی مبنی بر اینکه «سم کمی باهوش است» شنیده بود، این تعهد در نهایت او را متقاعد کرد که تحصیلات خود را متوقف کند و به OpenAI بپیوندد.

با این حال، با جلسات متعدد در بهار ۲۰۲۳، به نظر میرسید که نگرش آلتمن تغییر کرده است. او دیگر به تعیین جایزه اشارهای نکرد، بلکه به جای آن به ایجاد یک «تیم هماهنگی برتر» داخلی در شرکت روی آورد. در یک اطلاعیه رسمی آمده است که این تیم «20٪ از محاسبات امن شرکت» را دریافت خواهد کرد، منبعی که ارزش بالقوه آن بیش از 1 میلیارد دلار است. در این اطلاعیه همچنین تأکید شده است که اگر مشکل همترازی حل نشود، هوش مصنوعی عمومی ممکن است منجر به «تضعیف یا حتی انقراض بشریت» شود. یان لیک، که مسئول این تیم بود، بعداً اظهار داشت: «این واقعاً یک استراتژی بسیار مؤثر برای حفظ نیروها بود.»

با این حال، وعده «20٪ محاسبات» محقق نشد. چهار نفر از افرادی که با این تیم همکاری داشتند یا از نزدیک آنها را دنبال میکردند، اظهار داشتند که منابع تخصیصیافته واقعی تنها ۱ تا ۲ درصد از کل محاسبات شرکت را تشکیل میداد. علاوه بر این، یک محقق اشاره کرد که «بیشتر محاسبات به اصطلاح سوپرترازبندی در واقع روی قدیمیترین و بدترین خوشه اجرا میشوند.» اعضای تیم عموماً معتقد بودند که سختافزار پیشرفتهتر برای پروژههای درآمدزا در اولویت قرار دارد. (OpenAI این موضوع را تکذیب کرد.) لیک این موضوع را با میرا موراتی، مدیر ارشد فناوری وقت، مطرح کرده بود، اما پاسخ این بود که نیازی به فشار بیشتر نیست - این تعهد از همان ابتدا «غیرواقعبینانه» بود.

تقریباً در همین زمان، یکی از کارمندان سابق به ما گفت که ایلیا سوتسکِوِر «شروع به تأکید شدید بر ایمنی کرد». در روزهای اولیهی OpenAI، در حالی که او فکر میکرد خطر فاجعهبار یک نگرانی منطقی است، هنوز تا حدودی دور از دسترس بود؛ با این حال، همانطور که او به تدریج به این باور رسید که هوش مصنوعی عمومی در حال نزدیک شدن است، این نگرانی به سرعت افزایش یافت. طبق خاطرات این کارمند، در جریان یک جلسه عمومی، «ایلیا بلند شد و گفت که در چند سال آینده به نقطهای خواهیم رسید که تقریباً همه افراد شرکت باید به سمت انجام امور ایمنی روی بیاورند، در غیر این صورت کار ما تمام است.» با این حال، سال بعد، این «تیم هماهنگی برتر» قبل از اتمام مأموریتش منحل شد.

در حال حاضر، ارتباطات داخلی نشان میدهد که مدیران و اعضای هیئت مدیره کمکم به این باور رسیدهاند که پنهانکاری و رفتار گمراهکنندهی سم آلتمن ممکن است تأثیر قابل توجهی بر ایمنی محصولات OpenAI داشته باشد. آلتمن طی جلسهای در دسامبر ۲۰۲۲ به هیئت مدیره اطمینان داد که ویژگیهای متعدد GPT-4 که قرار است به زودی عرضه شود، توسط کمیته ایمنی تأیید شده است. هلن تونر، عضو هیئت مدیره و متخصص سیاستهای هوش مصنوعی، درخواست مشاهده اسناد مربوطه را داشت، اما متوجه شد که دو ویژگی بحثبرانگیز - یکی که به کاربران اجازه میدهد مدل را «تنظیم دقیق» کنند و دیگری که امکان استقرار آن به عنوان دستیار شخصی را فراهم میکند - در واقع تأیید نشدهاند. پس از جلسه، یکی دیگر از اعضای هیئت مدیره، کارآفرین تاشا مککالی، توسط یکی از کارمندان که از او میپرسید آیا از «حادثه عدم رعایت قوانین در هند» اطلاع دارد، به کناری کشیده شد: آلتمن هرگز در بهروزرسانیهای متعدد هیئت مدیره اشاره نکرده بود که مایکروسافت نسخه اولیه ChatGPT را در هند بدون تکمیل بررسیهای ایمنی لازم راهاندازی کرده است. جیکوب هیلتون، محقق OpenAI، در آن زمان گفت: «این موضوع تقریباً بهطور کامل نادیده گرفته شد».

اگرچه این مشکلات مستقیماً منجر به حادثه ایمنی نشدند، اما محقق کارول وینرایت معتقد بود که این موارد نشاندهنده «روند رو به رشد به سمت رویکردی مبتنی بر اولویت محصول و امنیت پایین» هستند. پس از انتشار GPT-4، یان لایکه، که مسئول کارهای امنیتی بود، به هیئت مدیره نوشت: «OpenAI از ماموریت خود منحرف شده است.» ما ابتدا محصول و درآمد را در اولویت قرار میدهیم، سپس قابلیت، تحقیق و مقیاسپذیری، و هماهنگی و ایمنی در رتبه سوم قرار میگیرند. او همچنین اشاره کرد که «شرکتهایی مانند گوگل در حال یادگیری درسهایی هستند - تسریع استقرار در حالی که نگرانیهای امنیتی را نادیده میگیرند.»

مککالی در ایمیلی به اعضای هیئت مدیره نوشت: «من معتقدم که ما واقعاً در مرحلهای هستیم که نظارت بیشتر ضروری است.» با این حال، وقتی هیئت مدیره تلاش کرد تا به این موضوع رسیدگی کند، آشکارا در موقعیت نامساعدی قرار گرفت. سو یون، عضو سابق هیئت مدیره، گفت: «به طور خلاصه، این گروهی از افراد هستند که فاقد تجربه دنیای واقعی هستند.» در سال ۲۰۲۳، این شرکت در حال آمادهسازی برای عرضه GPT-4 Turbo بود. طبق توضیحات ساتسکور در یادداشتی، آلتمن به میرا موراتی گفته بود که این مدل نیازی به تأیید امنیتی ندارد و این تصمیم را به جیسون کوون، مشاور عمومی شرکت، نسبت داده بود. اما وقتی موراتی در برنامه اسلک از کوان پرسید، او پاسخ داد: «امم... من کاملاً مطمئن نیستم که چرا سم چنین فکری میکند.» (OpenAI اظهار داشت که این حادثه «اهمیت چندانی نداشته است.»)

کمی بعد، هیئت مدیره تصمیم به اخراج آلتمن گرفت - متعاقباً، جهان شاهد بود که او چگونه به سرعت از این تصمیم صرف نظر کرد. اساسنامه OpenAI هنوز در وبسایت رسمی موجود است، اما کسانی که با اسناد مدیریتی این شرکت آشنا هستند میگویند که محتوای آن تقریباً بیمعنی شده است. در ژوئن سال گذشته، آلتمن در یک پست وبلاگ شخصی درباره هوش مصنوعی نوشت: «ما از افق رویداد عبور کردهایم؛ جهش آغاز شده است.»

طبق اساسنامه اولیه، قرار بود این نقطه عطفی برای شرکت باشد تا رقابت را کنار بگذارد و به همکاری روی آورد. با این حال، در مقالهای با عنوان «یکتایی ملایم»، او لحن کاملاً جدیدی اتخاذ کرد و «ترس وجودی» را با «تخیل خوشبینانه» جایگزین کرد: «همه ما چیزهای بهتری خواهیم داشت، و چیزهای به طور فزایندهای بهتری برای یکدیگر خلق خواهیم کرد.» او اذعان کرد که مشکلات مربوط به ترازبندی همچنان حل نشده باقی مانده است، اما آنها را به عنوان یک «مزاحم» تعریف کرد، شبیه به اعتیاد به الگوریتم توصیه اینستاگرام.

آلتمن اغلب با حیرت یا تردید به عنوان «قدرتمندترین قصهگوی نسل خود» شناخته میشود. زمانی تصور میشد استیو جابزی که او تحسینش میکرد، دارای «میدان تحریف واقعیت» است که جهان را با اعتماد به نفس مطلق مطابق با دیدگاه خود شکل میدهد. اما حتی جابز هم هرگز به کاربران نگفت: اگر محصول او را نخرند، ممکن است بشریت نابود شود. در سال ۲۰۰۸، در حالی که آلتمن تنها ۲۳ سال داشت، مربیاش، پاول گراهام، او را اینگونه توصیف کرد: «او را در یک جزیره آدمخوارها بیندازید، پنج سال دیگر برگردید، او پادشاه خواهد شد.» این ارزیابی نه بر اساس دستاوردهای او در آن زمان، بلکه بر اساس ارادهی تقریباً نامحدود او بود.

با این حال، برای برخی از کسانی که از نزدیک با او کار کردهاند، این ویژگی جنبهی دیگری هم دارد. همچنان که ساتسکور به طور فزایندهای نگران ایمنی هوش مصنوعی میشد، مجموعهای از یادداشتها را در مورد آلتمن و گرگ بروکمن گردآوری کرد - مجموعهای از اسناد که در سیلیکون ولی چنان مهم بودند که حتی به عنوان «یادداشتهای ایلیا» از آنها یاد میشود.

در همین حال، داریو آمودی به مستندسازی ادامه داد. این مطالب به اصطلاح «شواهد قطعی» ارائه نمیدادند، بلکه مجموعهای از الگوهای رفتاری ظاهراً پراکنده اما در عین حال انباشته را به تصویر میکشیدند: مانند ارائه موقعیت یکسان به افراد مختلف، ارائه روایتهای متناقض از اطلاعات عمومی و ابهام در مورد فرآیندهای امنیتی. نتیجهگیری ساتسکور این بود که این رفتار «محیطی مساعد برای هوش مصنوعی عمومی ایمن ایجاد نمیکند»؛ آمودی صریحتر نوشت: «مشکل OpenAI خود سم است.»

ما با بیش از صد نفر که با رویکرد آلتمن آشنا بودند مصاحبه کردیم: کارمندان و مدیران فعلی و سابق OpenAI، همکاران و رقبای او، دوستان و دشمنانش - در سیلیکون ولی، بسیاری اغلب چندین مسئولیت را بر عهده دارند. برخی از تیزهوشی تجاری او دفاع میکردند و معتقد بودند که ساتسکور و آمودی فقط رقبای شکستخوردهای هستند؛ برخی دیگر او را دانشمندی سادهلوح و حواسپرت یا حتی افراطی گرفتار در «روز قیامت» میدانستند. یون معتقد بود که آلتمن یک «شرور ماکیاولیستی» نیست، بلکه فردی است که به روایت خودش متقاعد شده است. «او چنان در خودباوریاش غرق شده که تصمیماتی میگیرد که در دنیای واقعی غیرقابل درک هستند - اما او اصلاً در دنیای واقعی زندگی نمیکند.»

با این حال، قضاوت اکثر مصاحبهشوندگان مشابه سوتسکور و آمودی است: آلتمن ارادهی فوقالعادهای دارد، ارادهای که حتی در میان غولهای صنعتی که نامشان روی موشکها حک شده، متمایز است. یکی از اعضای هیئت مدیره گفت: «او به «واقعیت» پایبند نیست. او دو ویژگی دارد که به ندرت با هم ظاهر میشوند: یکی میل شدید به دوست داشته شدن، راضی کردن طرف مقابل در هر تعاملی؛ دیگری تقریباً ضداجتماعی است و اهمیتی به عواقب فریب دادن دیگران نمیدهد.»

بیش از یک مصاحبهشونده خودجوش از اصطلاح «شخصیت ضداجتماعی» استفاده کرد. آلتمن، یکی از اعضای اولین گروه Y Combinator، همکار برنامهنویس آرون سوارتز بود که بعداً در سال ۲۰۱۳ خودکشی کرد. سوارتز پیش از مرگش، نگرانیهایش را در مورد آلتمن به یکی از دوستانش ابراز کرد: «باید درک کنی، سم هیچوقت قابل اعتماد نیست.» او یک شخصیت ضداجتماعی است؛ او قادر به انجام هر کاری است. چندین مدیر اجرایی مایکروسافت همچنین اظهار داشتند که با وجود حمایت دیرینه ساتیا نادلا از آلتمن، رابطه بین این دو رو به وخامت است. یکی از مدیران اجرایی گفت: «او توافقات را گمراه، تحریف، دوباره مذاکره یا حتی لغو خواهد کرد.» اوایل امسال، OpenAI مایکروسافت را به عنوان ارائهدهنده انحصاری خدمات ابری برای «مدل بدون تابعیت» خود مجدداً تأیید کرد، اما در همان روز، از همکاری ۵۰۰ میلیارد دلاری با آمازون خبر داد و این شرکت را به فروشنده انحصاری پلتفرم هوش مصنوعی سازمانی خود تبدیل کرد. اگرچه این ترتیبات قرارداد را نقض نمیکرد، مایکروسافت معتقد بود که احتمال تعارض وجود دارد. (شرکت OpenAI اظهار داشت که قرارداد را نقض نخواهد کرد.) این مدیر اجرایی حتی اظهار داشت: «من معتقدم احتمال قابل توجهی وجود دارد که در آینده او را کسی شبیه به برنی مداف یا سم بنکمن-فرید بدانند.»

آلتمن یک نابغه فنی نیست—از نظر بسیاری از همکارانش، تواناییهای حرفهای او در برنامهنویسی یا یادگیری ماشین محدود است و حتی ممکن است مفاهیم اولیه را با هم قاطی کند. او OpenAI را عمدتاً با ادغام بودجه و منابع فنی دیگران ساخت. این غیرمعمول نیست—این نقش یک کارآفرین است. آنچه بیشتر قابل توجه است، توانایی او در متقاعد کردن مهندسان، سرمایهگذاران و عموم مردم با دیدگاههای متضاد است، و اینکه آنها را متقاعد کند که اولویتهای او، اولویتهای آنها نیز هست. وقتی این افراد سعی میکنند او را متوقف کنند، او اغلب میتواند با لفاظی مناسب - حداقل به طور موقت - اوضاع را آرام کند؛ و زمانی که طرف مقابل متوجه مشکل میشود، او معمولاً به هدف خود رسیده است. وینرایت گفت: «او ساختارهایی را برای محدود کردن خودِ آیندهاش روی کاغذ طراحی خواهد کرد، اما وقتی آینده واقعاً از راه برسد و نیاز به محدود کردن آن باشد، این ساختارها را یکی یکی از بین خواهد برد.»

یکی از مدیران اجرایی فناوری که با او کار کرده است، میگوید: «قدرت متقاعدسازی او فوقالعاده قوی است، مثل یک حقه ذهنی جدایها. این کاملاً یک سطح دیگر است.» در تحقیقات مربوط به همترازی هوش مصنوعی، یک مفهوم کلاسیک وجود دارد: ارادهی بشریت در مقابل یک هوش مصنوعی قدرتمند، که در آن دومی تقریباً به ناچار غالب میشود، مانند یک استاد بزرگ شطرنج در مقابل یک کودک. و از نظر آن مدیر اجرایی، تماشای آلتمن در حال عبور از میان مهمانیهای مختلف در طول رویداد «Blip» مانند تماشای «رهایی یک هوش مصنوعی عمومی از قفسش» بود.

در روزهای پس از اخراجش، سم آلتمن تلاش میکرد از هرگونه تحقیق در مورد اتهامات علیه خود جلوگیری کند. او به دو نفر گفته بود که نگران است حتی وجود تحقیقات، او را گناهکار جلوه دهد. (آلتمن این ادعا را تکذیب میکند.) با این حال، پس از آنکه اعضای مستعفی هیئت مدیره اصرار کردند که «تحقیقات مستقل باید انجام شود» به عنوان شرط جدایی او، آلتمن در نهایت با «بررسی» «وقایع اخیر» موافقت کرد. به گفته منابع آگاه از مذاکرات، دو عضو جدید هیئت مدیره اصرار داشتند که خودشان این بررسی را رهبری کنند.

به نظر میرسید لارنس سامرز، با بهرهگیری از ارتباطاتش در سیاست و وال استریت، به این نقد اعتبار بخشیده است. (نوامبر گذشته، سامرز پس از آنکه علناً فاش شد که هنگام پیگیری یک شاگرد جوان، از طریق ایمیل از جفری اپستین مشاوره گرفته است، از هیئت مدیره استعفا داد.) در نهایت، OpenAI شرکت حقوقی برجسته WilmerHale را برای رسیدگی به این بررسی استخدام کرد. این شرکت پیش از این تحقیقات داخلی در مورد شرکتهای انرون و ورلدکام را رهبری کرده بود.

شش نفر از افراد نزدیک به روند تحقیقات اظهار داشتند که به نظر میرسد این بررسی برای محدود کردن شفافیت طراحی شده است. برخی گفتند که بازرسان در ابتدا با برخی از افراد کلیدی درون شرکت تماس نگرفتند. یکی از کارمندان پا را فراتر گذاشت و با سامرز و برت تیلور تماس گرفت تا نگرانیهای خود را ابراز کند. این کارمند در مصاحبه با بازرسان، احساسی را که در آن زمان داشت، به یاد میآورد: «آنها فقط به آن دوره کوتاه که ماجرای هیئت مدیره اتفاق افتاد، علاقهمند بودند، نه به مشکلات دیرینه سام در مورد درستکاری.» برخی نیز به دلیل عدم وجود محافظت از ناشناس ماندن، در به اشتراک گذاشتن نگرانیهای خود در مورد آلتمن مردد بودند. این کارمند گفت: «همه نشانهها حاکی از آن است که آنها به دنبال یک نتیجهگیری از پیش تعیینشده هستند - تبرئه او». (با این حال، برخی از وکلای درگیر در این فرآیند از این بررسی دفاع کردند و آن را «مستقل، کامل، جامع و مبتنی بر حقایق» خواندند. تیلور همچنین اظهار داشت که این بررسی «کامل و مستقل» بوده است.)

نقش تحقیقات داخلی شرکت اغلب در جهت مشروعیت بخشیدن به یک تصمیم است. در شرکتهای خصوصی، نتایج تحقیقات گاهی حتی منجر به گزارش کتبی نمیشود و به عنوان راهی برای کاهش مسئولیت قانونی عمل میکند. با این حال، در مواردی که بحثهای عمومی مطرح میشود، معمولاً انتظار شفافیت بیشتری وجود دارد. در سال ۲۰۱۷، پیش از خروج تراویس کالانیک از اوبر، هیئت مدیره یک شرکت خارجی را استخدام کرده و خلاصهای ۱۳ صفحهای از تحقیقات را برای عموم منتشر کرد. با توجه به وضعیت غیرانتفاعی 501(c)(3) شرکت OpenAI و ماهیت کاملاً عمومی این اخراج، بسیاری از مدیران اجرایی این شرکت در ابتدا انتظار یک گزارش تحقیق مفصل را داشتند. با این حال، تا مارس ۲۰۲۴، OpenAI تنها «مجوز» آلتمن را بدون انتشار هیچ گزارش رسمی اعلام کرد و در حدود ۸۰۰ کلمه در وبسایت خود به «شکست اعتماد» اذعان کرد.

حتی همکاران سابق هم پسلرزهها را حس میکنند. میرا موراتی در سال ۲۰۲۴ شرکت OpenAI را ترک کرد تا استارتاپ هوش مصنوعی خودش را راهاندازی کند. متعاقباً، جاش کوشنر، متحد نزدیک آلتمن، با او تماس گرفت. او با ستایش از رهبری او شروع کرد، اما سپس تهدیدی ضمنی مطرح کرد و «نگرانی» خود را در مورد «آبرو»ی او ابراز کرد و اشاره کرد که برخی از همکاران سابقش اکنون او را «دشمن» میدانند. (کوشنر، از طریق سخنگو، گفت که این بازگویی «زمینه کامل را ارائه نمیدهد»؛ از سوی دیگر، آلتمن ادعا کرد که از این تماس تلفنی بیاطلاع بوده است.)

آلتمن در اوایل دوران تصدی خود به عنوان مدیرعامل، اعلام کرد که OpenAI یک شرکت «سود محدود» ایجاد خواهد کرد که توسط این نهاد غیرانتفاعی اداره میشود. ظاهراً این ساختار پیچیده و تقریباً درهمتنیده شرکت، ابداع خود آلتمن بود. در طول این گذار، مدیری به نام هولدن کارنوفسکی مخالفت خود را ابراز کرد و معتقد بود که این ترتیبات به شدت ارزش سازمان غیرانتفاعی را دست کم میگیرد. کارنوفسکی گفت: «وجداناً نمیتوانم با این موضوع کنار بیایم.» طبق سوابق آن زمان، او رأی مخالف داد. با این حال، پس از آنکه وکیل هیئت مدیره اظهار داشت که مخالفت او «ممکن است به عنوان پرچم قرمزی برای تحقیقات بیشتر در مورد قانونی بودن ساختار جدید عمل کند»، رأی او در نهایت به عنوان رأی ممتنع و ظاهراً بدون رضایت او ثبت شد - که حتی میتواند به عنوان جعل سوابق تجاری محسوب شود. (OpenAI به ما گفت که چندین کارمند، کارنوفسکی را به خاطر دارند که از این کار خودداری کرده و صورتجلسه جلسات را به عنوان مدرک ارائه دادهاند.)

در اکتبر سال گذشته، OpenAI تحت یک «تجدید ساختار سرمایه» قرار گرفت و به یک نهاد انتفاعی تبدیل شد. این شرکت علناً اعلام کرد که سازمان غیرانتفاعی وابسته به آن - که اکنون بنیاد OpenAI نام دارد - به یکی از ثروتمندترین مؤسسات تاریخ تبدیل خواهد شد. با این حال، این بنیاد اکنون تنها ۲۶٪ از سهام شرکت را در اختیار دارد و تمام مدیران آن به جز یکی، در هیئت مدیره انتفاعی نیز عضویت دارند.

در جریان یک جلسه استماع کنگره، از آلتمن پرسیده شد که آیا «پول زیادی به دست آورده است». او پاسخ داد: «من هیچ مالکیتی در OpenAI ندارم... من این کار را انجام میدهم چون عاشقش هستم.» با توجه به سهام غیرمستقیم او از طریق صندوقهای مرتبط با Y Combinator، این پاسخ کاملاً محتاطانه بود. از نظر فنی، این درست است. اما چندین نفر، از جمله آلتمن، به ما گفتهاند که این وضعیت احتمالاً به زودی تغییر خواهد کرد. آلتمن گفت: «سرمایهگذاران خواهند گفت: «من باید بدانم که وقتی اوضاع سخت شد، شما هنوز هم این کار را انجام خواهید داد.» اگرچه افزود که در حال حاضر هیچ «بحث فعالی» در مورد آن وجود ندارد. طبق یک شهادت حقوقی، سهام گرگ بروکمن حدود 20 میلیارد دلار ارزش دارد و از نظر تئوری سهم آلتمن باید بیشتر باشد. با این وجود، آلتمن به ما گفت که ثروت انگیزه اصلی او نیست. یکی از کارمندان سابق او به یاد میآورد که گفته بود: «من به پول اهمیتی نمیدهم. من بیشتر به قدرت اهمیت میدهم.»

در سال ۲۰۲۳، آلتمن و الیور مولهرین یک عروسی کوچک در محل اقامت خود در هاوایی برگزار کردند. (این دو نفر نه سال قبل در خانه پیتر تیل، کنار جکوزی آخر شب، با هم آشنا شده بودند.) آنها در آن ملک از مهمانان زیادی پذیرایی کرده بودند، و صحنههایی که بازدیدکنندگانی که با آنها مصاحبه کردیم توصیف کردند، از چارچوب رایج سبک زندگی فوق ثروتمندان فراتر نمیرفت: شامی که توسط یک سرآشپز خصوصی تهیه میشد، سفرهای قایقی در غروب آفتاب. یک مهمانی سال نو با تم سریال واقعنمای «بازمانده » برگزار شد؛ عکسها گروهی از مردان بدون پیراهن و خندان، از جمله مجری برنامه، جف پروبست، را نشان میدادند. آلتمن همچنین در سایر املاک خود میزبان گردهماییهای کوچکی بود که حداقل در یکی از آنها استریپ پوکر پرشور برگزار میشد. (عکسی که لو رفته بود آلتمن را نشان نمیداد، بنابراین مشخص نیست چه کسی در نهایت برنده شد، اما به نظر میرسید حداقل سه نفر آشکارا بازنده بودهاند.) بسیاری از مهمانان سابق مصاحبهشده فقط به یک چیز اشاره کردند: او واقعاً میزبان سخاوتمندی بود.

افراد دخیل در تحقیقات گفتند که هیچ گزارشی هرگز منتشر نشد زیرا هرگز گزارش کتبی رسمی وجود نداشت. یافتههای به اصطلاح تحقیقات فقط به صورت شفاهی به سامرز و تیلور گزارش شد. یک منبع نزدیک به تحقیقات گفت: «این بررسی به این نتیجه نرسید که 'سم به اندازه جورج واشنگتن که درخت گیلاس را قطع میکرد، صادق است'». اما در مجموع، به نظر میرسید که تحقیقات واقعاً بر «مسئله درستکاری» که عامل اخراج آلتمن بود، تمرکز نکرده است و بخش قابل توجهی از تلاش صرف تعیین این موضوع شده است که آیا تخلفات کیفری آشکاری رخ داده است یا خیر؛ تحت این استاندارد، تحقیقات در نهایت به این نتیجه رسید که او میتواند به عنوان مدیرعامل ادامه دهد. کمی بعد، آلتمن کرسی هیئت مدیره را که پس از اخراج از دست داده بود، دوباره به دست آورد. منابع داخلی فاش کردند که بخشی از دلیل عدم ثبت یافتههای تحقیقات به صورت کتبی، توصیههای مشاوران خصوصی سامرز و تیلور نیز بوده است. (سامرز از اظهار نظر علنی در این مورد خودداری کرد؛ تیلور اظهار داشت که از آنجا که یک جلسه توجیهی شفاهی وجود داشته، «نیازی به گزارش کتبی رسمی نیست.»)

بسیاری از کارمندان فعلی و سابق OpenAI به ما گفتند که از عدم افشای عمومی شوکه شدهاند. آلتمن اظهار داشت که معتقد است تمام اعضای هیئت مدیره که پس از بازگشت او به عضویت پیوستهاند، به صورت شفاهی در مورد این مسائل توجیه شدهاند. یک فرد آگاه به این ماجرا گفت: «این یک دروغ محض است.» برخی از مدیران همچنین به ما گفتند که سوالات مداوم در مورد صحت این «یافتههای تحقیق» حتی ممکن است «انجام مجدد تحقیقات» را در آینده ضروری کند.

بدون سوابق کتبی، کماهمیت جلوه دادن این ادعاها آسانتر است. در همین حال، پیشرفت مداوم آلتمن در سیلیکون ولی، بررسی دقیق این مسائل را از خارج از شرکت بیشتر تضعیف کرد. چندین سرمایهگذار برجسته که با او کار کرده بودند، از یک عادت شناختهشدهی آلتمن برای ما گفتند: اگر یک سرمایهگذار روی یکی از رقبای OpenAI شرطبندی کند، ممکن است بعداً آنها را در «لیست سیاه» قرار دهد. یکی از آنها گفت: «اگر آنها در پروژهای سرمایهگذاری کنند که سم دوست ندارد، انتظار نداشته باشید که بعداً بخشی از هیچ فرصت دیگری باشید.» یکی دیگر از منابع قدرت آلتمن، شبکه گسترده سرمایهگذاری او بود که گاهی حتی به زندگی شخصیاش نیز گسترش مییافت. او با چندین شریک سابق خود روابط مالی داشت: برخی از آنها شامل مدیریت مشترک صندوقها، برخی دیگر شامل سرمایهگذاریهای او و برخی دیگر شامل سرمایهگذاریهای مشترک مکرر بود. این رویه در سیلیکون ولی غیرمعمول نیست. بسیاری از مدیران دگرجنسگرا نیز به این روش عمل میکنند. (یکی از مدیران عامل مشهور به ما گفت: «شما باید این کار را انجام دهید.») آلتمن خودش اظهار داشت: «واضح است که من بعد از جداییمان با برخی از دوستان سابقم سرمایهگذاری کردهام و فکر میکنم این کاملاً اشکالی ندارد.» اما خود این ترتیب، وابستگی بسیار بالایی ایجاد میکند. یکی از نزدیکان آلتمن گفت: «این اساساً یک وابستگی بسیار بسیار قوی ایجاد میکند، بارها، حتی وابستگی مادامالعمر.»

با این وجود، شایعات مختلفی پیرامون زندگی شخصی سم آلتمن توسط رقبا مورد سوءاستفاده و حتی تحریف قرار گرفته است. رقابت شدید تجاری چیز جدیدی نیست، اما رقابت در صنعت هوش مصنوعی به طرز فوقالعادهای بیرحمانه شده است. یکی از مدیران OpenAI این را «شکسپیری» توصیف کرد و افزود: «به نظر میرسد قوانین معمول بازی دیگر اعمال نمیشوند.» برخی از واسطههایی که مستقیماً با ایلان ماسک در ارتباط هستند، و حتی در برخی موارد از او بودجه دریافت میکنند، دهها صفحه از «تحقیقات مخالفان» درباره آلتمن را منتشر کردهاند. این مدارک سطح بالایی از نظارت را نشان میدهند: از جمله شرکتهای صوری مرتبط با او، اطلاعات تماسهای خصوصی و حتی سوابق مصاحبه با یک به اصطلاح کارگر جنسی در یک بار مخصوص همجنسگرایان. یکی از واسطهها همچنین ادعا کرد که برنامههای پرواز آلتمن و مهمانیهایی که در آنها شرکت کرده، ردیابی میشوند. آلتمن به ما گفت: «احساس میکنم هیچکس برای تحقیق بیشتر در مورد من استخدام نشده است.»

در همین حال، اتهامات افراطی مختلفی نیز در حال گسترش است. تاکر کارلسون، شخصیت رسانهای راستگرا، بدون هیچ مدرکی تلویحاً گفته است که آلتمن در مرگ یک افشاگر دست داشته است، ادعایی که رقبا دائماً آن را تقویت کردهاند. خواهر آلتمن، آنی، در یک دادخواست و در مصاحبهای با ما اظهار داشت که آلتمن از سه سالگی او و خودش از دوازده سالگی او را مورد آزار جنسی قرار داده است. (ما نتوانستیم ادعاهای آنی را تأیید کنیم. آلتمن این موضوع را انکار میکند و مادر و برادرش نیز اظهار داشتند که این اتهامات «کاملاً نادرست» هستند و «درد عظیمی» را برای کل خانواده به ارمغان آوردهاند. در مصاحبهای که توسط روزنامهنگار کارن هائو برای کتابش «امپراتوری هوش مصنوعی» انجام شد، آنی اظهار داشت که این خاطرات در بزرگسالی در «فلشبکها» بازیابی شدهاند.)

علاوه بر این، چندین نفر از شرکتهای رقیب و شرکتهای سرمایهگذاری نیز به ما اشاره کردند که آلتمن در فعالیتهای جنسی زیر سن قانونی دست داشته است - ادعایی که به طور گسترده در سیلیکون ولی منتشر شده و به نظر میرسد به همان اندازه بیاساس است. ما ماهها صرف تحقیق کردیم، دهها مصاحبه انجام دادیم و هیچ مدرکی دال بر این ادعا پیدا نکردیم. آلتمن پاسخ داد: «این یک تاکتیک منزجرکننده است که به اعتقاد من رقبا سعی دارند «جمع هیئت منصفه را برای پروندههای آینده مسموم کنند». اگرچه مضحک به نظر میرسد، اما همچنان میخواهم اعلام کنم: هرگونه ادعایی درباره رابطه جنسی من با افراد زیر سن قانونی، استخدام کارگران جنسی یا دست داشتن در قتل کاملاً نادرست است. او همچنین اضافه کرد که از اینکه ما «ماههای زیادی را صرف بررسی عمیق این مسائل» کردهایم، «تا حدودی سپاسگزار» است.

سم آلتمن اعتراف میکند که با مردان جوانِ در سن قانونی رابطه داشته است. ما با برخی از شرکای او مصاحبه کردیم که همگی گفتند مشکلی در این مورد نمیبینند. با این حال، «تحقیقات مخالفان» از اردوگاه ایلان ماسک عمداً این موضوع را به عنوان یک نقطه حمله مطرح کرد. (این مطالب حتی شامل ادعاهای جنجالی و تأییدنشدهای مانند «ارتش دوقلوها» و «انحراف جنسی شوگر ددی» نیز میشد.) آلتمن در پاسخ گفت: «اینجا کلی همجنسگراهراسیِ تشدیدشده وجود دارد.» کارا سویشر، روزنامهنگار حوزه فناوری، نیز با این نظر موافق است: «همه این پولدارها انواع کارهای عجیب و غریب انجام دادهاند، عجیبتر از هر چیزی که درباره سم شنیدهام.» اما چون او یک مرد همجنسگرا در سانفرانسیسکو است، از این به عنوان یک سلاح استفاده میشود.»

در طول دهه گذشته، مدیران شرکتهای رسانههای اجتماعی زمانی قول میدادند که میتوانند «دنیا را تغییر دهند» تقریباً بدون هیچ عارضه جانبی، و خواستههای نظارتی را به عنوان «خرابکاران اینترنتی» رد میکردند، که در نهایت خشم هر دو حزب را برانگیخت. در مقابل، تصویر آلتمن به طور خاص «خودآگاه» به نظر میرسید. او نه تنها از وضع مقررات طفره نمیرفت، بلکه فعالانه خواستار آن بود. در سال ۲۰۲۳، او در جلسه استماع کمیته قضایی سنای ایالات متحده، پیشنهاد ایجاد یک آژانس فدرال جدید برای تنظیم مدلهای پیشرفته هوش مصنوعی را مطرح کرد. او گفت: «اگر این فناوری دچار مشکل شود، عواقب بسیار شدیدی خواهد داشت.» سناتور جان کندی از لوئیزیانا، که به خاطر اظهارات تندش علیه مدیران عامل شرکتهای فناوری شناخته میشود، حتی تا حدودی موافق به نظر میرسید و با لحنی نیمهشوخی پیشنهاد داد که آلتمن باید خودش مسئول تنظیم مقررات باشد.

با این حال، آلتمن در حالی که علناً از مقررات استقبال میکرد، به طور خصوصی نیز علیه آن لابی میکرد. طبق گزارش تایم ، بین سالهای ۲۰۲۲ و ۲۰۲۳، OpenAI با موفقیت پیشنهاد نظارتی اتحادیه اروپا را که شرکتهای بزرگ هوش مصنوعی را هدف قرار میداد، تعدیل کرد. در سال ۲۰۲۴، مجلس قانونگذاری کالیفرنیا لایحهای را ارائه کرد که آزمایش امنیتی مدلهای هوش مصنوعی را الزامی میکرد، که بسیاری از آنها دقیقاً منعکسکنندهی حمایت آلتمن در کنگره بود. OpenAI علناً با این لایحه مخالفت کرد و در پشت صحنه فشارهایی را اعمال کرد. یکی از دستیاران قانونگذاری به ما گفت: «در طول آن سال، شاهد بودیم که رفتار OpenAI روز به روز حیلهگرانهتر و گمراهکنندهتر میشد.»

در همین حال، ماسک به حملات عمومی خود به آلتمن ادامه داد و از او با عنوان «آلتمن کلاهبردار» و «سم شیاد» یاد کرد. (وقتی آلتمن از مشکلی در تسلا در ایکس شکایت کرد، ماسک پاسخ داد: «شما از یک سازمان غیرانتفاعی دزدی کردهاید.») اما در واشنگتن، به نظر میرسید آلتمن دست بالا را دارد. ماسک زمانی بیش از ۲۵۰ میلیون دلار برای کمک به انتخاب مجدد دونالد ترامپ کمک کرده بود و مدت کوتاهی قبل از ترک کاخ سفید در آنجا خدمت کرده بود که باعث تیره شدن روابطش با ترامپ شد.

امروز، آلتمن به یکی از غولهای فناوری مورد علاقه ترامپ تبدیل شده است، و حتی با او از قلعه ویندزور در بریتانیا بازدید کرده است. این دو نفر سالی چند بار با هم صحبت میکنند. آلتمن گفت: «میتوانید مستقیماً با او تماس بگیرید.» «این از آن نوع دوستیها نیست، اما اگر لازم باشد در مورد چیزی با او صحبت کنم، به او زنگ میزنم.» وقتی ترامپ سال گذشته میزبان رهبران فناوری در کاخ سفید بود، ماسک غایب بود و آلتمن روبروی رئیس جمهور نشسته بود. ترامپ به او گفت: «سم، تو خیلی خوششانسی.» «قبلاً چیزهای باورنکردنی به من گفتی.»

ران کانوی، سرمایهگذار، همچنین با چهرههای سیاسی از جمله نانسی پلوسی و گوین نیوسام لابی کرد تا برای رد لایحه مذکور تلاش کنند. در نهایت، در حالی که این لایحه از حمایت دو حزبی برخوردار شد و تصویب شد، توسط نیوسام وتو شد. امسال، برخی از نامزدهای کنگره که از مقررات هوش مصنوعی حمایت میکردند، با مخالفانی مواجه شدند که توسط «رهبری آینده»، یک گروه اقدام سیاسی طرفدار هوش مصنوعی، تأمین مالی میشدند. OpenAI رسماً اعلام کرد که به چنین سازمانهایی کمک مالی نخواهد کرد، اما گرگ بروکمن، یکی از بنیانگذاران آن، ۵۰ میلیون دلار تعهد کرد. (در همان سال، او و همسرش ۲۵ میلیون دلار به یک کمیته اقدام سیاسی (APC) حامی ترامپ اهدا کردند.)

اقدامات OpenAI فراتر از لابیگریهای سنتی است. سال گذشته، زمانی که سنای کالیفرنیا نسخه اصلاحشدهای از یک لایحه را پیشنهاد داد، ناتان کالوین، وکیل یک سازمان منافع عمومی که در تهیه پیشنویس این لایحه نقش داشت، در جریان یک شام در خانهاش، احضاریهای از OpenAI دریافت کرد. این شرکت ادعا کرد که قرار است بررسی کند که آیا ماسک مخفیانه به منتقدان بودجه میدهد یا خیر، اما درخواست کرد که تمام ارتباطات خصوصی کالوین در مورد این لایحه را دریافت کند. او گفت: «آنها میتوانستند مستقیماً از ما بپرسند که آیا از ماسک پولی دریافت کردهایم یا نه - ما اصلاً چنین پولی دریافت نکردهایم.» دیگر حامیان این لایحه، و همچنین منتقدان گذار تجاریسازی OpenAI، نیز احضاریههای مشابهی دریافت کردند. دان هاوارد، رئیس این سازمان مدافع منافع عمومی، گفت: «آنها سعی دارند این افراد را با ارعاب وادار به سکوت کنند.» (OpenAI اظهار داشت که این بخشی از رویههای قانونی عادی است.)

از نظر موضع سیاسی، آلتمن مدتهاست که از حزب دموکرات حمایت میکند. او اظهار داشته است: «من نسبت به آن دسته از حاکمان اقتدارگرایی که از روایت ترس برای سرکوب ضعفا استفاده میکنند، بسیار محتاط هستم - این بیشتر از پیشینه یهودی من ناشی میشود تا گرایش جنسیام.» در سال ۲۰۱۶، او از هیلاری کلینتون حمایت کرد و ترامپ را «تهدیدی بیسابقه برای آمریکا» خواند؛ در سال ۲۰۲۰، او به حزب دموکرات و صندوق انتخاباتی بایدن کمک مالی کرد. در دوران تصدی جو بایدن، او چندین بار برای بحثهای سیاسی به کاخ سفید سفر کرد و به پیشبرد اولین چارچوب نظارتی امنیتی هوش مصنوعی در سطح فدرال کمک کرد.

با این حال، تا سال ۲۰۲۴، با کاهش محبوبیت بایدن، موضع آلتمن شروع به تغییر کرد: صرف نظر از نتیجه انتخابات، آمریکا خوب خواهد بود. پس از پیروزی ترامپ، او یک میلیون دلار به صندوق مراسم تحلیف او اهدا کرد و در مراسم تحلیف با سلبریتیهای اینترنتی، جیک و لوگان پال، عکس گرفت. او در X نوشت: «اخیراً با دقت بیشتری @potus را زیر نظر دارم و واقعاً برداشت من از او تغییر کرده است (کاش زودتر مستقلتر فکر کرده بودم...)» در اولین روز ریاست جمهوری ترامپ، او دستورات اجرایی هوش مصنوعی مربوط به دوران بایدن را لغو کرد. یک مقام ارشد سابق دولتی اظهار داشت: «او راهی مؤثر برای وادار کردن دولت ترامپ به همکاری با خودش پیدا کرد.»

آلتمن در طول این سالها، همواره توسعهی هوش مصنوعی عمومی (AGI) را به «پروژهی منهتن» تشبیه کرده است. همانطور که جی. رابرت اوپنهایمر زمانی دانشمندان را با حس ماموریت «علیه نازیها» بسیج کرد، آلتمن نیز از روایت رقابت ژئوپلیتیکی برای جلب حمایت بهره میبرد. او در مواجهه با مخاطبان مختلف، با انعطافپذیری از این تشبیه استفاده میکند - گاهی بر شتاب تأکید میکند، گاهی بر احتیاط. در تابستان ۲۰۱۷، طی دیداری با مقامات اطلاعاتی ایالات متحده، او ادعا کرد که چین «پروژه منهتن هوش مصنوعی» را راهاندازی کرده و از این طریق برای جلب حمایت مالی دولت استفاده کرده است. وقتی از او خواسته شد مدرکی ارائه دهد، فقط گفت: «بعضی چیزها شنیدهام» اما هرگز مدرک مشخصی ارائه نکرد. یک مقام دولتی که در تحقیقات دخیل بود، بعداً اظهار داشت که چنین پروژههایی یافت نشد: «این بیشتر شبیه یک تبلیغ برای فروش است.» (آلتمن ادعا کرد که به خاطر نمیآورد آن را به این شکل بیان کرده باشد.)

وقتی با مخاطبانی مواجه شد که بیشتر بر امنیت متمرکز بودند، او به نوبه خود بر اهمیت هماهنگی بینالمللی تأکید کرد. در سال ۲۰۱۷، آمودی، پیج هدلی، وکیل منافع عمومی را به عنوان مشاور سیاستگذاری و اخلاق استخدام کرد. هدلی در یک ارائه داخلی پیشنهاد داد که میتوان یک مکانیسم هماهنگی بینالمللی شبیه به ناتو ایجاد کرد تا از یک مسابقه تسلیحاتی فاجعهبار هوش مصنوعی جلوگیری شود. با این حال، طبق خاطراتش، بروکمن نگران این موضوع نبود: «مهم نبود چه میگفتم، او همیشه به یک سوال برمیگشت: چطور میتوانیم بودجه بیشتری دریافت کنیم؟» چطور برنده شویم؟" بر اساس مصاحبهها و سوابق متعدد، بروکمن حتی ایده دیگری را مطرح کرد: سود بردن از جنگ پیشنهاد قیمت بین ایالات متحده، چین و روسیه - "از آنجایی که دوران سلاحهای هستهای میتواند به این شکل عمل کند، چرا هوش مصنوعی نتواند؟"

او در آن لحظه شوکه شد: «آنها حتی این فرضیه را انکار نکردند - 'ما در حال بحث در مورد چیزی هستیم که ممکن است مخربترین فناوری تاریخ باشد، اگر آن را به ولادیمیر پوتین بفروشیم چه؟'» (با این حال، گرگ بروکمن اظهار داشت که هرگز به طور جدی به «حراج» مدلهای هوش مصنوعی به دولتها فکر نکرده است.) سخنگوی OpenAI گفت: «ما صرفاً در حال بحث در مورد برخی از چارچوبهای همکاری بالقوه در سطح کلان، مانند یک مکانیسم همکاری هوش مصنوعی مشابه ایستگاه فضایی بینالمللی، بودیم.» «به تصویر کشیدن این موضوع به عنوان چیز دیگری کاملاً پوچ و بیمعنی است.»)

طوفانهای فکری اغلب در ابتدا ایدههای عجیب و غریبی ایجاد میکنند. پیج هدلی در ابتدا امیدوار بود که مفهومی که بعداً در داخل به عنوان «طرح کشورها» از آن یاد شد، به سرعت کنار گذاشته شود. با این حال، طبق گفته چندین شرکتکننده و سوابق مربوطه در آن زمان، مدیران OpenAI به طور فزایندهای از این ایده هیجانزده شدند. جک کلارک، رئیس وقت سیاستگذاری، گفت هدف بروکمن «ایجاد وضعیتی شبیه به معضل زندانی بود، که در آن همه کشورها مجبور به تأمین مالی ما شوند» و «در این ساختار، عدم تأمین مالی ما خود به یک اقدام خطرناک تبدیل میشود.» یک محقق جوان به یاد میآورد که وقتی در جلسهای از شرکت، شرح مفصلی از این طرح را شنید، با خود فکر کرد: «این واقعاً دیوانگی است.»

مدیران حتی این طرح را حداقل با یک سرمایهگذار بالقوه در میان گذاشتند. با این حال، اواخر همان ماه، پس از آنکه چندین کارمند قصد استعفای خود را ابراز کردند، این طرح متوقف شد. هدلی گفت: «سم اعضای تیمش را از دست میداد.» «من احساس کردم که در محاسبات او، این همیشه مهمتر از این است که 'این طرح میتواند باعث یک درگیری قدرت بزرگ شود، بنابراین ذاتاً غیرمنطقی است.'»

با وجود از رده خارج شدن «طرح کشورها»، سم آلتمن از نسخهای از این ایده دست نکشید. در ژانویه ۲۰۱۸، او یک «AGI» تشکیل داد. رویداد آخر هفته" در هتل بل-ایر در لسآنجلس. این اقامتگاه به سبک هالیوودی به خاطر باغ گلهای کاغذی صورتی و استخری با قوهای واقعیاش شناخته میشود. از جمله شرکتکنندگان میتوان به نیک بوستروم، فیلسوف آکسفورد و «پیشگوی خطر هوش مصنوعی»، عمر العلما، مدافع هوش مصنوعی امارات متحده عربی، و حداقل هفت میلیاردر اشاره کرد. برای کسانی که نگران مسائل امنیتی هستند، این رویداد به عنوان فرصتی برای بحث در مورد «چگونگی آماده شدن برای ورود هوش مصنوعی عمومی» توصیف شد؛ در حالی که سرمایهگذاران انتظار داشتند پیشنهادهای سرمایهگذاری را بشنوند.

فعالیتهای روزانه در یک اتاق کنفرانس مدرن برگزار شد و شرکتکنندگان به نوبت سخنرانی کردند. (رید هافمن حتی در مورد چگونگی رمزگذاری «شفقت بودایی» در هوش مصنوعی صحبت کرد.) سخنران آخر آلتمن بود که یک طرح تأمین مالی ارائه داد: انتشار یک ارز دیجیتال جهانی که بتواند «توجه AGI را تبادل کند». در چشمانداز او، زمانی که هوش مصنوعی عمومی به اوج کاربردی بودن و «شیطانزدایی» برسد، کاربران جهانی برای خرید زمان استفاده از سرورهای OpenAI با هم رقابت خواهند کرد. داریو آمودی در یادداشتهای خود نوشت: «این ایده در ظاهر پوچ به نظر میرسد (آیا ولادیمیر پوتین هم این توکنها را نگه میدارد؟...) با نگاهی به گذشته، این یکی از نشانههای هشداردهندهی فراوانی بود که باید جدیتر میگرفتم.» این طرح بیشتر شبیه یک تاکتیک جمعآوری کمک مالی به نظر میرسید، اما آلتمن آن را به عنوان بخشی از ایمنی هوش مصنوعی ارائه داد. یکی از اسلایدهای او این بود: «میخواهم تا جایی که ممکن است افراد بیشتری در «طرف درست» بایستند و در نهایت پیروز شوند.» در اسلاید دیگری نوشته شده بود: «لطفاً خنده را برای آخر ارائه نگه دارید.»

روایت آلتمن از تأمین مالی در طول سالها تکامل یافته است، اما همیشه حول یک واقعیت اساسی میچرخیده است: توسعه AGI به سرمایه هنگفتی نیاز دارد. او از یک «قانون مقیاس» نسبتاً ساده پیروی میکند - هرچه دادهها و قدرت محاسباتی بیشتری برای آموزش یک مدل استفاده شود، مدل هوشمندتر میشود. تراشههای تخصصی که از این فرآیند پشتیبانی میکنند، بسیار پرهزینه هستند. تنها در آخرین دور تأمین مالی، OpenAI بیش از ۱۲۰ میلیارد دلار جمعآوری کرد - بزرگترین جمعآوری سرمایه خصوصی در تاریخ، چهار برابر بزرگتر از بزرگترین عرضه اولیه سهام. یک سرمایهگذار حوزه فناوری گفت: «وقتی صحبت از نهادهایی میشود که میتوانند سالانه دهها میلیارد دلار را آزادانه در اختیار داشته باشند، تنها تعداد کمی از آنها در سطح جهان وجود دارند.» دولت آمریکا، چند تا از بزرگترین شرکتهای فناوری، و عربستان سعودی و امارات متحده عربی، همین.»

سم آلتمن، هنوز یک متغیر ریسک حل نشده

اکتشاف خلیج فارس: یک قمار ژئوپلیتیکی

آلتمن در ابتدا عربستان سعودی را هدف قرار داد. او اولین بار در سال ۲۰۱۶ در یک ضیافت شام در هتل فیرمونت در سانفرانسیسکو با محمد بن سلمان، ولیعهد و حاکم بالفعل عربستان، ملاقات کرد. طبق خاطرات هدلی، آلتمن متعاقباً اغلب از او به عنوان «دوست» یاد میکرد. طبق یادداشتهای هدلی، آلتمن در سپتامبر ۲۰۱۸ اشاره کرد: «من در حال بررسی این هستم که آیا صدها میلیارد دلار از صندوق ثروت ملی عربستان سعودی (PIF) برداشت کنم یا خیر.»

با این حال، یک ماه بعد، اوضاع به طرز چشمگیری تغییر کرد. جمال خاشقجی، روزنامهنگار واشنگتن پست، که از دولت عربستان سعودی انتقاد میکرد، در ترکیه کشته و تکهتکه شد، و این باور عمومی وجود دارد که ولیعهد عربستان دستور این اقدام را داده است. یک هفته بعد، اعلام شد که آلتمن به هیئت مشاوره پروژه «شهر آینده» عربستان سعودی، نئوم، پیوسته است. جک کلارک، مسئول سیاستگذاری وقت، به یاد میآورد که در آن زمان به او مشاوره میداد: «سم، تو نمیتوانی به این هیئت مشاوره بپیوندی.» در ابتدا، آلتمن از تصمیم خود دفاع کرد و اظهار داشت که جارد کوشنر به او اطمینان داده است که عربستان سعودی «این کار را نکرده است» (آلتمن ادعا کرد که این موضوع را به خاطر نمیآورد و کوشنر نیز گفت که دو طرف در آن زمان با هم در تماس نبودهاند). با روشن شدن روزافزون مسئولیت ولیعهد، آلتمن سرانجام از هیئت مشاوره نئوم کنارهگیری کرد.

با این حال، مشاوری که زمانی به آلتمن مشاوره سیاسی داده بود، به طور خصوصی به یاد آورد که این موضوع را به عنوان یک «عقبنشینی موقت» میبیند و همچنان به بررسی این موضوع ادامه میدهد که آیا هنوز امکان دریافت بودجه از عربستان سعودی وجود دارد یا خیر. «سوال هرگز این نبود که «آیا این درست است یا غلط»، بلکه این بود که «اگر این کار را انجام دهیم، عواقب آن چه خواهد بود؟» آیا باعث کنترل صادرات خواهد شد؟ آیا ما تحریم خواهیم شد؟ میتونم از پسشون بربیام؟

در همین حال، آلتمن توجه خود را به منبع مالی دیگری نیز معطوف کرد: امارات متحده عربی. این کشور در میانه یک طرح تحول پانزده ساله است و به دنبال تغییر از یک اقتصاد مبتنی بر نفت به یک قطب فناوری است. این پروژه توسط طحنون بن زاید آل نهیان، برادر رئیس جمهور و رئیس اطلاعات ملی، رهبری میشود. او بر گروه هوش مصنوعی کشور، G42، و همچنین حدود ۱.۵ تریلیون دلار از ثروت ملی نظارت دارد. در ژوئن ۲۰۲۳، آلتمن از ابوظبی بازدید کرد، با مقامات، از جمله اولاما، ملاقات کرد و در یک رویداد دولتی اظهار داشت که امارات متحده عربی «پیش از رواج هوش مصنوعی، زمینهسازی برای آن را آغاز کرده است» و چشماندازی آیندهنگرانه ترسیم کرد: خاورمیانه «نقشی محوری» در اکوسیستم جهانی هوش مصنوعی ایفا خواهد کرد.

تأمین مالی از کشورهای خلیج فارس به یک عملیات عادی برای شرکتهای بزرگ تبدیل شده است. با این حال، سم آلتمن دیدگاه ژئوپلیتیکی وسیعتری را دنبال میکرد. در پاییز ۲۰۲۳، او بیسروصدا شروع به جذب استعدادها و برنامهریزی پروژهای کرد که بعدها با نام «چیپکو» شناخته شد: پروژهای که توسط کشورهای خلیج فارس با صدها میلیارد دلار بودجه تأمین میشد تا کارخانههای بزرگ تراشه و مراکز داده در سطح جهانی بسازد و بخشی از آن در خاورمیانه مستقر باشد. او به الکساندر وانگ، رئیس فعلی متا ایآی، پیشنهاد داده بود که به تیم رهبری بپیوندد و جف بزوس را به عنوان رهبر این پروژه معرفی کرده بود. آلتمن به دنبال سرمایهگذاری قابل توجهی از امارات متحده عربی بود. یکی از مدیران گفت: «تا جایی که من میدانم، کل این ماجرا بدون اطلاع هیئت مدیره مطرح شده است.» جیمز بردبری، پژوهشگری که توسط آلتمن برای شرکت در این پروژه دعوت شده بود، به یاد میآورد که چرا تصمیم گرفت این پیشنهاد را رد کند: «فکر اولیهام این بود که—احتمال موفقیتش کاملاً زیاد است، اما مطمئن نیستم که خودم بخواهم موفق شوم.»

قدرت محاسباتی هوش مصنوعی ممکن است به زودی جایگزین نفت یا اورانیوم غنیشده به عنوان منبع اصلی شکلدهنده پویایی قدرت جهانی شود. آلتمن گفته است که قدرت محاسباتی «ارز آینده» است. در تئوری، مکان مراکز داده بیربط به نظر میرسد، اما بسیاری از مقامات امنیت ملی ایالات متحده نگران تمرکز زیرساختهای پیشرفته هوش مصنوعی در کشورهای استبدادی خلیج فارس هستند. زیرساختهای ارتباطی امارات متحده عربی به شدت به هواوی (یک شرکت فناوری نزدیک به دولت چین) وابسته است و این کشور در گذشته به نشت فناوری ایالات متحده به پکن متهم شده است. سازمانهای اطلاعاتی نگرانند که تراشههای پیشرفته صادر شده به امارات متحده عربی توسط مهندسان چینی مورد سوءاستفاده قرار گیرند. علاوه بر این، مراکز داده در خاورمیانه در معرض هدف قرار گرفتن در درگیریهای ژئوپلیتیکی آسیبپذیرتر هستند - ایران اخیراً حملاتی را به مراکز داده مرتبط با ایالات متحده در بحرین و امارات متحده عربی انجام داده است. در یک سناریوی شدیدتر، یک پادشاهی خلیج فارس حتی میتواند به طور بالقوه کنترل مراکز داده شرکتهای آمریکایی را به دست بگیرد و از آنها برای آموزش مدلهای بسیار قدرتمند استفاده کند - این تقریباً یک نسخه واقعی از "دیکتاتوری هوش مصنوعی عمومی" است.

در طول دوره حساس پس از اخراجش، یکی از افراد مورد اعتماد آلتمن، برایان چسکی بود. بنیانگذار Airbnb، همچنین یکی از سرسختترین حامیان اوست. چسکی به ما گفت: «دیدن دوستم که با ورطه نابودی روبرو بود، باعث شد دوباره به معنای «اداره کردن واقعی یک شرکت» فکر کنم.» سال بعد، در گردهمایی فارغ التحصیلان Y Combinator، او یک سخنرانی دو ساعته بداهه ایراد کرد که «شبیه یک جلسه رواندرمانی جمعی بود». ایده اصلی ساده بود: شهود بنیانگذار در مورد شرکت خودش قابل اعتمادترین چیز است، و هر کسی که شما را انکار کند، شما را "تحت تاثیر گاز" قرار داده است. چسکی گفت: «تو دیوانه نیستی، حتی اگر کارمندانت به تو بگویند دیوانهای.» پاول گراهام این نگرش را در یک پست وبلاگی با عنوان «حالت بنیانگذار» ابداع کرد. از زمان رویداد «بلیپ»، آلتمن آشکارا در این حالت بوده است.

در فوریه ۲۰۲۴، وال استریت ژورنال برای اولین بار طرح چیپکو را فاش کرد. آلتمن آن را به عنوان یک نهاد مشترک با مقیاسی تا ۵ تا ۷ تریلیون دلار تصور میکرد (او حتی در رسانههای اجتماعی به شوخی گفت: «بیایید آن را به ۸ تریلیون دلار برسانیم»). بسیاری از کارمندان ابتدا از طریق رسانهها از این طرح مطلع شدند. «واکنش همه این بود: صبر کنید، چی؟» یان لایکه به یاد آورد. در یک جلسه داخلی، آلتمن اصرار داشت که تیم امنیتی «در این بحث دخیل بوده است» و لایکه متعاقباً به او پیام داد که تلویحاً نگوید که این طرح مجوز امنیتی دریافت کرده است.

در دوران تصدی جو بایدن، آلتمن تلاش کرد تا برای شرکت در مباحث طبقهبندیشدهی سیاستهای هوش مصنوعی، درخواست مجوز امنیتی کند. با این حال، کارکنان شرکت رند که در این فرآیند کمک میکردند، نگرانیهای خود را ابراز کردند: یکی از کارکنان نوشت: «او دهها میلیارد دلار از دولتهای خارجی جمعآوری میکند. امارات متحده عربی حتی اخیراً به او یک ماشین داده است (حدس میزنم خیلی گران باشد).» این فرد همچنین خاطرنشان کرد: تنها کسی که به ذهنم میرسد و با چنین روابط مالی خارجی گستردهای درخواست مجوز امنیتی داده بود، جارد کوشنر بود و مرجع تصویبکننده در آن زمان توصیه به عدم اعطای آن کرده بود. آلتمن در نهایت از روند درخواست انصراف داد. یک مقام ارشد دولتی که در این مذاکرات دخیل بوده است، گفت: «روابط بسیار معاملهگرانهی او با امارات متحده عربی باعث شده است که بسیاری از مردم محتاط باشند و بسیاری در داخل دولت به او اعتماد کامل ندارند.»

وقتی از آلتمن پرسیده شد که آیا از طحنون بن زاید آل نهیان هدایایی دریافت کرده است، او پاسخ داد: «من دقیقاً مشخص نمیکنم که او چه چیزهایی داده است، اما او و دیگر رهبران ملی... واقعاً به من هدایایی دادهاند.» او افزود که این شرکت سیاست روشنی دارد که مستلزم افشای تمام هدایای دریافتی از شرکای بالقوه است. آلتمن حداقل دو سوپراسپرت دارد: یک کونیگزگ رگرا سفید به ارزش حدود ۲ میلیون دلار و یک مکلارن F1 قرمز به ارزش حدود ۲۰ میلیون دلار. در سال ۲۰۲۴، او در حال رانندگی با رگرا در دره ناپا دیده شد و ویدیوی کوتاهی از او در شبکههای اجتماعی منتشر شد: او روی صندلی کوتاهی نشسته بود و به بدنه سفید آن تکیه داده بود. یک سرمایهگذار نزدیک به ماسک، این ویدیو را ریتوییت کرد و نوشت: «من هم میخواهم یک سازمان غیرانتفاعی راهاندازی کنم.»