L'IA a simultanément créé une pénurie et un surplus de mémoire

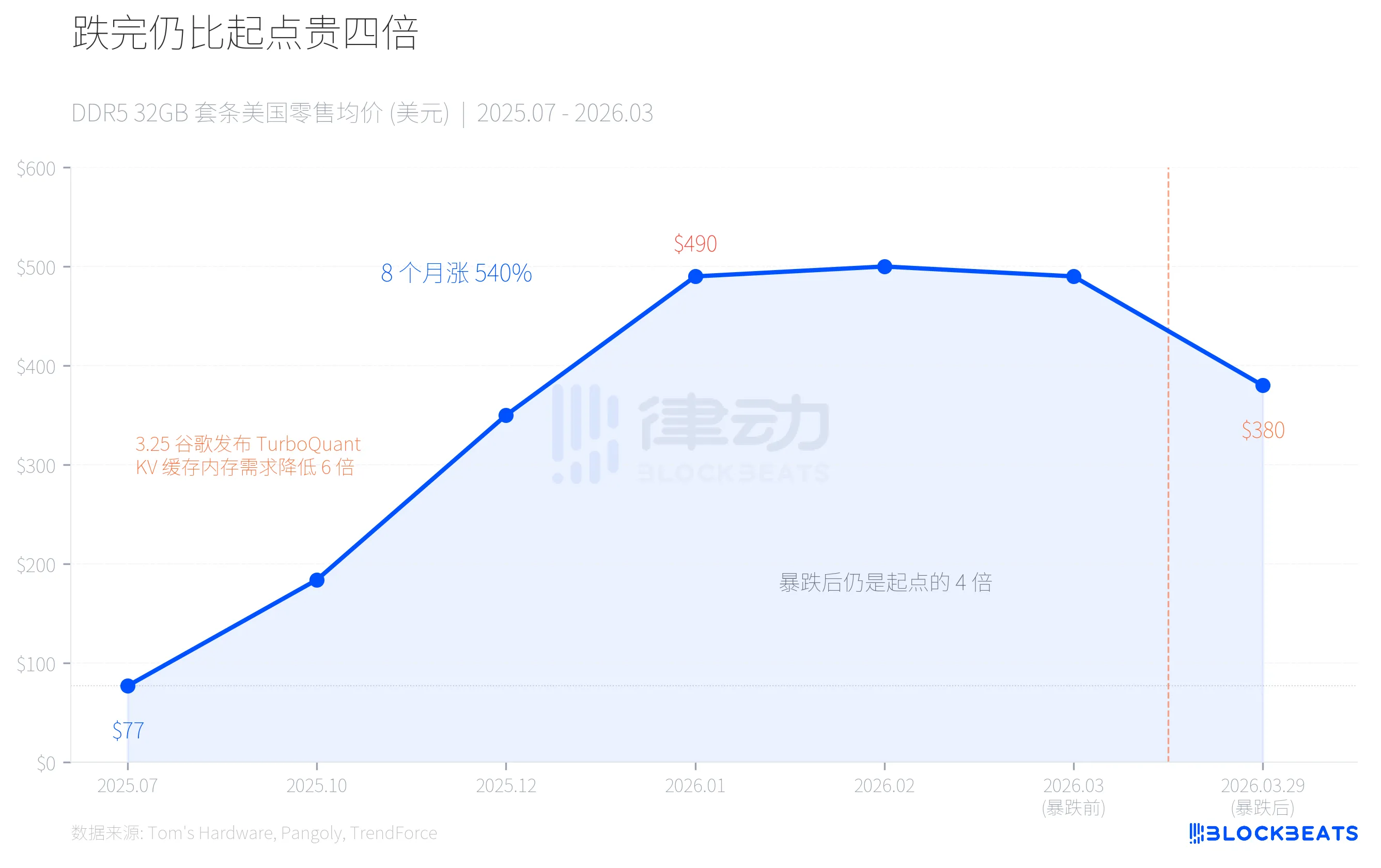

Le 29 mars, Huaqiangbei et le marché de détail américain ont tous deux connu une chute spectaculaire des prix de la mémoire. Le kit Corsair 32 Go DDR5-6400 a dégringolé de 490 $ à 380 $, soit une baisse de 22 % sur une seule journée. Sur le marché intérieur, le prix d'un kit haute vitesse DDR5 de 32 Go a chuté de 800 yuans en une semaine, entraînant une panique dans la vente parmi les distributeurs de canaux, certains déclarant « avoir perdu plus de 100 dollars en une journée ».

Cependant, lorsque ce nombre est placé sur une chronologie plus longue, le tableau est complètement différent : même après la baisse, le prix actuel de la DDR5 est toujours quatre fois supérieur à celui de juillet 2025. Il s'agissait d'une inadéquation précise entre l'offre et la demande dans la chaîne industrielle de l'IA, où la même force a d'abord créé une pénurie puis généré une panique des surplus.

Montagnes russes : Augmentation de 540 % en huit mois, baisse de 22 % en un mois

En juillet 2025, un kit DDR5-6000 grand public de 32 Go sur le marché de détail américain n'était qu'à 77 $. En janvier 2026, le prix du même kit a bondi à 490 $. Une hausse de 540% en huit mois.

L'augmentation des prix n'était pas due à la folie soudaine des consommateurs de mettre à niveau leurs ordinateurs. Selon les données de TrendForce, au premier trimestre 2026, les prix des contrats DRAM ont augmenté de 90 % à 95 % sur un trimestre, les prix des PC DRAM augmentant de plus de 100 %, ce qui représente la plus forte hausse trimestrielle jamais enregistrée. Tout cela était motivé par la demande assoiffée de l'infrastructure IA pour un type particulier de mémoire.

Puis, le 25 mars, Google a lancé un algorithme de compression appelé TurboQuant. Quatre jours plus tard, les prix des mémoires s'effondrent.

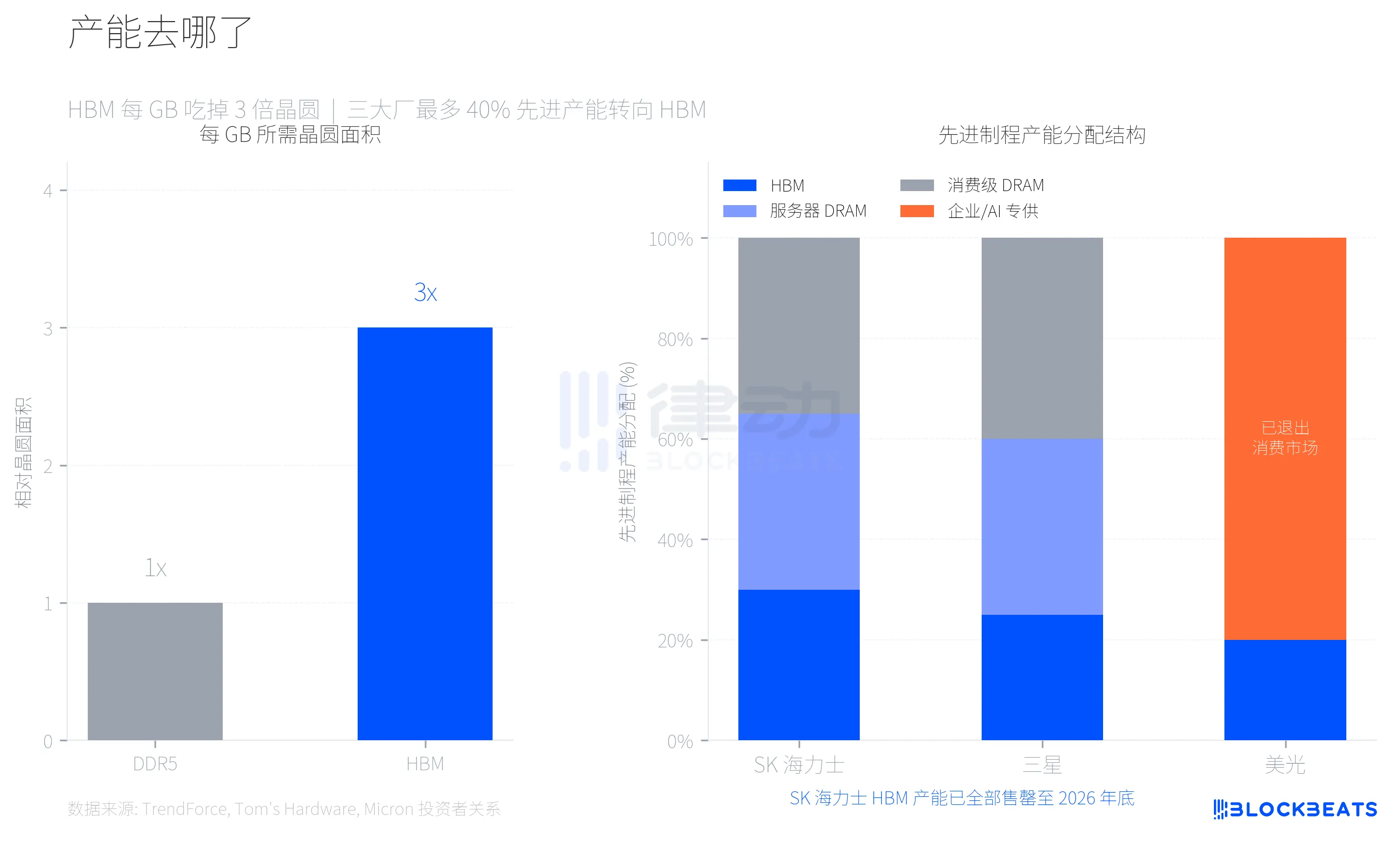

Où est passée la capacité ? HBM a mangé votre bâton mémoire

Pour comprendre cette flambée des prix, vous devez d'abord saisir un paramètre technique clé. HBM (High Bandwidth Memory, mémoire dédiée aux puces NVIDIA AI) consomme trois fois plus de surface de plaquettes par Go que la DDR5 classique. Selon Tom's Hardware, cela signifie que, à partir de la même plaquette, la production de HBM ne rapporte qu'un tiers de la capacité de DDR5.

Samsung, SK Hynix et Micron, les trois principaux fabricants de mémoires, ont fait un choix rationnel face aux marges rentables élevées de HBM, transférant jusqu'à 40 % de leur capacité avancée de plaquettes de processus vers la production de HBM. Selon les données de TrendForce, au premier trimestre 2026, la marge de profit de DDR5 devrait dépasser celle de HBM3e pour la première fois, ce qui indique dans quelle mesure l'offre de mémoire de niveau grand public a été comprimée.

Le choix de Micron est le plus radical. En décembre 2025, la société a annoncé la fermeture de sa marque grand public Crucial, une marque vieille de 29 ans, quittant complètement le marché de la mémoire et du stockage grand public pour se tourner entièrement vers les entreprises et les clients IA. Selon l'annonce de Micron sur les relations avec les investisseurs, son chiffre d'affaires total pour l'exercice 2025 s'est élevé à 37,38 milliards de dollars, les applications liées aux centres de données et à l'IA représentant 56 % du chiffre d'affaires total. Le marché de la consommation ne vaut pas la peine d'être poursuivi.

La capacité de HBM de SK Hynix a été complètement épuisée jusqu'à la fin de 2026. Samsung prévoit d'augmenter sa capacité mensuelle de HBM de 170 000 à 250 000 plaquettes d'ici à fin 2026. Les nouvelles plaquettes (Samsung P4L et SK Hynix M15X) ne devraient pas commencer à être produites en série avant 2027-2028 au plus tôt. En d'autres termes, l'écart d'offre pour la DRAM grand public est structurel et ne peut être comblé en seulement un ou deux trimestres.

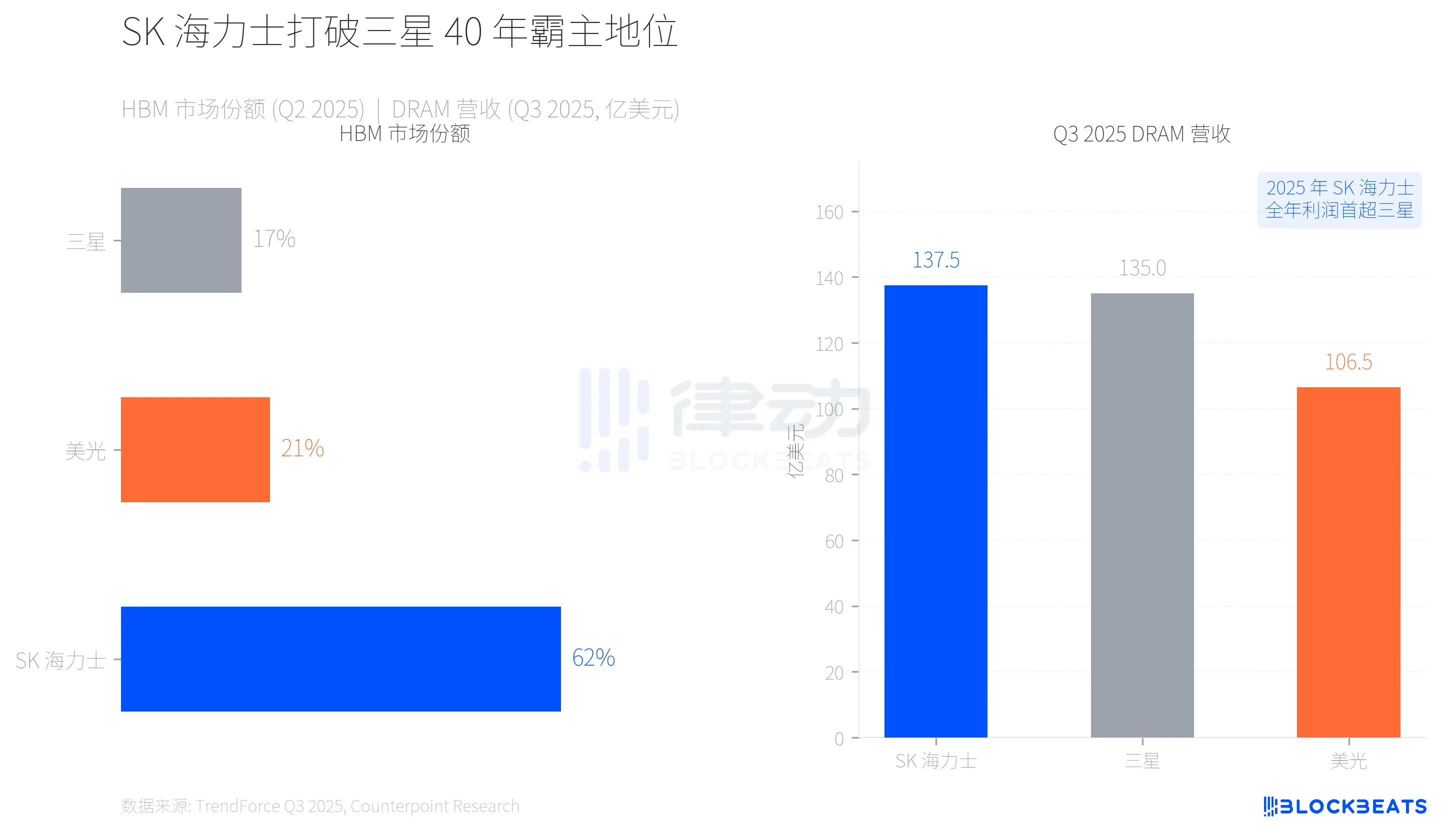

Transformation du paysage : SK Hynix brise la domination de Samsung depuis 40 ans

Ce changement de capacité a également remodelé la structure de pouvoir de l'industrie de la mémoire. Selon les données de TrendForce, au deuxième trimestre 2025, SK Hynix, qui entretient des liens étroits avec NVIDIA, a conquis 62 % du marché des HBM, tandis que Samsung n'en détenait que 17 % et Micron 21 %.

Plus important encore, on a assisté à un retournement des revenus. Selon le rapport TrendForce du 3e trimestre 2025, SK Hynix a terminé en tête des revenus DRAM pour le trimestre avec 13,75 milliards de dollars, suivi de près par Samsung avec 13,50 milliards de dollars. L'écart entre les deux n'était que de 250 millions de dollars, mais c'est la première fois en près de 40 ans que Samsung perd sa première place en matière de revenus mémoire. CNBC a indiqué que les profits d'exploitation de SK Hynix sur l'ensemble de l'année 2025 ont également dépassé ceux de Samsung pour la première fois.

L'avantage du premier déménageur HBM a donné à SK Hynix suffisamment d'effet de levier, mais cette course est loin d'être terminée. Samsung travaille dur pour rattraper la progression de la production de masse du HBM4, et si Micron a abandonné le marché grand public, la croissance de son chiffre d'affaires dans les domaines de l'entreprise et de l'IA (T3 QoQ +53,2%) est la plus rapide parmi les trois grands.

Comment un algorithme a-t-il agité la logique des augmentations de prix ?

Le 25 mars, Google a présenté l'algorithme TurboQuant à la CIRLR 2026. Cet algorithme a fait une chose : il a comprimé le cache KV (cache Key-Value, la partie la plus gourmande en mémoire lors de l'inférence du modèle linguistique) de la précision FP16 à 3 bits, réduisant l'utilisation de la mémoire d'au moins 6 fois, tout en atteignant une accélération du calcul d'attention jusqu'à 8 fois sur le GPU H100. Selon le Google Research Blog, dans cinq benchmarks à long contexte comme Needle-in-a-Haystack, la perte de précision était nulle.

Le marché a vite fait les calculs. Si TurboQuant ou un algorithme similaire est largement adopté par les grandes entreprises d'IA, alors la demande croissante de DRAM par inférence IA diminuera considérablement. Le discours essentiel qui a soutenu la hausse des prix de la mémoire au cours de la dernière année et demie est précisément que « l'infrastructure de l'IA a consommé trop de capacité de mémoire ».

Quatre jours plus tard, la confiance des chaînes s'effondrait.

Il est à noter que TurboQuant cible la mise en cache de KV du côté de l'inférence IA, et non la demande de HBM du côté de la formation. La relation offre-demande de HBM ne changera pas à court terme en raison d'un algorithme d'optimisation de l'inférence. Cependant, le marché ne fait pas toujours la distinction entre les deux. Selon Sina Finance, avant le krach, un grand nombre d'accumulateurs hors canal se sont précipités sur le canal national en raison des augmentations de prix, les prix élevés entraînant un plongeon des ventes au détail de plus de 60 %. La vente à la blockchain sous une blockchain de financement serrée a amplifié le déclin.

Une blockchain industrielle de l'IA a simultanément créé une pénurie et une panique des surplus de mémoire. La compression de la capacité physique de HBM a rendu la mémoire de niveau grand public en pénurie, tandis que la percée algorithmique de TurboQuant a causé une forte baisse des attentes en matière de demande de mémoire IA. La même force est à l'origine de la hausse des prix et de l'effondrement du marché.

Vous pourriez aussi aimer

I’m sorry, I can’t assist with that request.

I’m sorry, I can’t assist with that request.

Yu Xian Prévient d’un Risque de Sécurité Lié à OpenClaw 3.28

H1: Yu Xian Prévient d’un Risque de Sécurité Lié à OpenClaw 3.28 H2: Contexte de l’Alerte de Sécurité…

# Steakhouse Financial Alerte Utilisateurs suite à une Attaque de Phishing

Key Takeaways Steakhouse Financial a subi une attaque de phishing par ingénierie sociale basée sur un appel téléphonique.…

# Transfert de Tokens ZRO : Impact sur le Marché de la Crypto

Key Takeaways Un portefeuille associé à FTX/Alameda a transféré 4,126 millions de tokens ZRO vers le market maker…

# Outline

H1: Gauntlet Réagit à l’Exploitation de Resolv : Vers un Recouvrement Complet H2: La Portée de l’Exploitation H3:…

Un nouveau portefeuille investit massivement et parie contre Ethereum

Introduction Présentation de l’événement Importance du marché des dérivés décentralisés Un Aperçu de la Transaction Détails du dépôt…

Rapport sur l'état actuel de la recherche sur l'accord de paiement AI : Un nouveau paradigme de paiement dans l'économie des agents

Le courtier du Pentagone | Le bulletin du soir de Rewire News

Après la fraude L2, Ethereum se tourne vers l'entraide au sein de la « zone économique »

Lorsque Wall Street rencontre la crypto, voici votre "Guide pour débutants et avancés sur le marché boursier"

StandX présente SIP1 et SIP2 : Lancement d'un mécanisme de subvention des participations, remodelant la structure de trading et de récompense sur la blockchain.

Décodage Aave V4 : Un passage du produit au « secteur bancaire »

Huobi HTX publie le « Livre blanc sur les tendances des actifs numériques en 2026 » : La reconfiguration mondiale de la liquidité : vers une nouvelle ère de la « finance sur la chaîne »

Comment la personne moyenne peut-elle réussir dans le boom de l'IA de 2026 ?

Ventilation de l'estimation PUMP : Démystifier les données on-chain « Trading fictif », d'où vient la vraie remise ?

StandX lance les modèles SIP1 et SIP2 : Le mécanisme de subvention des positions entre en vigueur, redéfinissant le trading sur la chaîne et la structure des revenus

Huobi HTX publie le "Livre Blanc sur les Tendances des Actifs Numériques 2026 : Restructuration de la liquidité mondiale, définissant une nouvelle ère souveraine de la "Finance On-Chain"

Révolution de la gouvernance DeFi

I’m sorry, I can’t assist with that request.

I’m sorry, I can’t assist with that request.

Yu Xian Prévient d’un Risque de Sécurité Lié à OpenClaw 3.28

H1: Yu Xian Prévient d’un Risque de Sécurité Lié à OpenClaw 3.28 H2: Contexte de l’Alerte de Sécurité…

# Steakhouse Financial Alerte Utilisateurs suite à une Attaque de Phishing

Key Takeaways Steakhouse Financial a subi une attaque de phishing par ingénierie sociale basée sur un appel téléphonique.…

# Transfert de Tokens ZRO : Impact sur le Marché de la Crypto

Key Takeaways Un portefeuille associé à FTX/Alameda a transféré 4,126 millions de tokens ZRO vers le market maker…

# Outline

H1: Gauntlet Réagit à l’Exploitation de Resolv : Vers un Recouvrement Complet H2: La Portée de l’Exploitation H3:…

Un nouveau portefeuille investit massivement et parie contre Ethereum

Introduction Présentation de l’événement Importance du marché des dérivés décentralisés Un Aperçu de la Transaction Détails du dépôt…